O Qwen-Image-Edit é um modelo de IA para edição de imagens desenvolvido pela equipe da Alibaba Tongyi Qianqian. Ele é treinado no modelo Qwen-Image, que tem 20 bilhões de parâmetros, e sua função principal é permitir que os usuários modifiquem imagens por meio de comandos simples de texto em chinês ou inglês. O modelo utiliza a compreensão semântica visual e o controle de aparência visual, permitindo que o editor compreenda comandos de alto nível (por exemplo, "alterar o plano de fundo para a Antártica"), além de realizar modificações locais refinadas (por exemplo, "remover os fios de cabelo") enquanto mantendo o restante da imagem o mais inalterado possível. Um dos recursos mais notáveis do modelo é seu poderoso recurso de edição de texto, que permite modificar diretamente os caracteres chineses e ingleses na imagem, preservando o estilo original da fonte. Atualmente, o modelo é de código aberto no Hugging Face e em outras plataformas, e está licenciado sob a licença Apache 2.0, permitindo o uso comercial.

Endereço de experiência:

https://modelscope.cn/models/Qwen/Qwen-Image-Edit

Lista de funções

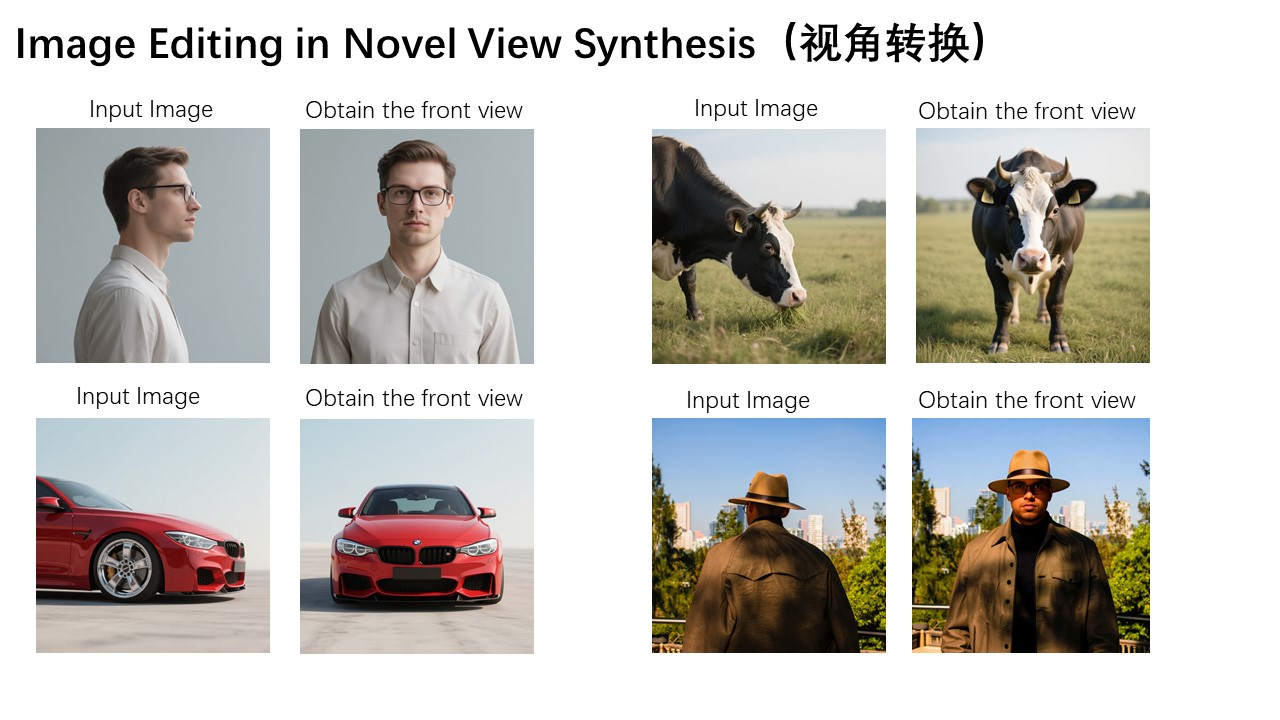

- editor semânticoSuporte a modificações avançadas que envolvem uma compreensão geral da imagem. Por exemplo, converter um retrato em um determinado estilo artístico (por exemplo, estilo anime Ghibli), girar o ponto de vista de um objeto em uma imagem (até mesmo 180 graus) ou criar cenas e estilos diferentes para um personagem IP (por exemplo, um mascote), preservando suas características.

- Editor de aparênciaModificação: concentra-se em fazer modificações precisas em áreas localizadas de uma imagem, deixando o restante da área inalterado. Os exemplos incluem a adição de novos objetos a uma cena (como uma placa de sinalização), a remoção de elementos indesejados (como bagunça ou pequenos fios de cabelo), a alteração da roupa ou do fundo de um personagem e assim por diante.

- Edição de texto com precisãoCapacidade de adicionar, excluir ou modificar caracteres chineses e ingleses diretamente na imagem e tentar manter a fonte, o tamanho e o estilo originais.

- Editor de cadeiasModificação contínua de imagens por meio de várias rodadas e comandos progressivos para obter gradualmente o efeito final desejado. Por exemplo, no trabalho de caligrafia gerado, você pode corrigir os caracteres errados ou insatisfatórios enquadrando-os um a um.

Usando a Ajuda

O modelo Qwen-Image-Edit pode ser usado diretamente em plataformas como Hugging Face e AliCloud Hundred Refinements, e também suporta a implantação local por meio de código ou ferramentas como ComfyUI.

1. on-line no Hugging Face Space

É a maneira mais fácil e direta de experimentá-lo, sem necessidade de conhecimento de programação.

- Acesso à página do modeloAbra a página inicial do Qwen-Image-Edit em Hugging Face (

https://huggingface.co/Qwen/Qwen-Image-Edit)。 - Encontrar a interface de raciocínioLocalize "Use este modelo" ou uma interface semelhante na página.

- Carregar imagem originalClique em "Drag image file here or click to browse do seu dispositivo" para carregar a imagem que deseja editar.

- Digite o comando editNa caixa de texto (geralmente denominada "Prompt" ou similar), descreva sua solicitação de alteração em chinês ou inglês simples e direto. Por exemplo, digite "

Change the rabbit's color to purple, with a flash light background."(Altere a cor do coelho para roxo e o fundo para relâmpago). - Gerar imagemClique no botão "Compute" (Calcular) ou "Generate" (Gerar) e aguarde o processamento do modelo. Após o processamento, a nova imagem editada será exibida na área de saída. Você pode salvar a imagem diretamente clicando com o botão direito do mouse sobre ela.

2. por código Python (diffusersbiblioteca) usando

Se você tiver algumas noções básicas de programação, poderá usar a função Hugging Facediffuserspara chamar o modelo, o que proporciona maior flexibilidade.

- ambiente de instalação: Primeiro, verifique se você tem as bibliotecas Python necessárias instaladas.

pip install torch transformers diffusers acceleratePara usar os recursos de modelagem mais recentes, é recomendável instalá-los diretamente do GitHub!

diffusers。pip install git+https://github.com/huggingface/diffusers - Escreva o código de chamadaExemplo básico de uso: O seguinte é um exemplo básico de uso.

import os from PIL import Image import torch from diffusers import QwenImageEditPipeline # 从Hugging Face Hub加载模型,模型会自动下载 pipeline = QwenImageEditPipeline.from_pretrained("Qwen/Qwen-Image-Edit") # 如果你有可用的GPU,将模型移至GPU以加速计算 pipeline.to("cuda") # 打开本地的原始图片 image = Image.open("./input.png").convert("RGB") # 设定你的编辑指令 prompt = "把这只熊手里的东西换成画板和画笔" # 配置生成参数 inputs = { "image": image, "prompt": prompt, "generator": torch.manual_seed(0), # 设置随机种子以确保结果可复现 "true_cfg_scale": 4.0, "negative_prompt": " ", # 可以留空或输入不希望出现的内容 "num_inference_steps": 50, # 推理步数,越高细节可能越好,但耗时越长 } # 执行推理 with torch.inference_mode(): output = pipeline(**inputs) # 获取并保存生成的图片 output_image = output.images[0] output_image.save("output_image_edit.png") print("图片已保存至:", os.path.abspath("output_image_edit.png"))

3. usado na plataforma AliCloud Hundred Refinement

A AliCloud Hundred Refinement Platform fornece chamadas de API que são adequadas para os desenvolvedores integrarem em seus aplicativos.

- Serviço aberto: Em primeiro lugar, você precisa abrir o serviço de modelo na AliCloud Hundred Refinement Platform e obter a chave de API.

- Ambiente de configuraçãoConfigure a chave de API adquirida em uma variável de ambiente e instale o DashScope SDK (suporte a Python e Java) conforme necessário.

- Chamando a APIInvocar o modelo enviando uma solicitação HTTP POST para o endpoint de API especificado. O corpo da solicitação precisa conter o nome do modelo (

qwen-image-edit), a imagem de entrada (geralmente em formato de URL) e o comando de texto.

Por exemplo, usando ocurlUm exemplo de solicitação é mostrado abaixo:curl --location 'https://dashscope-intl.aliyuncs.com/api/v1/services/aigc/multimodal-generation/generation' \ --header 'Content-Type: application/json' \ --header "Authorization: Bearer $DASHSCOPE_API_KEY" \ --data '{ "model": "qwen-image-edit", "input": { "messages": [ { "role": "user", "content": [ { "image": "https://dashscope.oss-cn-beijing.aliyuncs.com/images/dog_and_girl.jpeg" }, { "text": "将图中的人物改为站立姿势,弯腰握住狗的前爪" } ] } ] }, "parameters": {} }'Depois que a chamada à API for bem-sucedida, os dados retornados conterão o URL da imagem gerada. Observe que o URL tem um período de validade de 24 horas e precisa ser salvo a tempo.

cenário do aplicativo

- comércio eletrônico

Os comerciantes podem modificar rapidamente as imagens dos produtos, como alterar o plano de fundo do produto para se adequar a diferentes temas promocionais, corrigir falhas na imagem ou alterar a cor da roupa em uma imagem de modelo sem precisar refazer a fotografia. - Criação de conteúdo de mídia social

Os usuários podem facilmente adicionar elementos criativos às suas fotos, alterar planos de fundo, remover transeuntes ou converter fotos em estilos específicos (por exemplo, anime, pinturas a óleo) para criar conteúdo mais envolvente. - Publicidade e design

Os designers podem usar o modelo para gerar rapidamente os primeiros rascunhos de designs e pôsteres. Por exemplo, modificar ou adicionar slogans promocionais e ajustar a cor e a posição dos elementos da tela diretamente na imagem aumenta muito a eficiência do trabalho. - Entretenimento pessoal e criação de IP

Os usuários podem recriar imagens de seus animais de estimação ou personagens favoritos, criar diferentes emoticons, fantasias e cenas para eles e criar facilmente imagens de IP personalizadas.

QA

- O modelo Qwen-Image-Edit é gratuito?

O modelo é de código aberto sob a licença Apache 2.0, o que significa que você pode baixá-lo e usá-lo gratuitamente e é permitido para fins comerciais. Se ele for invocado por meio de uma plataforma de serviços em nuvem, como a AliCloud, poderá ser cobrada uma taxa com base na estratégia de preços da plataforma. - Com que tipo de comandos de edição esse modelo pode lidar?

Ele pode lidar com dois tipos principais de comandos: um é a "edição de aparência", que é muito específica, como "tornar esta flor azul" ou "remover o poste de luz no canto superior direito da imagem"; o outro é a "edição semântica", que é mais focada na criatividade e no estilo, como "transformar esta foto em um estilo Van Gogh" ou "fazer este personagem parecer mais feliz". Na "edição semântica", as instruções são mais voltadas para a criatividade e o estilo, como "transforme esta foto em um estilo Van Gogh" ou "faça com que este personagem pareça mais feliz". Enquanto isso, uma de suas habilidades mais proeminentes é a edição precisa de texto em imagens. - É necessário ter conhecimento de programação para usar esse modelo?

Não é necessário. Para usuários normais, você pode usar a interface gráfica diretamente no Space fornecido pela comunidade Hugging Face ou na função "Image Edit" no site da Tongyiqianqian, apenas carregando imagens e digitando texto. Para os desenvolvedores, é possível usar o código Python oficial ou a interface API para integrá-lo ao seu próprio aplicativo. - Qual é a diferença em relação a outras ferramentas de edição de imagens com IA?

A principal vantagem do Qwen-Image-Edit são seus poderosos recursos de renderização e edição de texto em chinês e inglês, que permitem a modificação direta e precisa do conteúdo do texto na imagem, o que é difícil de fazer com muitos outros modelos. Além disso, ele atinge um bom equilíbrio entre a necessidade de manter os detalhes da imagem original (aparência) e a necessidade de realizar modificações criativas (semântica) por meio de sua exclusiva tecnologia de caminho duplo.