Kling AI O Motion Control é uma ferramenta baseada em nuvem para controle de movimento de IA e geração de animação de personagens com base no modelo de vídeo Kling de ponta. A função principal da plataforma é a “Migração de movimento”, que permite que os usuários carreguem uma imagem estática de um personagem e um vídeo de referência contendo ações específicas. A IA pode extrair a dinâmica do esqueleto, os movimentos físicos e as expressões faciais no vídeo e replicá-los com alta precisão na imagem estática do personagem para fazê-lo “se mover”. "mover". Contando com os mais recentes Kling Com os modelos 2.6 e 3.0, a ferramenta elimina o gargalo de duração da geração tradicional de vídeo com IA, suportando a geração de até 30 segundos de vídeo em movimento contínuo em uma única passagem, sem a necessidade de emenda na pós-produção. Seja uma dança complexa de corpo inteiro, uma pose sutil de mão ou um comportamento facial natural, ela pode obter uma reprodução física altamente sincronizada. Para criadores de vídeos curtos, profissionais de marketing e animadores, ele oferece uma solução de limiar extremamente baixo que elimina a necessidade de equipamentos caros de captura de movimento e modelagem complexa de software, além de permitir a produção eficiente de animação de personagens com qualidade cinematográfica com apenas “uma imagem, um vídeo”.

Lista de funções

- Geração de vídeo contínuo ultralongoO DanceShow é uma ferramenta de vídeo famosa no setor que suporta a geração de vídeos de ação contínua de até 30 segundos de duração em uma única passagem. A coerência de toda uma dança ou apresentação é preservada, eliminando a necessidade de geração de vários clipes e emendas na pós-produção.

- Migração de movimentos de corpo inteiro de alta precisãoA IA pode capturar e extrair com precisão os nós do esqueleto, as trajetórias de movimento e o centro de gravidade do personagem no vídeo de referência. Quer se trate de corrida, salto, artes marciais ou movimentos complexos de dança de rua, todos eles podem ser perfeitamente sincronizados com o personagem da imagem de destino, para que você possa dizer adeus à sensação de rigidez do tipo “marionete em uma corda”.

- Sincronização de expressões faciais e gestosO modelo também pode reconhecer e migrar com precisão dinâmicas locais sutis, incluindo sincronização labial, mudanças de microexpressão e movimentos complexos de cruzamento de dedos e interação com objetos.

- Ampla gama de compatibilidade de ativos de imagemImagem de personagem: suporta a entrada de imagens de personagens em uma ampla variedade de estilos, incluindo impressões fotográficas reais, ativos modelados em 3D, ilustrações secundárias de anime e muito mais. Imagens estáticas de qualquer estilo visual podem ser ativadas como vídeo em movimento, desde que os requisitos básicos de tamanho e escala sejam atendidos.

- Qualidade de imagem cinematográfica e realismo físicoO vídeo de saída segue rigorosamente as leis da física realista em termos de movimento do tecido, transições de luz e sombra e alongamento muscular para manter a coerência final e a consistência do personagem de quadro a quadro, incorporando os recursos subjacentes de geração de vídeo do Kling 3.0.

- Adaptação flexível da escala de quadrosEle suporta o ajuste de proporção com um clique para diferentes plataformas de distribuição, abrangendo uma variedade de proporções de aspecto convencionais, como 16:9 (vídeo horizontal), 9:16 (vídeo curto vertical de mídia social) e 1:1 (conteúdo quadrado).

Usando a Ajuda

Início rápido da plataforma e descrição do ambiente

O controle de movimento da Kling AI é umFunciona exclusivamente na Webe ferramentas SaaS baseadas em nuvem.Não há necessidade de fazer download e instalar nenhum cliente local, nem de placas gráficas caras e de alto desempenho.. Basta usar um navegador moderno (recomenda-se o Google Chrome ou o Microsoft Edge) para acessar o endereço da Web https://www.klingaimotioncontrol.comSe você se registrar e fizer login na sua conta, poderá ligar diretamente para o cluster de supercomputação em nuvem para abrir a geração de vídeo.

Para que você possa começar imediatamente e garantir que possa obter uma taxa de sucesso de sincronização de movimento 100% em sua primeira geração, leia o guia detalhado a seguir sobre o processo completo de operação.

🛠️ Etapa 1: Preparação e especificação de material de alta qualidade

Antes de começar, preparar uma filmagem que esteja em conformidade com a lógica de reconhecimento subjacente do mecanismo de IA é fundamental para o sucesso ou o fracasso do vídeo final. Siga rigorosamente as seguintes especificações físicas:

- Preparação da imagem do personagem

- Requisitos de tamanhoPara garantir que a IA seja capaz de reconhecer com precisão as características faciais e as articulações dos membros, o lado mais curto da imagem é resolvido em uma resolução deNão menos que 300 pixels。

- Limites de proporcionalidadeA proporção da imagem suportada deve ser controlada em Entre 2:5 e 5:2. Panoramas muito finos ou imagens em widescreen extremo serão rejeitados pelo sistema.

- Sugestões de composição: é altamente recomendável ter um plano de fundo limpo (cor sólida ou sem interferências)Foto de frente ou de costas. Evite membros de personagens que estejam muito obscurecidos por objetos em primeiro plano, o que pode reduzir muito a dificuldade da IA para desnudar o objeto.

- Preparação do vídeo de referência de movimento

- Duração e taxa de quadrosObservação: Corte seu vídeo para menos de 30 segundos; recomenda-se um vídeo suave a 30 FPS ou 60 FPS para evitar que o desfoque de movimento cause falha na captura de ossos da IA.

- Especificação principalOs personagens do vídeo devemSempre no enquadramento da câmeraO personagem não deve parecer estar saindo do quadro. É melhor que o personagem use roupas justas ou bem definidas e evite saias ou túnicas muito largas, pois a IA não conseguirá calcular com precisão a verdadeira posição das articulações das pernas.

Fase 2: SOPs (Procedimentos Operacionais Padrão) das funções de controle de movimento

Etapa 1: Importe sua imagem estática do personagem

Depois de fazer login no workbench, na interface principal do Image Input(Entrada de imagem), clique no botão Upload e arraste a imagem em formato JPG ou PNG da pessoa que você preparou para a caixa de upload. O sistema executará automaticamente a análise inicial; se o tamanho não atender ao padrão, será exibida uma janela pop-up, siga as instruções para cortar a imagem.

Etapa 2: Carregue um vídeo de referência de ação e extraia o esqueleto

ao lado de Video Reference(referência de vídeo), carregue seu vídeo de ação gravado ou baixado. Depois de carregado, o modelo Kling inicia automaticamente a “desmontagem visual” na nuvem, extraindo os nós ósseos do OpenPose, as informações de profundidade da mão e os dados de mapeamento da expressão facial da pessoa no vídeo. Não é necessária nenhuma intervenção humana.

Etapa 3: Escreva um prompt de texto (Prompt)

Muitos usuários se perguntam: por que você precisa de texto quando já tem imagens e vídeos?

Isso ocorre porque a palavra-chave podeForça um bloqueio no ambiente de fundo, na textura da luz e no movimento da câmera do vídeoevitando a distorção de fundo do vídeo na geração de vários quadros.

- Estrutura de frase recomendada:

[画面主体描述] +[背景环境] + [光影质感] + [摄影机镜头] - Excelente exemplo:“A highly detailed cinematic shot, the character is dancing in a neon-lit cyberpunk street, dark rainy night, volumetric lighting, stationary camera, 4k resolution.” (Close-ups cinematográficos de personagens dançando em ruas cyberpunk de neon, escuras e chuvosas, iluminação volumétrica, câmera fixa, resolução 4K).

Etapa 4: Configurar parâmetros avançados de geração (tamanho e duração)

- Relação de aspectoEscolha de acordo com seu canal de publicação. Jitterbug/TikTok/Reels Escolha de forma decisiva! 9:16Vídeo de paisagem do site do YouTube/B, selecione 16:9。

- Duração do vídeoDuração do vídeo: O padrão do sistema é geralmente 5 segundos. Se você estiver carregando um vídeo de referência que seja uma dança completa de 30 segundos, puxe a duração no menu suspenso para a mais longa 30 Seconds。

- Dica: quanto maior a duração, mais energia de computação em nuvem (pontos) será consumida. Recomenda-se selecionar 5 segundos para a “versão de teste” primeiro para garantir que o movimento não seja moldado e que o rosto não seja quebrado antes de gerar a versão completa de 30 segundos.

Etapa 5: Enviar tarefas e download de vídeo

Depois de verificar se todos os parâmetros estão corretos, clique na parte inferior da atraente tela Gerar botão. A tarefa entrará na sequência de enfileiramento da nuvem. Para um vídeo completo de 30 segundos, normalmente há uma espera de 3 a 5 minutos devido aos grandes cálculos físicos entre quadros envolvidos.

Depois de gerada, a página será exibida diretamente no player incorporado. Você pode visualizar a precisão da sincronização de movimentos em tempo real. Depois de confirmar que você está satisfeito, clique no canto inferior direito da página Baixar Ícone para salvar arquivos de vídeo MP4 com movimento perfeito localmente em seu computador, prontos para pós-edição ou distribuição direta.

Fase 3: técnicas de prevenção de fossas e de aprimoramento da qualidade de nível superior

Para levar seu trabalho além da média dos usuários do 90%, domine as seguintes regras de progressão:

- Como evitar a ilusão de uma mão extra?

Se o personagem no vídeo de referência estiver com os braços cruzados sobre o peito ou se a mão passar sobre o rosto com frequência, a IA estará propensa a erros de cálculo computacionais (comumente conhecidos como "mould piercing") durante a conversão de imagem para vídeo.solução (um problema de matemática)Acrescentar palavras positivas às dicasperfect anatomy, clear hands, distinct limbsUse vídeos de referência com membros esticados e movimentos amplos sempre que possível. - Como você garante que o plano de fundo esteja absolutamente imóvel?

Se não precisar de um trabalho de câmera complexo e quiser apenas que os personagens se movam sem que o plano de fundo se mova, certifique-se de terminar a deixa comstatic background, locked camera, no camera movementIsso poupa à IA o poder de calcular as alterações do plano de fundo e coloca toda a qualidade no realismo dos movimentos do personagem.

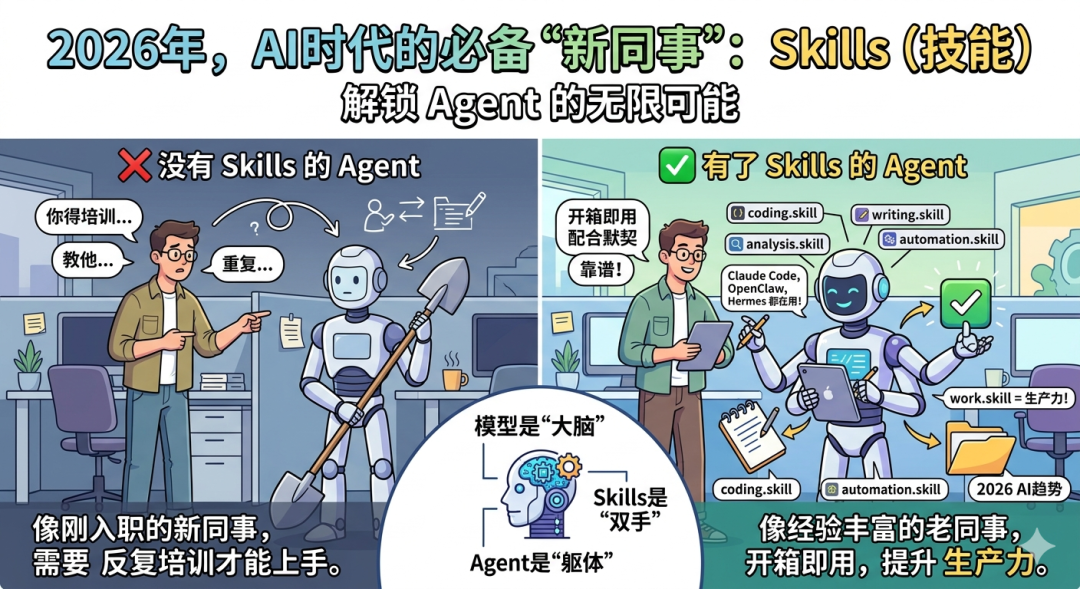

cenário do aplicativo

- Criação de vídeo de dança viral em plataforma de mídia social

Os blogueiros de vídeos curtos e os criadores secundários podem usar essa ferramenta para combinar personagens ilustrados de anime ou capturas de tela de modelagem de jogos com os vídeos de dança ao vivo mais populares do Jittery e do TikTok. Com um único clique, eles podem gerar vídeos extremamente suaves de personagens secundários “dançando junto”, capturando rapidamente os pontos de acesso do tráfego. - Operações de baixo custo do Virtual Idol e do Digital Advocate

As marcas não precisam construir estúdios de captura de movimento de centenas de milhares de dólares nem usar trajes de captura de movimento. Elas só precisam permitir que uma equipe qualquer grave um discurso ou um vídeo interativo com movimentos corporais, mescle-o com a imagem estática do mascote virtual da marca e, em seguida, possam produzir a transmissão oficial e os materiais promocionais do porta-voz virtual com alta frequência. - Visualização conceitual de animação de filmes e desenvolvimento de jogos

Na fase de pré-projeto, os artistas e animadores de jogos podem gerar instantaneamente uma prévia da inércia física do movimento do personagem com base no layout conceitual 2D do personagem, juntamente com movimentos de artes marciais ou vídeos de caminhada e salto de atores ao vivo. Isso elimina a necessidade do tradicional K-framing manual e valida rapidamente o design do personagem. - Marketing personalizado e conteúdo social criativo falso

Os usuários comuns podem usar as fotos frontais de seus amigos ou materiais de modelo estático, aplicando modelos de ação exagerados e bem-humorados (por exemplo, gestos engraçados com as mãos, inclinação exagerada para trás etc.) da Internet, para gerar pacotes de emojis de vídeo curto ou anúncios interativos com um forte senso de contraste, o que pode aumentar muito a diversão do conteúdo e a taxa de compartilhamento social.

QA

- Há algum requisito específico para o upload de imagens estáticas de pessoas?

As imagens devem ser maiores ou iguais a 300 pixels no lado mais curto e manter uma proporção entre 2:5 e 5:2. Para garantir a geração de movimento natural, é altamente recomendável que você carregue uma imagem de figura inteira ou meia-figura de uma pessoa sem oclusão significativa de membros e com um fundo relativamente limpo. - Qual é a duração máxima do vídeo gerado pela ferramenta?

Com o poder de computação do modelo Kling, a ferramenta agora suporta a geração de até 30 segundos de vídeo contínuo em uma única passagem. Isso elimina a necessidade de gerar clipes de 4 segundos várias vezes e depois juntá-los, tornando-a ideal para processar sequências completas e apresentações de dança. - O rosto no vídeo de referência substituirá o rosto na imagem que eu carreguei?

Absolutamente não. O algoritmo subjacente da ferramenta usa a lógica de “remoção e migração de movimentos”. Ele extrai apenas os movimentos do esqueleto, as trajetórias físicas e as alterações dos músculos faciais do vídeo de referência e aplica esses “dados dinâmicos” à imagem que você carrega. O vídeo resultante preserva rigorosamente as características faciais e a consistência da identidade das pessoas nas imagens estáticas. - Por que os membros do personagem estão distorcidos ou misturados no meu vídeo gerado?

Isso geralmente é causado pela qualidade do vídeo de referência. A IA poderá reconhecer incorretamente os ossos se o personagem no vídeo de referência estiver usando roupas extremamente largas (que ocultam as articulações reais), se mover muito rápido, o que resulta em sombras pesadas, ou se houver sobreposição e oclusão de membros em alta frequência. Recomenda-se substituir o vídeo de referência por um que seja bem iluminado, tenha movimentos claros e suaves e roupas que se ajustem bem. - Há suporte para a migração de expressões faciais detalhadas e movimentos das mãos?

O Kling AI Motion Control não apenas sincroniza os movimentos macro do tronco e dos membros, mas também suporta a migração de alta precisão do movimento das articulações das mãos, bem como a sincronização de pequenas expressões faciais, como formas de lábios e olhos.