多LoRA加载的解决方案

在使用vllm-cli同时加载多个LoRA适配器时,建议采用以下方法:

- 参数组合:通过–lora-modules参数指定多个适配器路径,格式为”name1:path1,name2:path2″

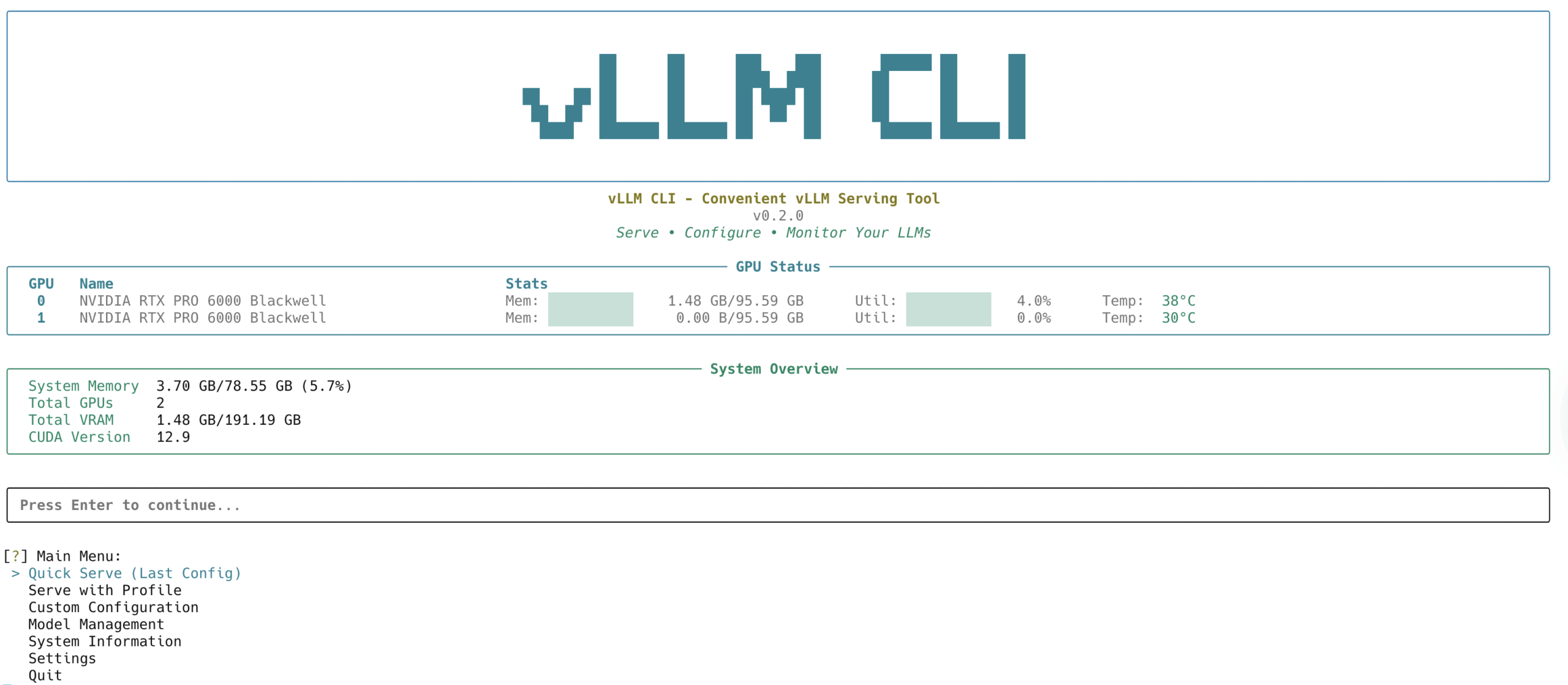

- 显存规划:每个LoRA约占用200-500MB显存,加载前先用vllm-cli info确认剩余显容

- <strong]版本兼容:确保所有LoRA适配器与基础模型版本匹配

- 加权融合:高级用户可通过–lora-extra-config参数传入权重配置

操作示例:

vllm-cli serve base_model –lora-modules “adapter1:/path/lora1,adapter2:/path/lora2”

常见问题排查:若出现加载失败,首先检查各LoRA的README.md确认兼容性,然后单独加载每个适配器测试。建议先在交互模式下测试单个LoRA正常后再进行组合加载。

本答案来源于文章《vLLM CLI:使用 vLLM 部署大语言模型的命令行工具》