部署Qwen3-235B-A22B-Thinking-2507需要以下步骤:

- 环境准备:硬件要求包括88GB显存用于BF16版本,或30GB显存用于FP8版本。软件方面,需安装Python 3.8+、支持CUDA的PyTorch以及Hugging Face的transformers库(版本≥4.51.0)。

- 模型下载:使用

huggingface-cli download Qwen/Qwen3-235B-A22B-Thinking-2507下载模型文件(BF16版本约437.91GB,FP8版本约220.20GB)。 - 加载模型:使用transformers加载模型:

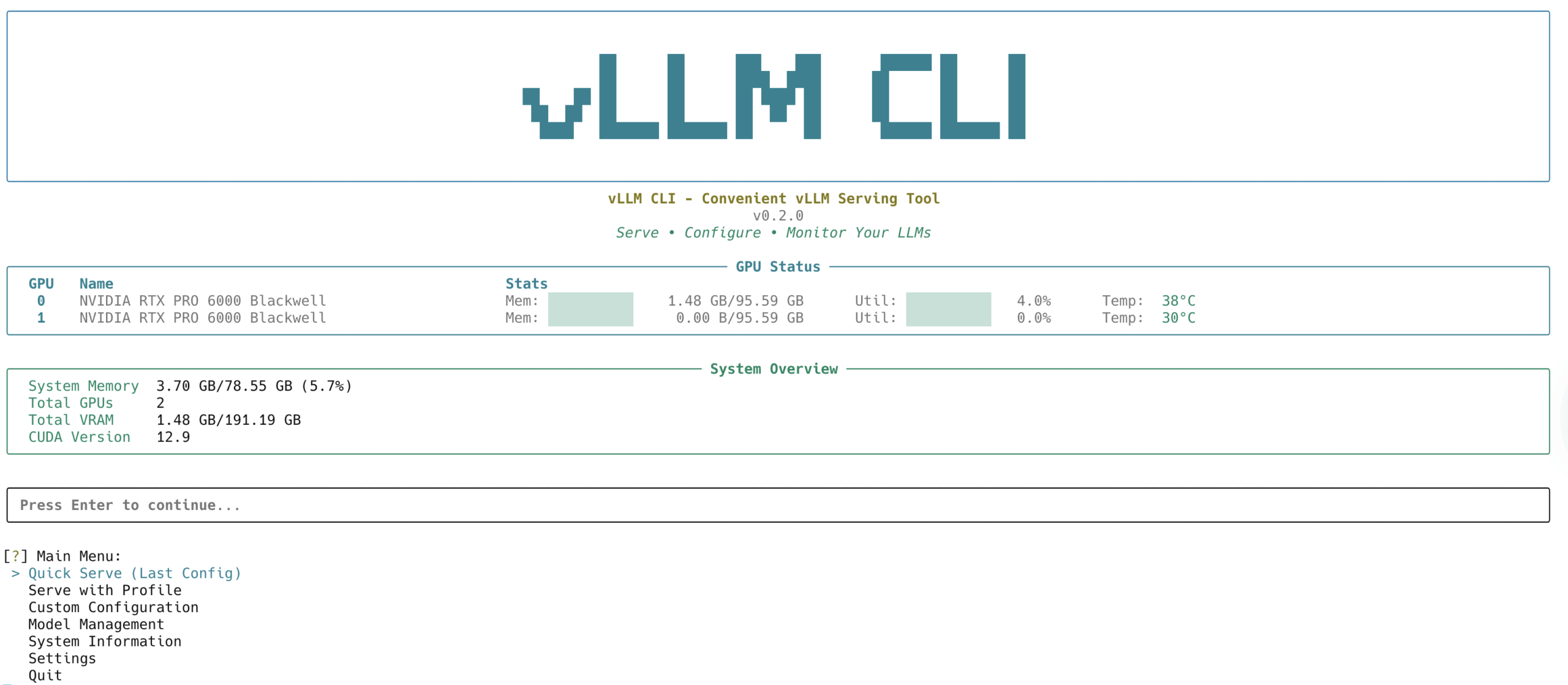

AutoModelForCausalLM.from_pretrained,可指定torch_dtype="auto"和device_map="auto"自动分配资源。 - 优化配置:对于本地运行,可通过降低上下文长度(如32768令牌)或使用sglang/vLLM框架优化推理性能。

如需工具调用功能,还需配置Qwen-Agent,定义工具接口。

本答案来源于文章《Qwen3-235B-A22B-Thinking-2507:支持复杂推理的大型语言模型》