prescrição

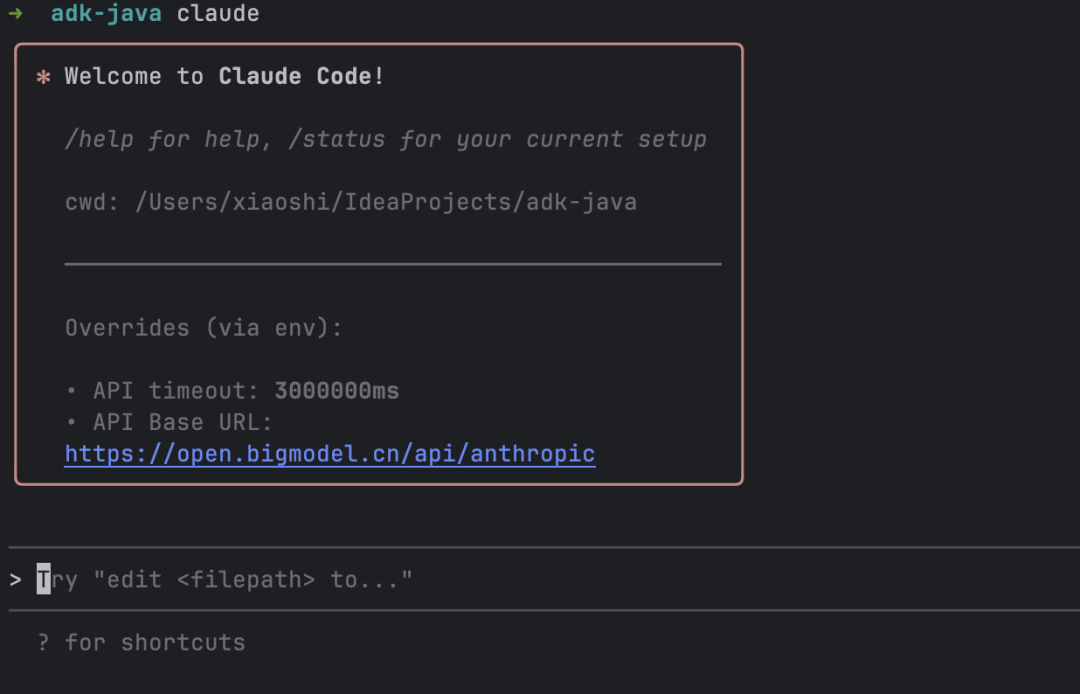

A interface compatível com OpenAI por meio do Gemini-CLI-2-API permite uma integração perfeita com as cadeias de ferramentas existentes. As etapas são descritas a seguir:

- Implantação de serviços locais: Primeiramente por

npm installInstale as dependências e use onode openai-api-server.jsIniciar o serviço (porta padrão 8000) - Configuração do endereço do terminalAltere o endereço do ponto de extremidade da API para as ferramentas existentes para

http://localhost:8000/v1 - Atualização do formato da solicitaçãoContinuação do uso do corpo de solicitação JSON padrão da OpenAI (por exemplo

/v1/chat/completions(Pontos finais) - Adaptação de autenticaçãoSe a ferramenta original usar uma chave de API, inicie o serviço por meio do comando

--api-keyOs parâmetros definem a mesma chave

As vantagens são: 1) Conversão automática do formato de solicitação/resposta; 2) Suporte a streaming; 3) Manutenção do método original de chamada de função. Aplicável a LangChain, AutoGPT e outras estruturas.

Essa resposta foi extraída do artigoGemini-CLI-2-API: convertendo a CLI do Gemini em um serviço de API nativa compatível com OpenAIO