As etapas a seguir precisam ser concluídas para usar o modelo Ollama local:

- Preparação ambientalVerifique se o Node.js (v18+) e o npm estão instalados no sistema

- instalação global: Implementação

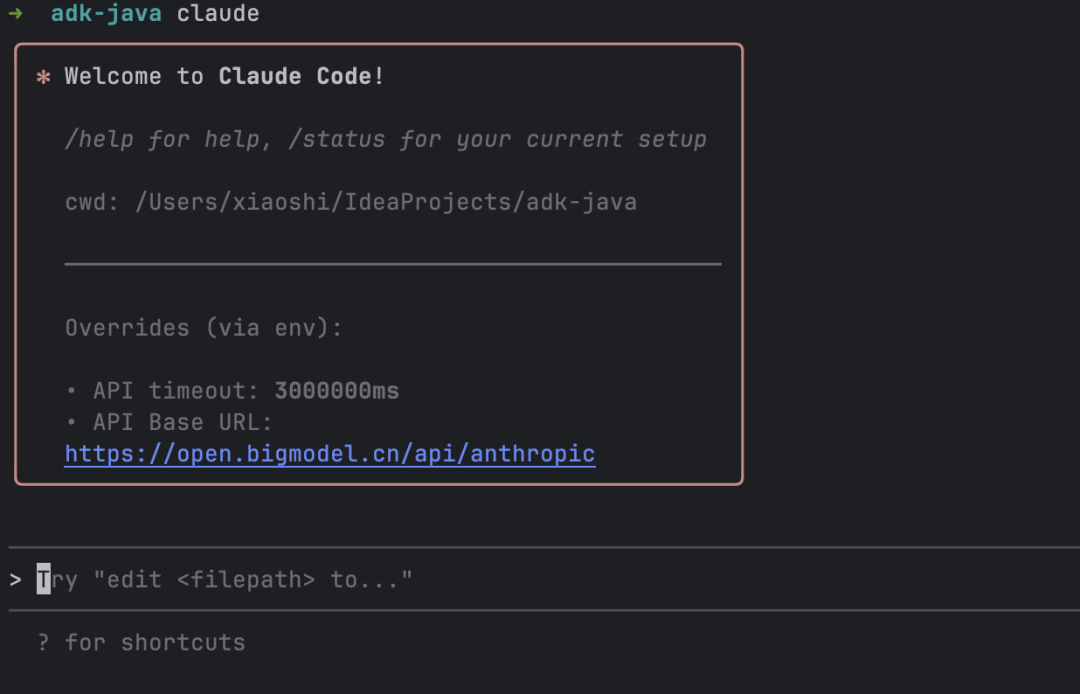

npm install -g @motesoftware/nanocodercomando - Ollama Meio Ambiente::

- Instale e execute o serviço Ollama de forma independente

- aprovar (um projeto de lei ou inspeção etc.)

ollama pull qwen2:0.5bFaça o download do modelo necessário (o exemplo é um modelo paramétrico leve de 0,5B)

- conexão automáticaExecutar diretamente do diretório do projeto

nanocoderA ferramenta detecta automaticamente o serviço Ollama local.

Observe que os modelos maiores (por exemplo, 7B e superiores) exigem mais de 8 GB de RAM e uma placa de vídeo discreta para funcionar sem problemas, portanto, os usuários iniciantes são aconselhados a experimentar primeiro os modelos menores.

Essa resposta foi extraída do artigoNanocoder: uma ferramenta de geração de código que é executada no terminal localO