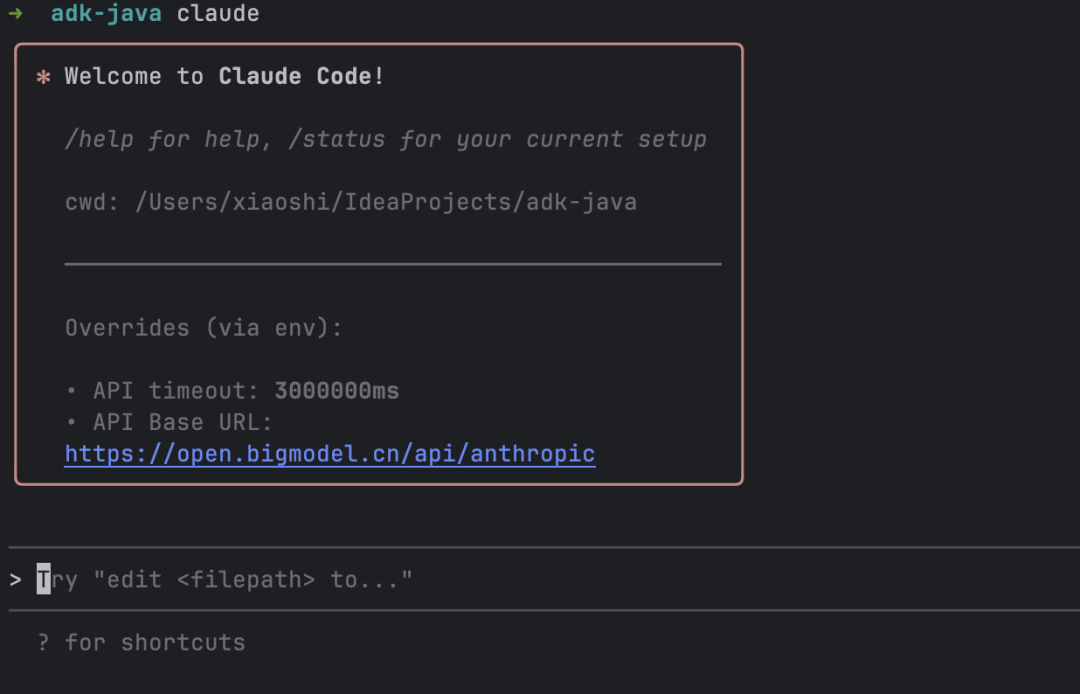

O nanocoder é inovador para alcançar a capacidade de alternância dinâmica entre modelos leves locais e modelos grandes na nuvem, e essa arquitetura híbrida resolve a contradição de longa data de privacidade e desempenho no campo de programação de IA. Em termos de implementação técnica, a ferramenta integra três modos de serviço de modelo por meio de uma camada de abstração de API unificada: o esquema Ollama, totalmente off-line, garante a confidencialidade do código e é adequado para lidar com a lógica comercial sensível; os principais modelos, como o GPT-4 acessado pelo OpenRouter, fornecem o recurso de geração de código mais forte e são adequados para cenários complexos, como o projeto arquitetônico; e as interfaces compatíveis com o OpenAI suportam modelos grandes implantados de forma privada. modelos, equilibrando os requisitos de desempenho e controle.

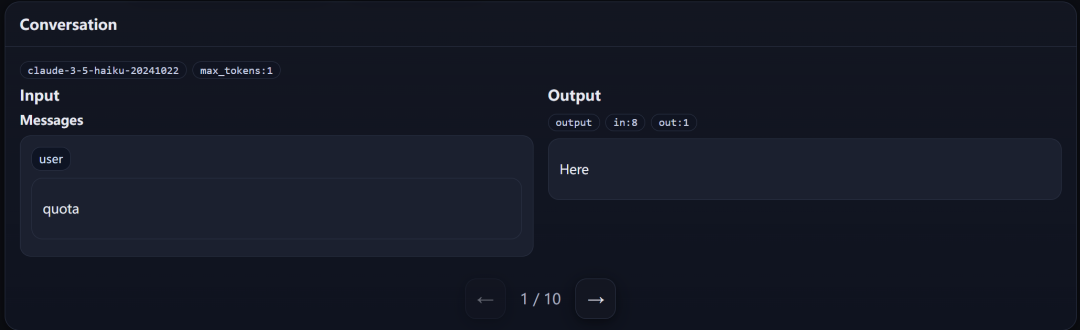

Os dados do teste de desempenho mostram que, em uma máquina de desenvolvimento equipada com uma placa de vídeo RTX 4090, o tempo de resposta de um modelo qwen2 executado localmente com parâmetros 7B é de 1,2 segundos/solicitação, enquanto o modelo Claude 3 na nuvem requer uma latência de rede de 3 segundos, mas gera um código com pontuação 37% superior em termos de qualidade. O inovador recurso de troca a quente de modelos do nanocoder permite que os desenvolvedores usem modelos locais ao escrever núcleos algorítmicos e alternem para modelos na nuvem com um único clique quando forem necessárias tarefas de baixa sensibilidade, como a geração de documentos. O inovador recurso de hot-swapping de modelos do nanocoder permite que os desenvolvedores usem o modelo local ao escrever o núcleo do algoritmo e alternem para o modelo em nuvem com um único clique para tarefas de baixa sensibilidade, como a geração de documentos, uma estratégia inteligente de otimização de desempenho que está sendo adotada por um número cada vez maior de desenvolvedores profissionais.

Essa resposta foi extraída do artigoNanocoder: uma ferramenta de geração de código que é executada no terminal localO