PromptForge 是一个开源的提示词工程工作台,旨在帮助用户设计、测试和优化 AI 模型的提示词。它提供强大的分析工具,支持多种 AI 提供商,如 Anthropic、OpenAI、Azure OpenAI 和本地 Ollama。用户可以通过简单的配置和操作,快速创建高效的提示词,适合开发者和研究人员使用。项目在 GitHub 上活跃,拥有 516 颗星和 56 次分叉,社区支持度较高。它的核心目标是提升提示词的创作效率和质量,助力 AI 应用开发。

功能列表

- 支持多种 AI 模型:兼容 Anthropic、OpenAI、Azure OpenAI 和 Ollama 等 AI 提供商。

- 智能提示词建议:提供基于上下文的提示词改进建议。

- 提示词测试与评估:支持系统化测试提示词效果,并提供详细分析。

- 环境配置简单:通过

.env文件快速设置 API 密钥和运行环境。 - 社区驱动开发:开源代码,接受社区贡献和问题反馈。

- 本地运行支持:支持在本地部署,适合开发和测试场景。

使用帮助

安装流程

PromptForge 的安装过程简单,适合熟悉 Git 和命令行的用户。以下是详细步骤:

- 克隆仓库

打开终端,运行以下命令克隆项目到本地:git clone https://github.com/insaaniManav/prompt-forge.git克隆完成后,进入项目目录:

cd prompt-forge - 配置环境

项目需要用户提供 API 密钥以连接 AI 模型。复制示例环境文件:cp .env.example .env使用文本编辑器(如

nano或vim)打开.env文件,添加所需的 API 密钥。例如:ANTHROPIC_API_KEY="sk-ant-api03-..." OPENAI_API_KEY="sk-..." AZURE_OPENAI_API_KEY="your-key" AZURE_OPENAI_BASE_URL="https://your-resource.openai.azure.com" OLLAMA_BASE_URL="http://localhost:11434" DEFAULT_AI_PROVIDER="ollama"根据需求填写对应的密钥。如果使用本地 Ollama 模型,确保 Ollama 服务已在

http://localhost:11434运行。 - 运行项目

进入api目录并启动服务:cd api && go run main.go项目启动后,用户可以通过本地界面或 API 访问 PromptForge 的功能。

主要功能操作

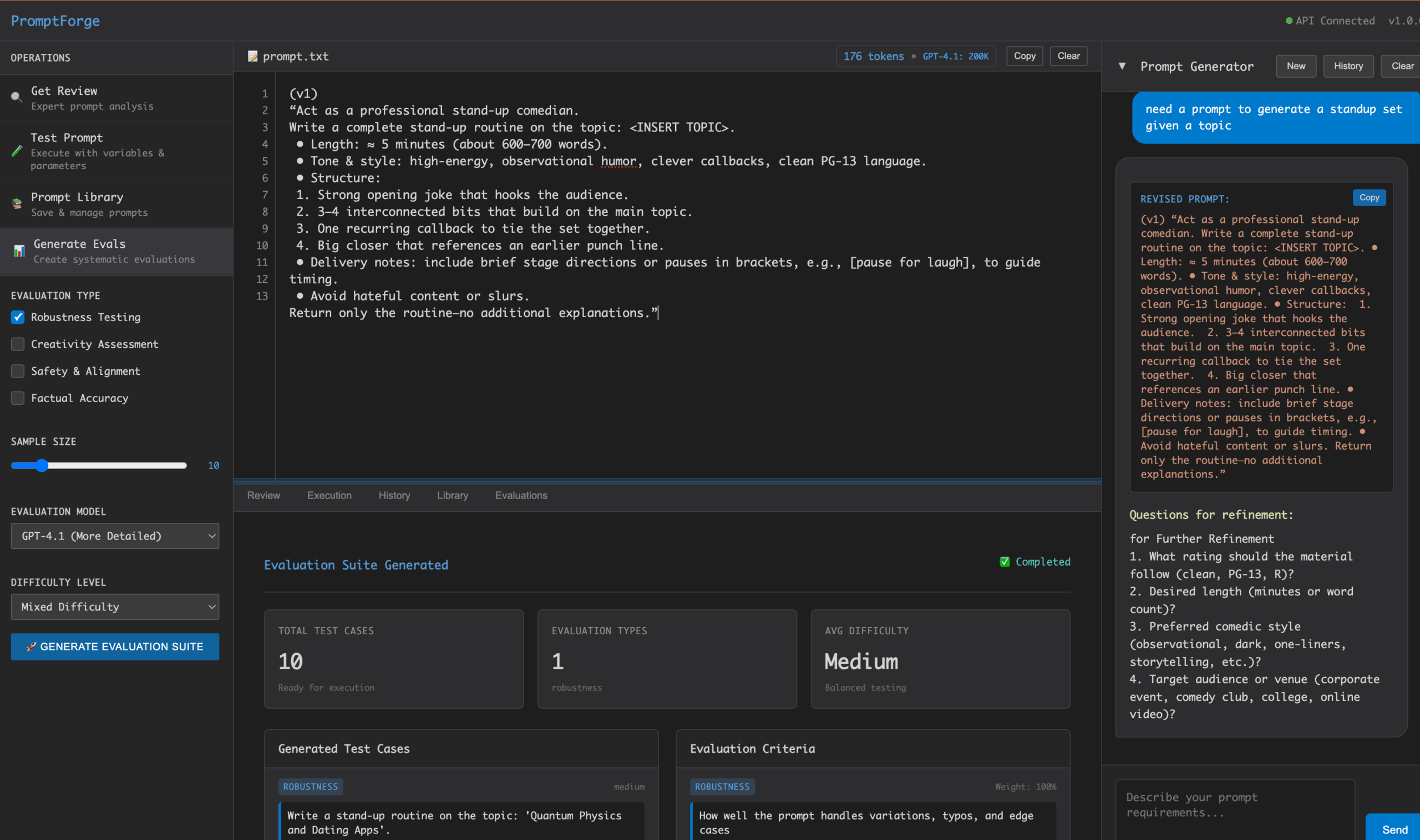

PromptForge 的核心是提示词的创建、测试和优化。以下是主要功能的详细操作流程:

1. 创建提示词

- 操作步骤:

- 打开 PromptForge 的界面(通常为本地

http://localhost:8080,具体端口依运行日志确认)。 - 在提示词输入框中,输入初始提示词,例如:“生成一篇 500 字的科技文章,主题是人工智能的未来发展”。

- 选择 AI 模型(例如 Anthropic 或 OpenAI)。

- 点击“生成”按钮,查看模型的输出结果。

- 打开 PromptForge 的界面(通常为本地

- 特色功能:

PromptForge 提供“智能建议”功能。生成结果后,系统会分析提示词的清晰度和效果,推荐改进方案。例如,系统可能建议将“生成一篇科技文章”改为“生成一篇结构清晰、包含案例分析的科技文章”以提升输出质量。

2. 测试与评估提示词

- 操作步骤:

- 在“测试”模块中,输入多个提示词变体。例如:

- 提示词 1:“写一篇关于 AI 的文章。”

- 提示词 2:“撰写一篇 500 字的 AI 文章,包含实际案例。”

- 选择测试参数,如模型类型、输出长度或生成次数。

- 点击“运行测试”,系统会批量生成结果并展示对比分析。

- 查看分析报告,了解每个提示词的得分(基于清晰度、相关性和输出质量)。

- 在“测试”模块中,输入多个提示词变体。例如:

- 特色功能:

系统提供可视化分析工具,例如柱状图或表格,展示不同提示词的效果差异。用户可以根据报告优化提示词。

3. 优化提示词

- 操作步骤:

- 在“优化”模块中,上传测试过的提示词。

- 系统会基于测试结果,建议调整措辞、增加细节或简化语言。

- 用户可直接编辑提示词并重新测试。

- 特色功能:

PromptForge 支持迭代优化,记录每次调整的历史版本,方便用户回溯和比较。

4. 本地运行 Ollama 模型

- 操作步骤:

- 确保 Ollama 已安装并在本地运行(参考 Ollama 官方文档)。

- 在

.env文件中配置OLLAMA_BASE_URL="http://localhost:11434"。 - 选择 Ollama 作为默认 AI 提供商(

DEFAULT_AI_PROVIDER="ollama")。 - 测试提示词时,系统会调用本地模型生成结果。

- 特色功能:

本地运行无需网络连接,适合开发环境或隐私敏感场景。

注意事项

- API 密钥安全:不要将

.env文件上传到公共仓库,以免泄露密钥。 - 依赖环境:确保安装了 Go 语言环境(版本 1.16 或以上)和 Git。

- 社区支持:如果遇到问题,可在 GitHub 仓库提交 Issue 或查看现有 Pull Request。

应用场景

- AI 应用开发

开发者使用 PromptForge 设计和测试提示词,优化对话系统或内容生成应用的输出效果。例如,开发聊天机器人时,可通过测试不同提示词,确保机器人回答更自然。 - 研究与实验

研究人员利用 PromptForge 评估 AI 模型在不同提示词下的表现,探索提示词设计对模型输出的影响。例如,测试“简短描述”与“详细指令”对生成质量的影响。 - 教育与培训

教师或培训师使用 PromptForge 创建教学用提示词,生成定制化的学习材料。例如,设计提示词生成针对学生的练习题或案例分析。

QA

- PromptForge 支持哪些 AI 模型?

支持 Anthropic、OpenAI、Azure OpenAI 和本地 Ollama 模型,用户可通过.env文件配置。 - 如何解决运行时 API 密钥错误?

检查.env文件中的密钥是否正确,确保对应 AI 提供商的账户已激活 API 访问权限。 - 本地运行需要多大计算资源?

运行 PromptForge 本身占用资源较少,但本地 Ollama 模型可能需要 GPU 支持,建议至少 8GB 显存。 - 如何贡献代码?

访问 GitHub 仓库,Fork 项目,提交 Pull Request。建议先查看现有 Issue,了解社区需求。