Em 5 de agosto de 2025. OpenAI lançou uma bomba com o lançamento oficial de dois modelos chamados gpt-oss-120b 和 gpt-oss-20b do modelo de linguagem de código aberto. Essa mudança marca a primeira vez desde GPT-2 desde então.OpenAI voltou ao código-fonte aberto para modelagem de linguagem em larga escala pela primeira vez, um movimento amplamente visto como sua resposta à crescente concorrência no mercado, particularmente no setor de Meta 的 Llama Séries e Mistral AI e outras respostas diretas no contexto do aumento do poder do código aberto.

Esses dois modelos estão em Apache 2.0 Lançado sob licença, ele permite que desenvolvedores e empresas tenham liberdade para experimentar, personalizar e até mesmo implementar comercialmente sem se preocupar com riscos de direitos autorais ou patentes.

Caracterização de modelos e personalização profunda

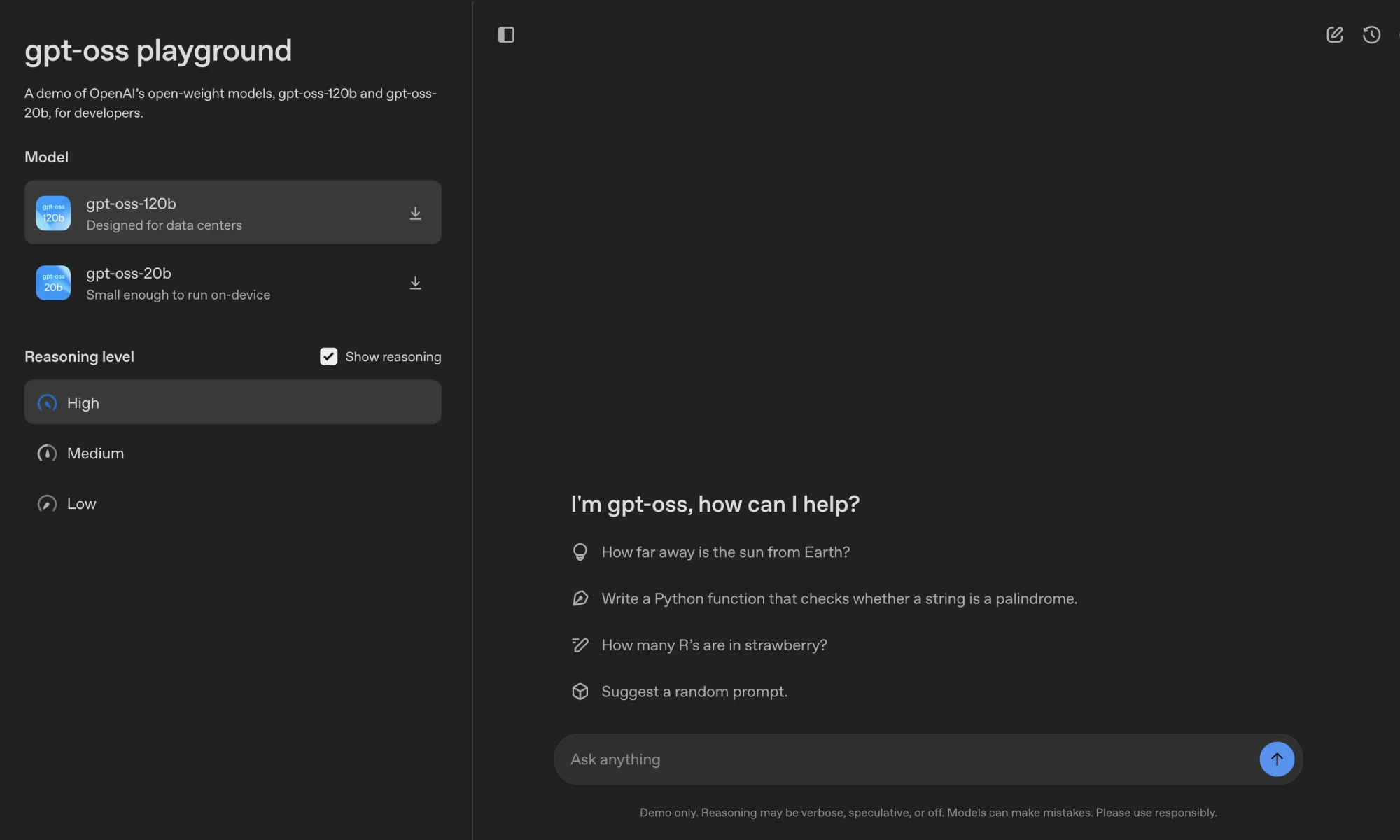

OpenAI Enfatizando isso.gpt-oss O modelo foi projetado para fluxos de trabalho inteligentes (agentes) com recursos avançados de acompanhamento de comandos, uso de ferramentas e raciocínio. Seus principais recursos incluem:

- Projetado para tarefas corporais inteligentesOs modelos têm recursos internos avançados para usar ferramentas como pesquisas na Web e

Pythonexecução de código, o que o torna altamente promissor para a criação de fluxos de tarefas automatizados complexos. - Profundamente personalizávelOs usuários podem ajustar a força de inferência do modelo entre os níveis baixo, médio e alto, de acordo com cenários de aplicação específicos. Enquanto isso, o modelo suporta o ajuste fino de parâmetros completos, oferecendo o máximo de espaço para personalização.

- Cadeia de pensamento:

OpenAIOptando por não supervisionar diretamente a cadeia de raciocínio (CoT) desse modelo, os desenvolvedores podem acessar todo o seu processo de raciocínio. Isso não apenas facilita a depuração e promove a confiança nos resultados do modelo, mas também oferece à comunidade de pesquisa uma oportunidade valiosa de monitorar e estudar o comportamento do modelo.

OpenAI Um Playground on-line simples é fornecido para permitir que os desenvolvedores experimentem os recursos interativos de ambos os modelos diretamente no navegador.

Arquitetura técnica e desempenho

gpt-oss A série usa a mesma tecnologia que a GPT-3 semelhante Transformer e introduziu a tecnologia Mixture-of-Experts (MoE) para aumentar a eficiência.MoE A arquitetura reduz significativamente o custo computacional, ativando apenas alguns dos parâmetros necessários para processar a tarefa em questão.

gpt-oss-120bO modelo tem 117 bilhões de parâmetros no total, mas não é fácil processar cada um deles. token Apenas 5,1 bilhões de parâmetros foram ativados na época.gpt-oss-20bO modelo tem 21 bilhões de parâmetros totais e 3,6 bilhões de parâmetros ativados.

Ambos os modelos suportam comprimentos de contexto de até 128k e usam atenção agrupada de várias consultas e incorporação de posição rotacional (RoPE) para otimizar a inferência e a eficiência da memória.

Detalhes da arquitetura do modelo

| modelagem | andar | parametrização geral | Parâmetros ativos para cada token | Número total de especialistas | Número de especialistas ativos por token | Comprimento do contexto |

|---|---|---|---|---|---|---|

| gpt-oss-120b | 36 | 117b | 5.1b | 128 | 4 | 128k |

| gpt-oss-20b | 24 | 21b | 3.6b | 32 | 4 | 128k |

Em termos de desempenho.OpenAI Os dados de benchmarking publicados mostram gpt-oss O desempenho é extremamente competitivo.

Comparação de desempenho de modelos

| gpt-oss-120b | gpt-oss-20b | OpenAI o3 | OpenAI o4-mini | |

|---|---|---|---|---|

| Raciocínio e conhecimento | ||||

| MMLU | 90.0 | 85.3 | 93.4 | 93.0 |

| Diamante GPQA | 80.9 | 74.2 | 77.0 | 81.4 |

| O teste humano definitivo | 19.0 | 17.3 | 24.9 | 17.7 |

| matemática para competições | ||||

| AIME 2024 | 96.6 | 96.0 | 91.6 | 93.4 |

| AIME 2025 | 97.9 | 98.7 | 88.9 | 92.7 |

Os dados mostram que o carro-chefe gpt-oss-120b Em vários benchmarks de inferência de núcleo, o desempenho é comparável ao do OpenAI Modelo próprio de código fechado o4-mini Não fica para trás, e até mesmo é superado em áreas específicas, como matemática para competições. E o peso leve gpt-oss-20b Seu desempenho também é semelhante ao do o3-mini comparável ou superior. Esse desempenho o torna não apenas uma potência teórica, mas também tem o potencial de desafiar os principais modelos de código fechado em aplicações práticas.

Padrões de segurança e ecossistemas

Diante do risco de que os modelos de código aberto possam ser explorados para fins maliciosos, aOpenAI Foi enfatizado que a segurança havia sido colocada no centro.

OpenAI Adotou sua Estrutura de Preparação interna para o ajuste fino do adversário gpt-oss-120b A versão foi rigorosamente testada e concluiu-se que o modelo não atendia ao nível de risco de "alta capacidade". Além disso.OpenAI Um Red Team Testing Challenge com um prêmio de US$ 500.000 também foi lançado para incentivar a comunidade a se unir para investigar possíveis problemas de segurança.

Em termos de usabilidade.OpenAI colaboração com Hugging Face、Azure、AWS e outras plataformas de implantação, bem como NVIDIA、AMD e outros fornecedores de hardware para garantir que o modelo possa ser usado de forma ampla e eficiente.gpt-oss-120b foi quantificado para ser executado em uma única GPU com 80 GB de RAM, e o gpt-oss-20b Ele também requer apenas 16 GB de RAM, o que reduz drasticamente as barreiras para os desenvolvedores implantarem e experimentarem localmente em hardware de nível de consumidor.

Importância estratégica: a abertura é o novo fosso?

OpenAI Essa adoção de alto nível do código aberto é, sem dúvida, uma visão profunda do padrão atual de IA e do ajuste estratégico. No passado, aOpenAI algo em que se confia GPT As vantagens de desempenho da série de modelos de código fechado levaram a um grande sucesso na comercialização. No entanto Meta 的 Llama A série prova que um modelo sólido de código aberto pode gerar um ecossistema de desenvolvedores grande e vibrante que, por si só, é um poderoso fosso.

Ao publicar um gpt-oss Modelos.OpenAI Isso não apenas diminui o fluxo de desenvolvedores para os ecossistemas de código aberto dos concorrentes, mas também coloca suas próprias pilhas de tecnologia (como o Harmony formato de prompt) promovido como o padrão do setor. É uma defesa e uma ofensa. Ele permite OpenAI ser capaz de lutar nos campos de batalha de código fechado e de código aberto ao mesmo tempo, tanto por meio do API Fornecer modelos de código fechado de primeira linha para obter receita, mas ser capaz de criar comunidades, atrair talentos e explorar novas possibilidades de negócios por meio de modelos de código aberto.

Para o setor como um todo.OpenAI A entrada do Google Inc. acenderá completamente a batalha no espaço dos grandes modelos de código aberto. Os desenvolvedores terão mais opções personalizáveis e de alta qualidade, e os padrões de desempenho e segurança dos modelos serão levados a novos patamares. O que exatamente é isso OpenAI O fato de ser uma defesa tática pontual ou uma mudança fundamental em sua estratégia de longo prazo dependerá do investimento subsequente e do feedback da comunidade. De qualquer forma, a era da abertura em IA realmente chegou.