Agentes de 12 fatores 5. Harmonização do status de implementação com o status operacional

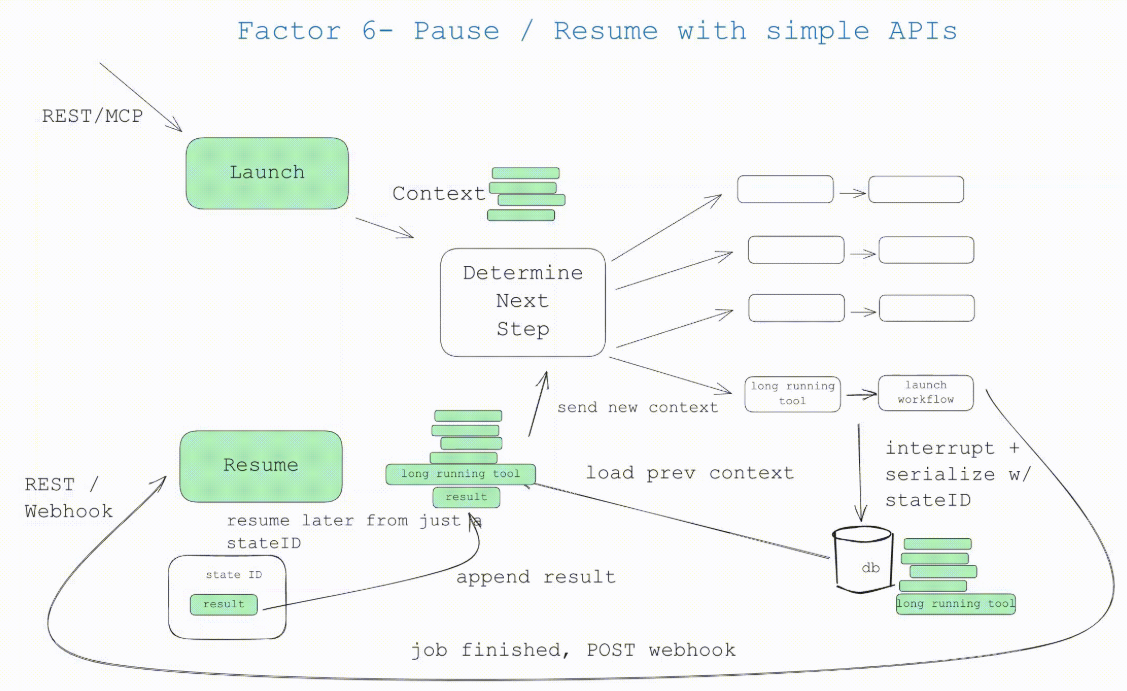

Mesmo fora do espaço de IA, muitos sistemas de infraestrutura tentam separar o “estado da execução” do “estado do negócio”. Para aplicativos de IA, isso pode envolver abstrações complexas para acompanhar informações como etapa atual, próxima etapa, status de espera, novas tentativas etc. Essa separação introduz complexidade e, embora possa valer a pena, pode ser difícil para o seu caso de uso. Essa separação introduz complexidade e, embora possa valer a pena, pode ser trivial para seu caso de uso...