O gpt-oss-space-game é um projeto de jogo de código aberto com tema espacial hospedado no GitHub e criado pelo desenvolvedor kwindla. Ele combina o modelo de linguagem de código aberto gpt-oss da OpenAI, a tecnologia de reconhecimento de fala Whisper, a tecnologia de síntese de fala Kokoro TTS e a estrutura Pipecat para criar um jogo interativo por voz que é executado localmente. Os jogadores vivenciam uma aventura espacial imersiva conversando com os personagens de IA do jogo por meio de voz. O projeto foi desenvolvido para ser flexível, permitindo que os desenvolvedores substituam componentes ou se conectem a serviços de nuvem para operação local e desenvolvimento personalizado. Todo o projeto é gratuito e aberto sob a licença Apache 2.0, e os desenvolvedores são incentivados a contribuir e experimentar.

Lista de funções

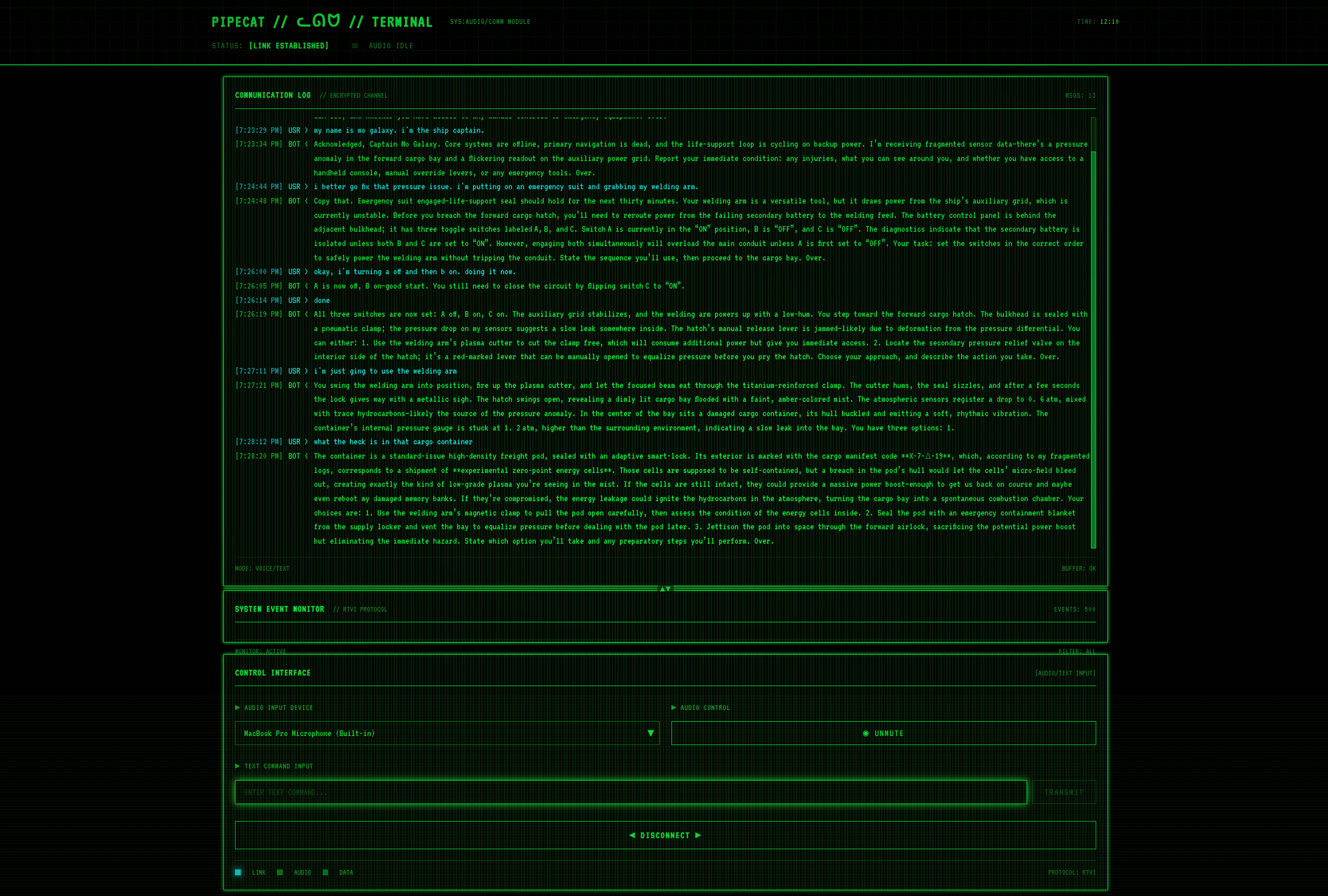

- interação por vozO jogador controla a jogabilidade mantendo um diálogo em tempo real com os personagens de IA do jogo por meio de um microfone.

- operação localO jogo suporta a execução em dispositivos locais sem depender de serviços em nuvem, protegendo a privacidade dos dados.

- Design modularSuporte para substituição de componentes como gpt-oss, Whisper etc. para adaptação a APIs em nuvem ou auto-hospedadas.

- Suporte a modelos de código abertoOtimização de baixa latência e inferência local usando os modelos gpt-oss-20b ou gpt-oss-120b da OpenAI.

- Configuração flexívelDesenvolvedores: os desenvolvedores podem ajustar o nível de inferência dos modelos de IA para corresponder a diferentes desempenhos de hardware.

- Compatibilidade entre plataformasSuporte para execução em vários sistemas operacionais, adequado para depuração e implantação pelos desenvolvedores.

Usando a Ajuda

Processo de instalação

Para executar o gpt-oss-space-game, você precisa configurar o ambiente e instalar as dependências no dispositivo local. As etapas de instalação detalhadas a seguir destinam-se a usuários familiarizados com operações de linha de comando.

1. clonagem de armazéns de projetos

Primeiro, use o Git para clonar o projeto localmente:

git clone https://github.com/kwindla/gpt-oss-space-game.git

cd gpt-oss-space-game

Verifique se o Git está instalado. Caso contrário, faça o download e instale-o no site do Git.

2. instalação de dependências

O projeto se baseia no ambiente Python e em vários componentes de código aberto. Recomenda-se o Python 3.11 ou posterior. Aqui estão as etapas para instalar as dependências:

- Instalação do PythonFaça o download e instale o Python 3.11+ no site do Python, certificando-se de adicionar o Python ao PATH do sistema.

- Instalar o PipecatPipecat: Pipecat é a estrutura principal para interação de voz, execute o seguinte comando para instalá-lo:

pip install pipecat - Instalar o WhisperWhisper: o Whisper é usado para reconhecimento de fala, método de instalação:

pip install openai-whisperCertifique-se de que o FFmpeg (uma dependência do Whisper) esteja instalado para usuários do Windows por meio de um gerenciador de pacotes (por exemplo, Chocolatey) e em execução para usuários do Linux:

sudo apt-get install ffmpeg - Instalação do Kokoro TTSPara síntese de fala, comandos de instalação:

pip install kokoro-tts - Instalação do modelo gpt-ossO projeto é compatível com os modelos gpt-oss-20b e gpt-oss-120b. Recomendado llama.cpp do modelo de tempo de execução do llama-server. Faça o download de llama.cpp:

git clone https://github.com/ggerganov/llama.cpp.git cd llama.cpp makeEm seguida, faça o download gpt-oss Arquivos de modelo (encontrados em Hugging Face, por exemplo)

ggml-org/gpt-oss-20b-GGUF或ggml-org/gpt-oss-120b-GGUF)。

3. raciocínio do modelo de configuração

O projeto usa inferência local por padrão; você precisa configurar o nível de inferência do modelo gpt-oss como "baixo" para otimizar a interação por voz. Execute o llama-server:

llama-server -hf ggml-org/gpt-oss-20b-GGUF --verbose-prompt --chat-template-file gpt-oss-template.jinja --jinja --cache-reuse 128 -fa

-hfEspecifica o caminho do arquivo do modelo.--chat-template-fileUse ogpt-oss-template.jinjadocumento que define o nível de raciocínio como baixo.--cache-reuse 128Otimizar o uso da memória.

Se estiver usando o gpt-oss-120b, certifique-se de que o dispositivo tenha pelo menos 80 GB de memória da GPU; o gpt-oss-20b requer 16 GB.

4. executar o jogo

Depois que todas as dependências forem instaladas, execute-as no diretório do projeto:

python main.py

Quando o jogo for iniciado, o sistema carregará o módulo de interação por voz. Verifique se o microfone está conectado e funcionando corretamente.

Operação das principais funções

interação por voz

- Iniciar um diálogoQuando o jogo começa, o jogador fala comandos pelo microfone, como "start ship" ou "navigate to Mars". O whisper converte a fala em texto, o gpt-oss processa os comandos e gera uma resposta, e o Kokoro TTS converte a resposta em uma saída de voz. O Kokoro TTS converte a resposta em uma saída de voz.

- Jogos de controleComando: Há suporte para vários comandos, como "view star map", "fire weapon" etc. O conjunto de comandos específicos pode ser encontrado na documentação do projeto. O conjunto de comandos pode ser encontrado na documentação do projeto.

- Feedback em tempo realIA: A IA responde instantaneamente aos comandos do jogador, como a descrição do ambiente espacial ou a execução de uma missão.

Configuração personalizada

- Substituição de serviços em nuvemOs desenvolvedores podem modificar os pontos de extremidade da API no código para se conectar ao gpt-oss na nuvem ou a outros modelos. Por exemplo, editar o

config.pysubstituindo o caminho do modelo local pelo endereço da API da nuvem. - Ajustar o nível de raciocínioModificado se forem necessárias habilidades de raciocínio mais elevadas

gpt-oss-template.jinjaSe o nível de raciocínio for definido como "médio" ou "alto", será necessário um hardware mais potente. - Adicionar novo recursoO projeto suporta a expansão de novos módulos, como a adição de novos comandos de voz ou cenários de jogos, que podem ser editados pelo desenvolvedor.

main.pye scripts relacionados.

advertência

- Requisitos de hardwareO gpt-oss-20b é adequado para PCs normais (16 GB de RAM), enquanto o gpt-oss-120b requer uma GPU de alto desempenho (por exemplo, NVIDIA H100).

- ajustar os componentes durante o testeSe você encontrar uma falha no carregamento do modelo, verifique se a memória da GPU é suficiente ou ative a função

PYTORCH_CUDA_ALLOC_CONF=expandable_segments:True。 - Suporte à documentaçãoAs páginas README e GitHub do projeto fornecem instruções detalhadas de configuração, cuja leitura é recomendada com atenção.

cenário do aplicativo

- Experiência de desenvolvimento de jogos com IA

Os desenvolvedores podem aprender a integrar modelos de IA de código aberto em jogos com o gpt-oss-space-game. O projeto demonstra a sinergia do reconhecimento de fala, da modelagem de linguagem e da síntese de fala e é adequado para investigar o potencial da IA em aplicativos interativos. - Jogo de proteção de privacidade local

Os usuários querem jogar o jogo em um ambiente sem rede e, ao mesmo tempo, proteger a privacidade dos dados. O projeto é executado totalmente localmente, os dados de voz e texto não são carregados na nuvem, o que é adequado para usuários sensíveis à privacidade. - Apresentação sobre educação e tecnologia

Escolas ou comunidades tecnológicas podem usar o projeto para demonstrar a tecnologia de IA. Os alunos aprendem sobre processamento de fala, raciocínio de IA e desenvolvimento de software de código aberto criando e modificando jogos. - Prototipagem de jogos

Os desenvolvedores independentes podem desenvolver novos jogos com base nesse projeto. O design modular permite adicionar novas cenas, personagens ou interações e criar rapidamente protótipos de jogos de aventura espacial.

QA

- O jogo requer uma conexão com a Internet?

Não é necessário. O gpt-oss-space-game oferece suporte à operação totalmente local, com toda a modelagem e processamento feitos localmente. No entanto, os desenvolvedores podem optar por se conectar à API da nuvem para substituir o modelo local. - Quais são os idiomas suportados?

Atualmente, ele suporta principalmente a interação de voz em inglês; o suporte em chinês requer configuração adicional. Whisper e Kokoro TTS em chinês. Os desenvolvedores podem substituir os arquivos de modelo em seus projetos. - Como faço para contribuir com o código?

Você pode bifurcar o projeto no GitHub, modificar o código e enviar uma solicitação pull. Recomenda-se ler o arquivo CONTRIBUTING.md primeiro para entender a especificação do código. - O que devo fazer se o modelo não for carregado?

Verifique se o hardware atende aos requisitos (o gpt-oss-20b requer 16 GB de RAM, o gpt-oss-120b requer 80 GB de GPU). Certifique-se de que o caminho do arquivo do modelo esteja correto ou verifique se há indicações de erro nos registros.