大语言模型(LLM)技术日新月异,开源社区也随之涌现出大量宝贵的学习资源。对于希望系统掌握 LLM 的开发者来说,这些项目是不可多得的实践宝库。本文将深入介绍九个在 GitHub 上广受好评的顶级开源项目,它们不仅覆盖了从理论到实践的全过程,更提供了具体的代码实现和工程指导,足以成为你学习路上的坚实阶梯。

Datawhale 系列:专为中文开发者打造的系统性教程

国内的 Datawhale 开源组织在 AI 知识普及领域扮演了重要角色。他们推出的一系列 LLM 教程,因其体系化的内容、对中文环境的友好支持以及清晰的学习路径,受到了国内开发者的广泛欢迎。

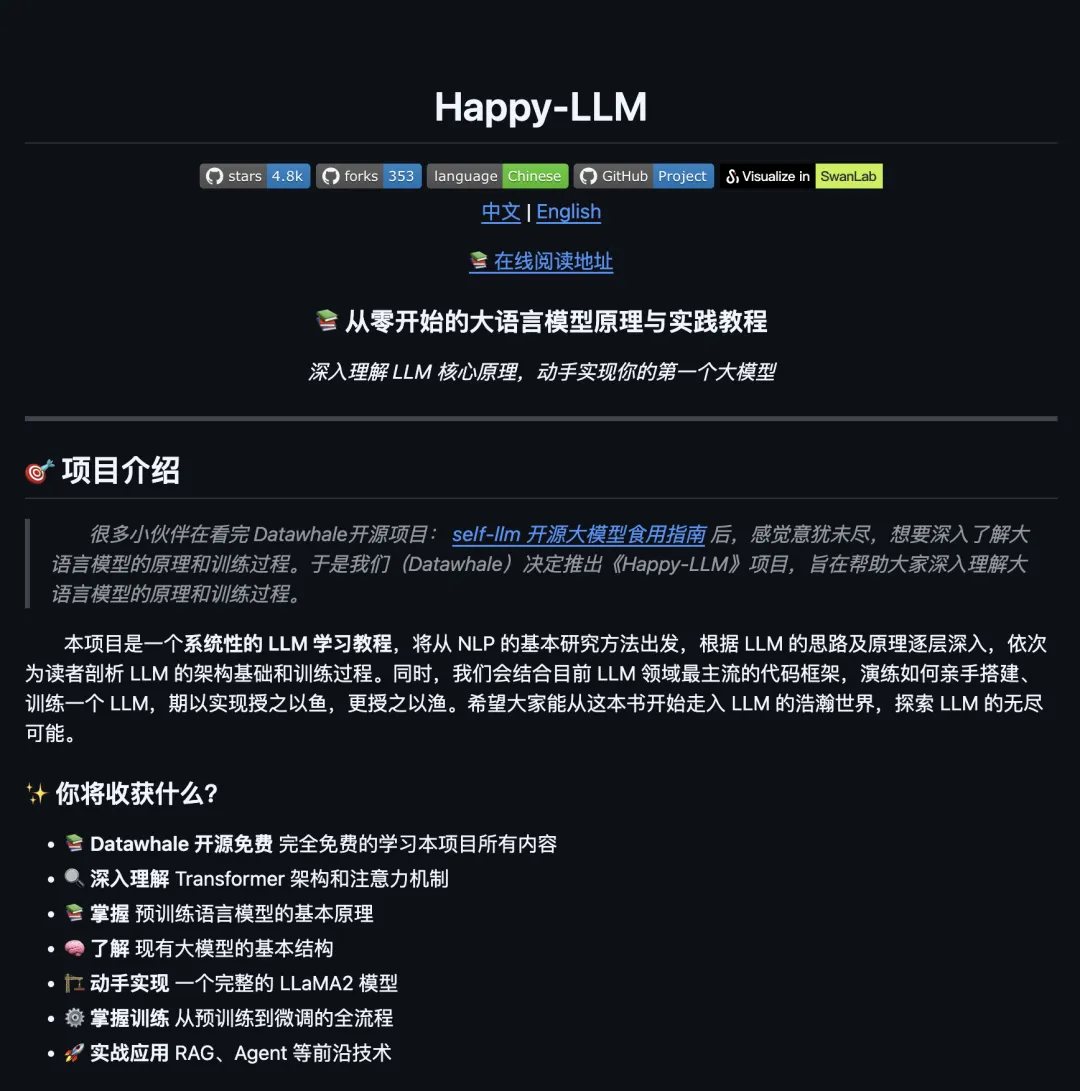

1. Happy-LLM:从零到一的原理与实践

Happy-LLM (5k Stars) 是一门完全免费的系统性大模型原理与实践教程,旨在帮助开发者深入理解 LLM 的核心。课程从 NLP 基础概念入手,详细剖析了 Transformer 架构和注意力机制,并对预训练模型的原理进行了清晰梳理。

该项目的核心亮点在于“动手实践”。它不仅会带领你用 PyTorch 从零开始实现一个完整的 LLaMA2 模型,还覆盖了训练 Tokenizer、模型预训练、监督微调的全流程。同时,课程也包含了对 RAG(检索增强生成)和 Agent 等前沿技术的实战讲解。

- 开源地址:

https://github.com/datawhalechina/happy-llm

2. LLM-Universe:面向初学者的大模型应用开发

LLM-Universe (8.8k Stars) 将目光投向了大模型的应用落地,是专为编程小白设计的入门课程。整个教程以一个极具代表性的项目——“基于个人知识库的智能问答助手”为主线,并在阿里云服务器上进行实践。

课程内容非常务实,涵盖了调用国内外主流大模型 API(如 GPT、文心一言、智谱 GLM)的方法、Prompt 工程技巧、使用 LangChain 框架、向量数据库的搭建,以及最后如何用 Streamlit 将应用打包成一个可交互的前端界面。

- 开源地址:

https://github.com/datawhalechina/llm-universe

3. Self-LLM:开源大模型本地化食用指南

Self-LLM (20k Stars) 被誉为“为中国宝宝量身打造的开源大模型食用指南”,其核心目标是解决开源模型在国内环境下的私有化部署和微调问题。对于关心数据隐私和模型定制化的开发者来说,这个项目极具价值。

它提供了在 Linux 环境下对 LLaMA、ChatGLM、Qwen(通义千问)、InternLM(书生·浦语)等数十种国内外主流模型进行本地部署、全参数微调和 LoRA 高效微调的详尽步骤。此外,教程还扩展到了多模态大模型的部署。

- 开源地址:

https://github.com/datawhalechina/self-llm

4. LLM Cookbook:吴恩达课程的中文实践版

LLM Cookbook (20.2k Stars) 是一个基于吴恩达教授一系列大模型课程的中文实践版本。它将原版课程的核心思想提炼并本地化,覆盖了 Prompt 工程、RAG 开发、模型微调等关键环节。

此项目的一大特色是提供了与原课程配套的中英双语 Jupyter Notebook 代码,并针对国内开发者的需求,特别优化了中文 Prompt 的设计和 API 调用方法。课程被分为“必修”和“选修”两部分,方便学习者根据自身情况循序渐进。

- 开源地址:

https://github.com/datawhalechina/llm-cookbook

工程化与深度实践

掌握理论后,将模型投入实际生产是必经之路。以下项目聚焦于大模型生命周期中的关键工程挑战。

5. LLM-Action:大模型工程化与落地实战

LLM-Action (19k Stars) 是一个专注于大模型工程化与应用落地的技术分享项目。它不像入门教程那样面面俱到,而是深入到模型训练、推理、压缩和安全等具体的技术细节中。

其内容可以被视为一个庞大的技术知识库,涵盖:

- 训练:

LoRA、QLoRA、P-Tuning等参数高效微调技术和分布式训练。 - 推理优化:深入讲解

TensorRT-LLM、vLLM等业界主流推理框架。 - 模型压缩:系统介绍模型量化、剪枝和知识蒸馏等技术。

- 国产化适配:包含华为昇腾等国产硬件平台的适配经验。

- 开源地址:

https://github.com/liguodongiot/llm-action

6. AI Engineering Hub:真实世界 AI 应用案例库

AI Engineering Hub (13.2k Stars) 是一个内容丰富的深度教程与实践案例集合,其核心理念是“面向真实世界的 AI 应用”。这个项目不谈空泛的理论,而是提供了大量可以直接上手修改和运行的代码示例。

它围绕 DeepSeek、Llama、Gemma 等流行的开源模型,提供了包括 RAG、多 Agent 协作、多模态应用在内的多种解决方案。该项目将核心教程整理成了一本超过500页的 PDF 文档,宛如一本详尽的“操作手册”,极具收藏价值。

- 开源地址:

https://github.com/patchy631/ai-engineering-hub

从零重构:深入理解模型底层

要真正洞悉 LLM 的工作原理,没有什么比从零开始实现一个模型更有效了。

7. 复现小 GPT (MiniMind):两小时训练专属微型 GPT

MiniMind (22.6k Stars) 是一个现象级的开源项目,它向我们证明了普通开发者也能从零开始训练自己的 GPT。借助该项目,仅需一块 NVIDIA 3090 显卡,花费大约 2 小时,就能训练出一个仅 26MB 大小的超轻量级 GPT 模型。

这个项目的宝贵之处在于,它使用原生的 PyTorch 重构了 Transformer 解码器、旋转位置编码 (RoPE)、SwiGLU 激活函数等所有核心算法,几乎不依赖任何第三方库的高度封装接口。它完整复现了从预训练、监督微调 (SFT)、LoRA 适配,到 DPO(直接偏好优化)对齐的工业化流程,是深入理解 LLM 底层细节的绝佳教材。

- 开源地址:

https://github.com/jingyaogong/minimind

国际视野:顶级机构与专家的权威课程

最后,来自国际顶级研究者和科技巨头的开源课程,为 LLM 学习提供了权威且前沿的视角。

8. LLM Course:通往 LLM 科学家的进阶之路

由 Maxime Labonne 创建的 LLM Course (56.5k Stars) 是一门为进阶学习者设计的综合性课程。它将学习路径清晰地划分为 LLM 基础、LLM 科学家和 LLM 工程师三大部分。

该课程提供了大量可直接在 Google Colab 中运行的 Notebook,内容涵盖使用 QLoRA / DPO 进行模型微调、GGUF / GPTQ 量化、以及使用 mergekit 合并模型等高级主题。同时,它还提供了如 AutoQuant、LazyMergekit 等自动化工具,帮助开发者高效地完成模型优化工作。

- 开源地址:

https://github.com/mlabonne/llm-course

9. Generative AI for Beginners:微软出品的权威入门教程

Generative AI for Beginners (87.5k Stars) 是由 Microsoft 官方推出的生成式 AI 入门课程,品质极高,非常适合零基础的开发者。这门课程包含 21 节精心设计的课程,覆盖了从 Prompt 工程基础、构建文生图应用、集成 RAG 与 Agent 等核心知识点。

课程提供了 Python 和 TypeScript 的代码示例,并且特别强调了“负责任的 AI” (Responsible AI) 这一重要议题。同时,它还介绍了如何使用 Gradio 等低代码工具快速搭建应用原型,极大地降低了学习门槛。

- 开源地址:

https://github.com/microsoft/generative-ai-for-beginners