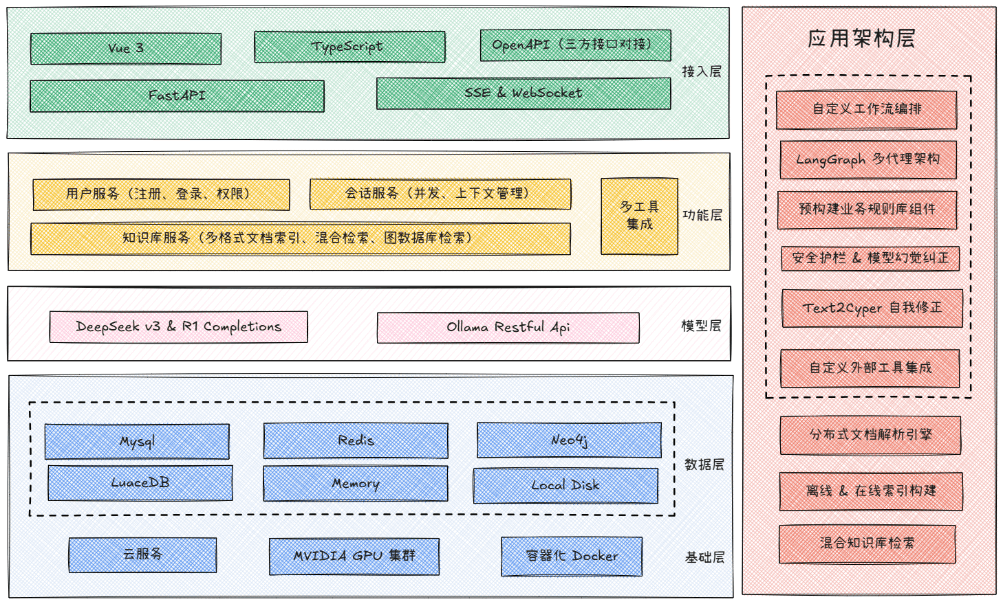

GBC MedAIはオープンソースのインテリジェント医療アシスタントシステムです。バックエンドフレームワークとしてFastAPIを使用し、フロントエンドの技術スタックとしてVue 3を使用しています。このシステムの核となる能力は、DeepSeekのような複数のAIビッグ言語モデルを同時に統合する能力にあります。 Ollama など、OpenAIのインターフェイスに対応したモデルもある。また、様々な検索エンジンサービスを統合し、リアルタイム情報を取り入れたインテリジェントな対話と検索機能をユーザーに提供します。モジュラーアーキテクチャと高度で完全な技術スタックにより、このプロジェクトは、医療分野やその他の専門的なシナリオのために迅速に展開し、二次開発できるAIアシスタントソリューションを提供することを目指しています。

機能一覧

- AI能力DeepSeek、Ollamaローカルモデル、OpenAIと互換性のある様々なAIモデルへのアクセスをサポート。複雑な推論タスクや視覚理解に対応し、アップロードされた画像の解析も可能。

- インテリジェント・サーチBoca AI、Baidu AI Search、SerpAPIを統合することで、質問に応じた最適な検索エンジンを自動的に選択し、最新の医療情報や研究の進歩にアクセスすることができます。

- 対話システム:スムーズなストリーミングレスポンスとコンテクストメモリー機能を提供。完全なユーザー認証とマルチセッションVセッション管理機構を内蔵し、履歴を保存します。

- モダンなフロントエンドVue 3とTypeScriptで構築されており、レスポンシブレイアウトでデスクトップとモバイルの両方に対応しています。インターフェイスは美しい二次アニメスタイルでデザインされ、豊富なインタラクティブアニメーションを搭載しています。

- 高性能バックエンドFastAPI非同期フレームワークをベースに開発されており、効率的なリクエスト処理機能を備えています。

- データとキャッシュセマンティック・キャッシュとしてRedisを使用することで、繰り返されるクエリの応答性能を効果的に向上させ、AIモデルの呼び出しコストを削減することができます。

- 高度なAIフレームワーク:: 応用 LangGraph のような技術や、より複雑なAIプロセスやナレッジグラフ・アプリケーションを構築するためのGraphRagのような技術がある。

ヘルプの使用

本セクションでは、GBC MedAI システムをインストール、設定し、正常に稼動させる方法について詳 しく説明します。以下の手順に従って、導入を完了してください。

環境要件

作業を始める前に、システム環境が以下の条件を満たしていることを確認してください:

- Python3.8以上

- Node.js16 以上(フロントエンド開発が必要な場合のみ必要)

- 総合データベースMySQL 8.0以上、Redis 6.0以上

- ナレッジグラフ(オプション)Neo4j 4.0以上

プリファイルダウンロード

プロジェクトの実行には、いくつかのビルド済みファイルに依存しています。まず、以下のアドレスからファイルをダウンロードし、指定のディレクトリに解凍してください:

- フロントエンド・ドキュメントBaidu.comからのリンク

https://pan.baidu.com/s/1KTROmn78XhhcuYBOfk0iUQ?pwd=wi8k(解凍コード: wi8k) フロントエンドのパッケージファイルをダウンロードし、それをllm_backend/static/カタログ - GraphRag ファイルBaidu.comからのリンク

https://pan.baidu.com/s/1dg6YxN_a4wZCXrmHBPGj_Q?pwd=hppu(解凍コード: hppu) GraphRag関連のファイルをダウンロードし、プロジェクトのルートディレクトリに配置する。

インストールと設定の手順

1.プロジェクトコードのクローニング

まず git コマンドを使って、プロジェクトのコードをGitHubからローカル・コンピューターにクローンする。

git clone https://github.com/zhanlangerba/gbc-madai.git

cd gbc-madai

2.バックエンド・サービスのセットアップ

バックエンドのコード・ディレクトリに移動して pip Pythonの依存関係をすべてインストールする。

cd llm_backend

pip install -r requirements.txt

3.環境変数の設定

コンフィギュレーション・ファイルはシステム運用の鍵となります。テンプレートファイルをコピーし、個人的な設定情報を記入する必要があります。

# 复制环境变量模板文件

cp .env.example .env

# 使用文本编辑器(如 nano 或 vim)打开并编辑 .env 文件

nano .env

在 .env 書類を作成する際には、以下の情報を記入する必要があります:

DEEPSEEK_API_KEY:あなたの DeepSeek APIキーBOCHA_AI_API_KEY/BAIDU_AI_SEARCH_API_KEY/SERPAPI_KEY選択した検索エンジンに対応するAPIキーを入力してください。DB_HOST,DB_USER,DB_PASSWORD,DB_NAMEMySQLデータベース接続情報。REDIS_HOST,REDIS_PORTRedisサービスの接続情報です。NEO4J_URL,NEO4J_USERNAME,NEO4J_PASSWORDNeo4jデータベース接続情報(使用されている場合)。

4.データベースの初期化

サービスを開始する前に、プロジェクトに必要なデータベースをMySQLに作成する必要があります。

# 使用您的 MySQL root 用户登录并执行以下命令

mysql -u root -p -e "CREATE DATABASE assist_gen CHARACTER SET utf8mb4 COLLATE utf8mb4_unicode_ci;"

5.システムサービスの開始

上記のステップをすべて完了したら run.py スクリプトでシステム全体を起動する。

# 启动后端服务

python run.py

サービスが正常に開始されると、ブラウザから以下のアドレスにアクセスできるようになります:

- フロントエンドアクセスアドレス:

http://localhost:8000/ - APIドキュメント(Swagger UI):

http://localhost:8000/docs

展開方法

ソースコードを直接実行するだけでなく、プロジェクトはより安定した便利なDockerデプロイ方法をサポートしている。

Dockerを使ったデプロイ(推奨)

Dockerがインストールされていることを確認し、プロジェクトのルート・ディレクトリで以下のコマンドを実行する:

# 1. 构建 Docker 镜像,将其命名为 gbc-madai

docker build -t gbc-madai .

# 2. 以后台模式运行容器,并将本地的 .env 文件作为环境变量传入

docker run -d -p 8000:8000 --env-file .env gbc-madai

フロントエンド単独開発

フロントエンドのインターフェイスを変更したり開発したりする必要がある場合は gbc_madai_web ディレクトリでフロントエンド開発サービスを単独で実行する。"`shell

フロントエンドのコード・ディレクトリに移動する

cd ../gbc_madai_web

フロントエンドの依存関係をインストールする

npm install

フロントエンド開発サーバーを起動する

npm run dev

フロントエンド開発サービスは http://localhost:3000 へのAPIリクエストを自動的にプロキシする。 http://localhost:8000。

アプリケーションシナリオ

- インテリジェント・ヘルスケア・コンサルティング

バーチャル・ドクター・アシスタントとして、24時間365日オンラインで利用でき、一般的な病気、投薬アドバイス、健康的な生活に関する患者の質問に答え、初期医療指導を行うことができる。 - 臨床判断サポート

医師が最新の医学文献、臨床試験報告書、治療ガイドラインを素早く検索・分析し、より正確な診断と治療計画を立てるための情報サポートを提供。 - 医療情報検索プラットフォーム

病院や研究組織内のインテリジェントな知識ベースとして使用でき、スタッフが内部規則、業務手順、症例ファイル、研究資料を素早く見つけるのに役立つ。 - その他の専門分野

システムのモジュール設計により、電子商取引、金融、法律などの他の専門分野にも簡単に拡張でき、インテリジェントな顧客サービスや専門家アシスタントとして使用できる。

QA

- このプロジェクトはフリーでオープンソースですか?

はい、このプロジェクトはMITライセンスに基づく完全なオープンソースであり、個人または商用プロジェクトで自由に使用、変更、配布することができます。 - このシステムを導入するには、どのような技術的背景が必要ですか?

Python言語とFastAPIフレームワークの基本的な理解、MySQLとRedisデータベースのインストールと基本操作の知識が必要です。Dockerでのデプロイを選択した場合は、一般的なDockerコマンドにも精通している必要があります。 - 自分のAIモデルにアクセスできますか?

できる。システム・アーキテクチャはOpenAI API標準と互換性のあるあらゆるモデルへのアクセスをサポートしています。必要なのは.env設定ファイルのモデルのAPIアドレスを変更する(OLLAMA_BASE_URL(または同様の変数)とキーがあれば十分である。システム自体はDeepSeekとOllamaをネイティブサポートしている。 - フロントエンドのインターフェイスは交換可能か?

システムバックエンドはREST API一式を提供する。システムバックエンドは、REST API一式を提供する。プロジェクト独自のフロントエンドを完全にスキップして、APIドキュメント(http://localhost:8000/docs) デスクトップアプリケーション、モバイルアプリケーション、アプレットなど、独自のクライアントアプリケーションを開発する。