自 Peter Steinberger 开发的 OpenClaw(社区昵称“AI 小龙虾”)横空出世以来,AI 领域正在经历从“聊天机器人 (Chatbot)”向“智能体 (AI Agent)”的范式转移。与仅能生成文本的 ChatGPT 不同,OpenClaw 这类 Agent 具备了“执行力”——它们能像人类一样操作电脑、编写代码并与各类软件交互。

然而,早期 OpenClaw 的部署往往依赖于复杂的命令行界面 (CLI),那些黑底绿字的终端窗口劝退了不少试图尝鲜的普通用户。好消息是,随着 Cherry Studio v1.7.17 版本的发布,这一门槛被彻底打破。这款集成了 AI 编程、多模型对话与知识库管理的开源平台,现在允许用户通过图形化界面一键安装并运行 OpenClaw。

在 Peter Steinberger 宣布加入 OpenAI 并推动下一代 Agent 开发的背景下,现在正是体验这一未来技术的最佳时机。本文将以 Windows 系统为例,详细拆解如何在 Cherry Studio 中部署你的第一只“AI 小龙虾”,并配置免费的高性能模型使其运转。

核心工具准备:Cherry Studio

Cherry Studio 本质上是一个强大的 AI 开发与对话容器。对于资深玩家,它是一个聚合了各类 LLM API 的控制台;对于新手,它则是通往本地 AI Agent 的捷径。

要运行 OpenClaw,首先确保你的 Cherry Studio 版本在 v1.7.17 及以上。

- 下载地址: Cherry Studio 官网

安全提示:OpenClaw 是一款在本地运行且具有系统操作权限的 Agent。虽然 Cherry Studio 提供了封装,但出于数据安全考虑,建议在非核心生产环境的电脑、虚拟机 (VM) 或沙盒环境中运行此类具有“执行能力”的 AI 程序。

第一阶段:一键安装 OpenClaw 环境

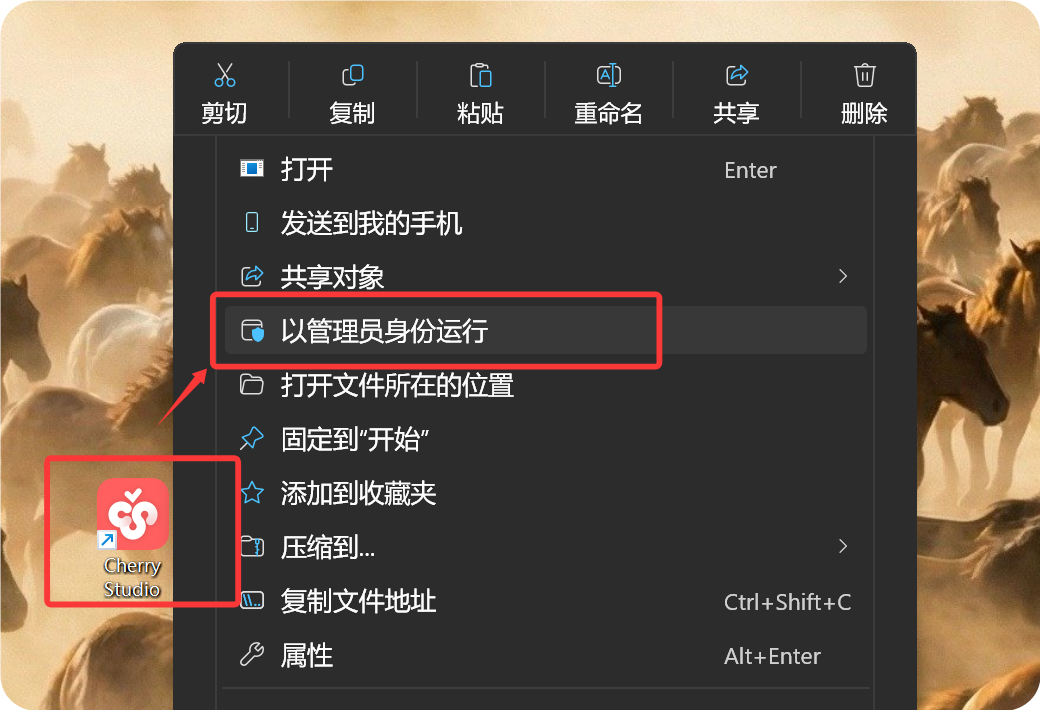

Cherry Studio 的优势在于其“开箱即用”的体验。安装并以管理员身份运行软件后,我们无需手动配置复杂的 Python 环境或 Docker 容器。

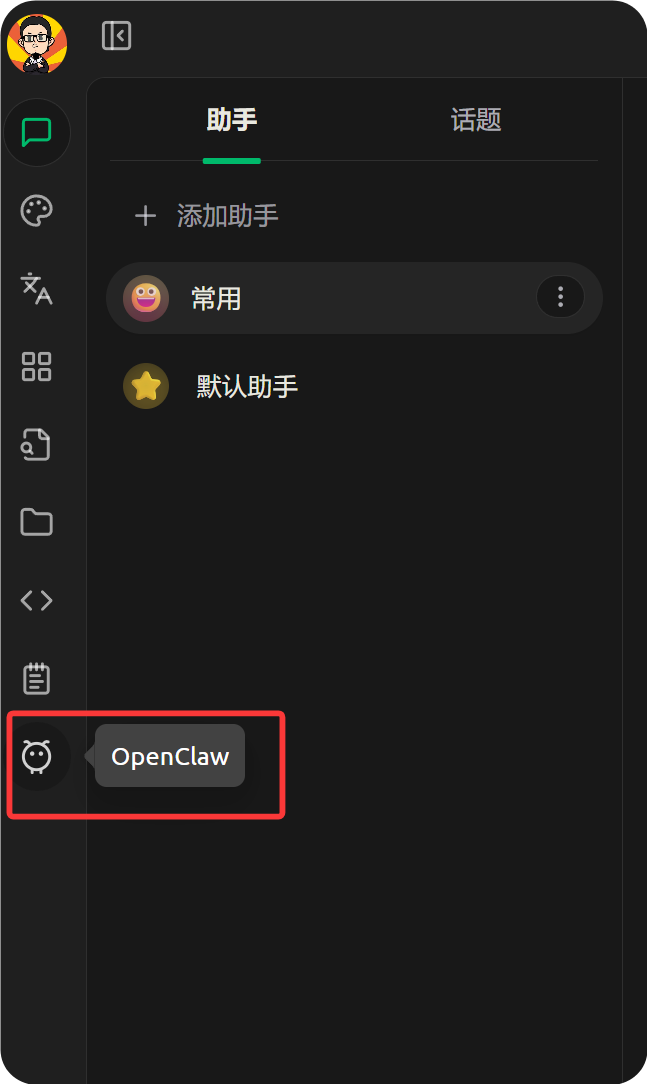

- 进入 Agent 中心:

打开软件左侧菜单底部的“小龙虾”图标(OpenClaw 入口)。

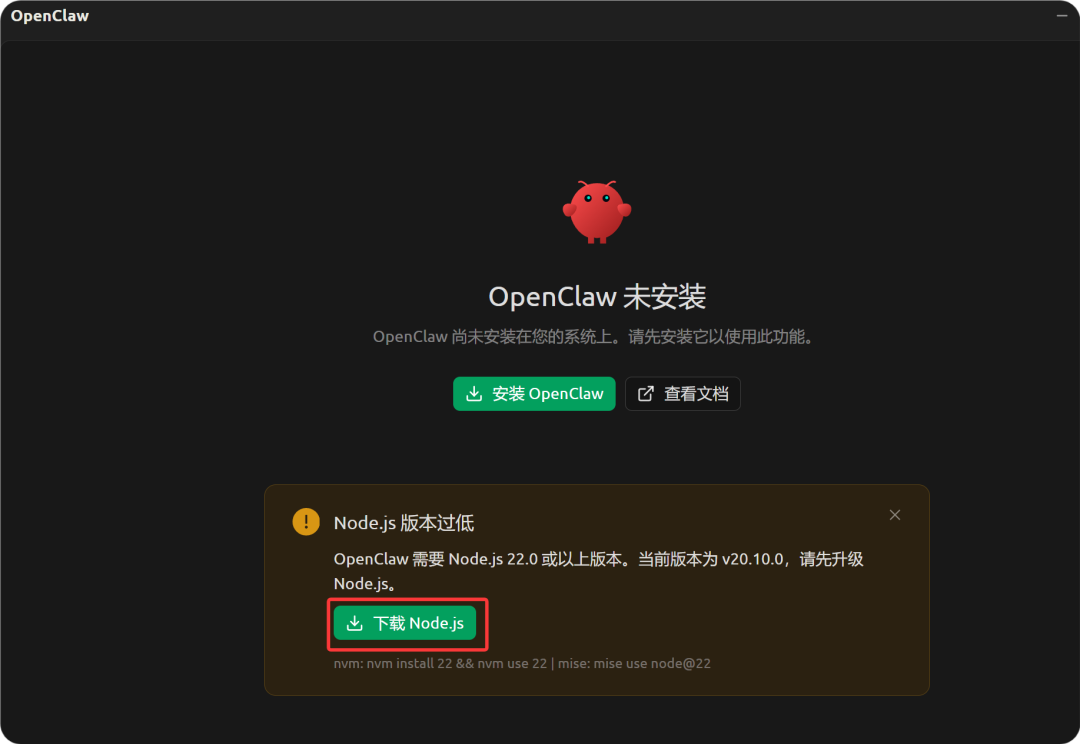

- 环境自检与依赖安装:

系统会自动检测本地环境。OpenClaw 的运行依赖于 Node.js (建议 v22.0+)。如果你的电脑尚未安装,Cherry Studio 会直接提供下载指引。

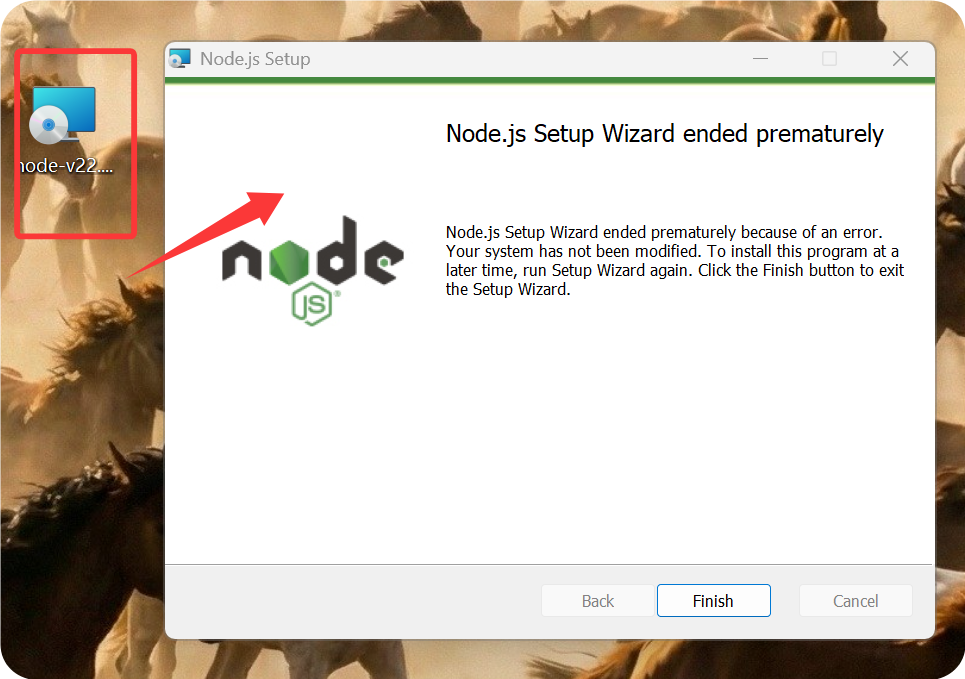

下载 Node.js 安装包后,保持默认选项完成安装即可。这是 OpenClaw 在后台运行逻辑判断与代码执行的基础引擎。

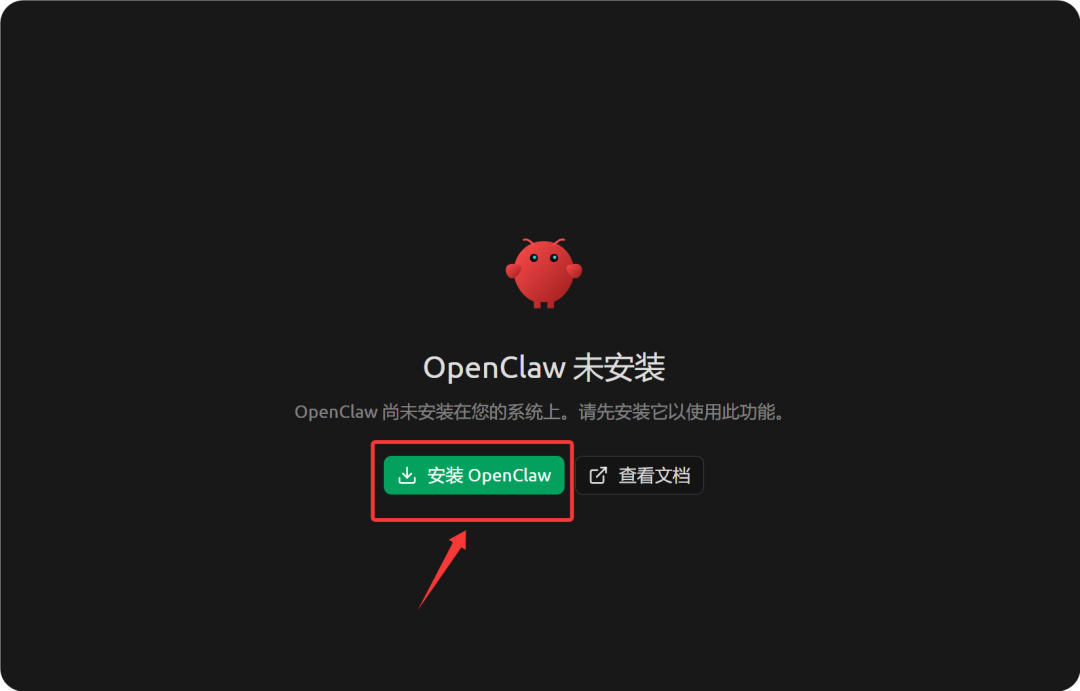

- 执行安装:

环境就绪后,回到 Cherry Studio 点击“安装”按钮。

安装小贴士:

- 如果你是首次在纯净系统上安装,过程通常会非常顺畅。

- 若系统中存在多个 Node.js 版本(例如开发者环境),可能会遇到版本冲突报错。此时建议使用

nvm(Node Version Manager) 切换版本,或直接在纯净的虚拟机中进行部署。

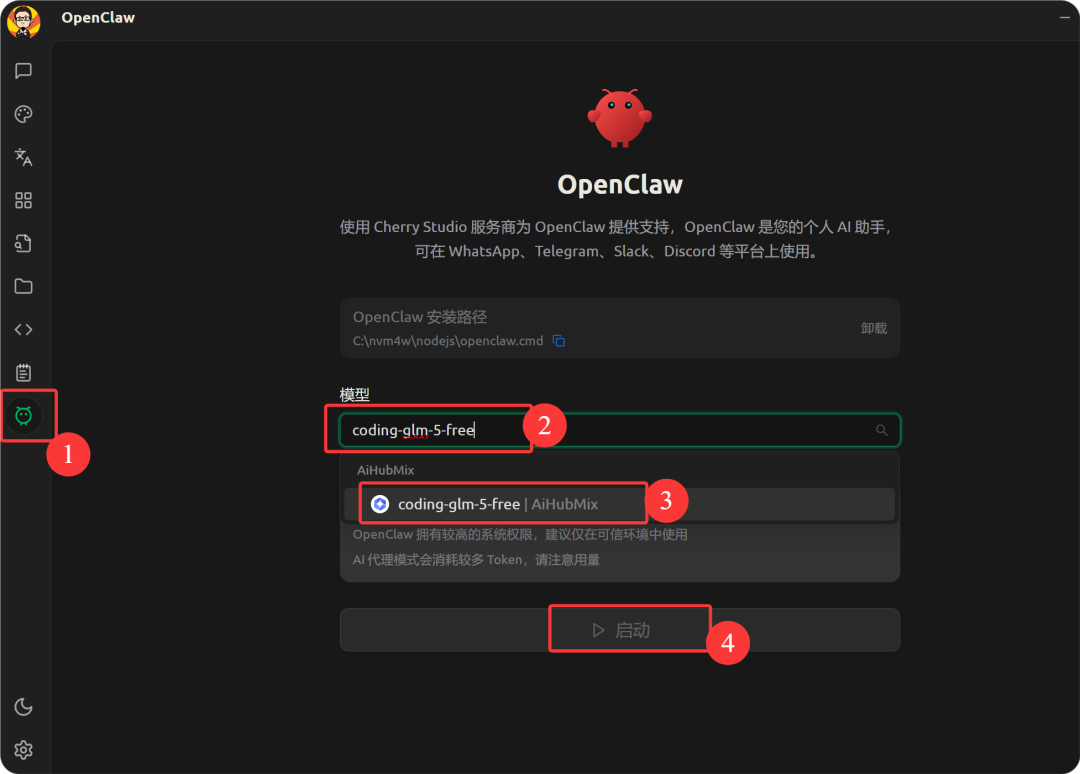

当看到如下界面时,说明 OpenClaw 已成功植入你的 Cherry Studio。

第二阶段:配置模型层(获取免费 API)

OpenClaw 只是“身体”,它需要接入大语言模型(LLM)作为“大脑”才能思考。我们可以使用本地模型(如 Ollama),但在性能受限的设备上,使用云端 API 是更优解。

这里推荐使用 推理时代 (AiHubMix) 提供的聚合 API 服务,它提供了包括 GPT-4、GLM-5 等主流模型的访问接口,且对开发者有一定的免费额度支持。

- 获取 API 密钥:

访问 推理时代官网 (aihubmix.com),注册账号后即可获得默认的 API 调用额度。- 免费策略:该平台提供的免费模型系列包含

coding-glm-5-free(适合代码编写)、Gemini 3 Flash等。 - 速率限制:国产系列模型通常限制为 5 RPM (每分钟 5 次请求) / 500 RPD (每天 500 次请求),足以满足个人测试与简单的 Agent 交互需求。

请在后台获取你的

sk-xxxxxxxx格式的 API 密钥 (API-Key)。 - 免费策略:该平台提供的免费模型系列包含

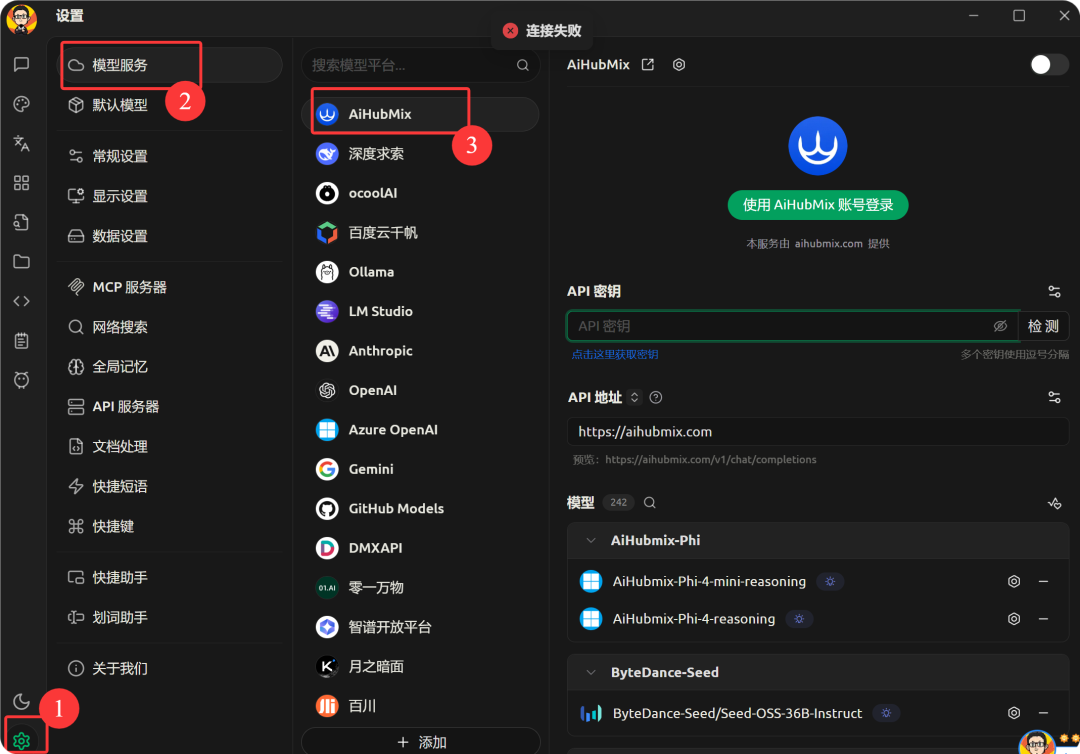

- 在 Cherry Studio 中对接服务:

点击软件左下角的齿轮图标进入设置,在“模型服务”列表中找到或搜索 AiHubMix。

- API 地址:系统通常会自动预填 (https://aihubmix.com)。

- API 密钥:粘贴刚才获取的 Key。

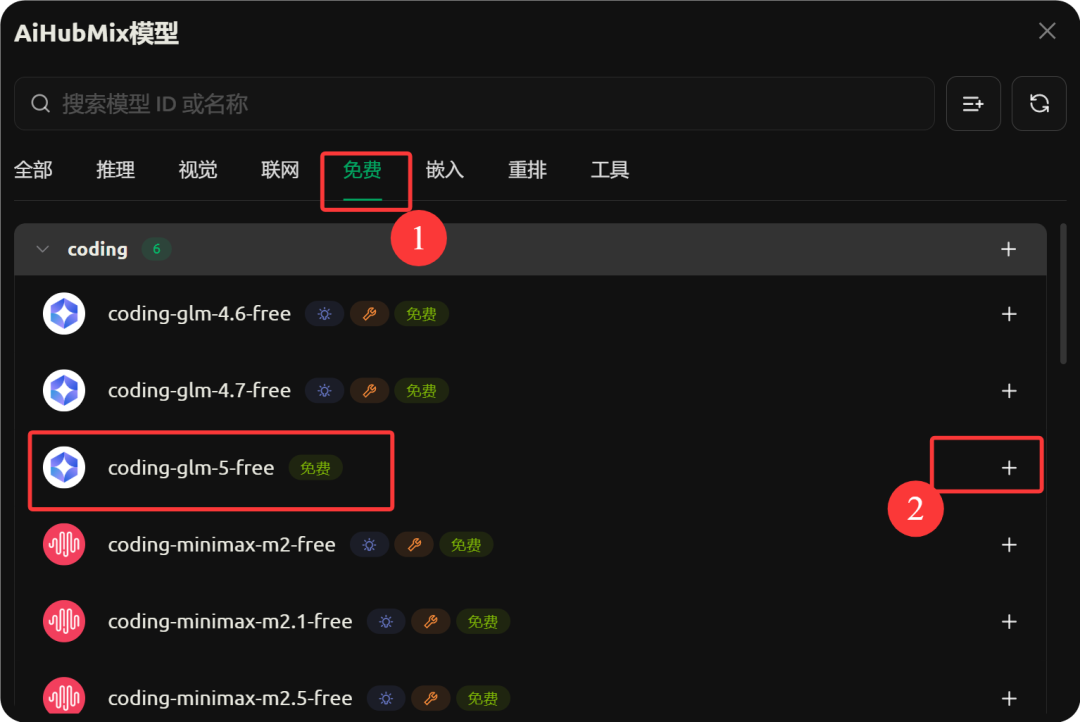

- 筛选与添加特定模型:

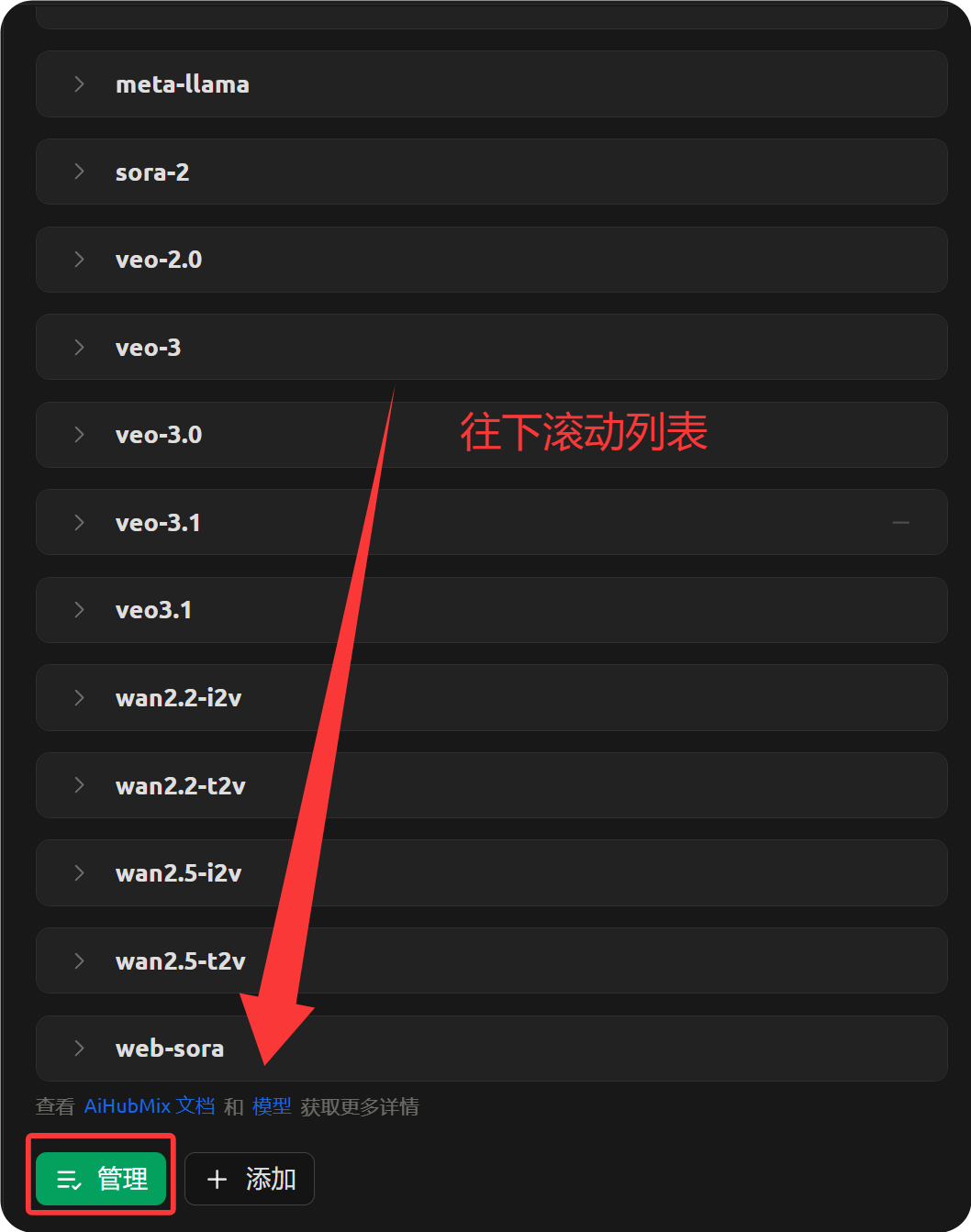

开启右上角的“服务商开关”(变绿),然后点击底部的“管理”按钮。

在模型管理界面,建议删除多余的收费模型以避免误操作。进入“免费”分类,添加

coding-glm-5-free。这点至关重要,因为 OpenClaw 在执行任务时会消耗大量 Token,使用针对代码优化的免费模型能显著降低试错成本。

- 连通性测试:

在 API 密钥右侧点击“检测”,输入coding-glm-5-free进行握手测试。提示“连接成功”即代表大脑与身体已建立神经连接。

第三阶段:启动与交互

回到 OpenClaw 界面,在模型选择栏中指定我们刚才配置的 coding-glm-5-free,点击启动。

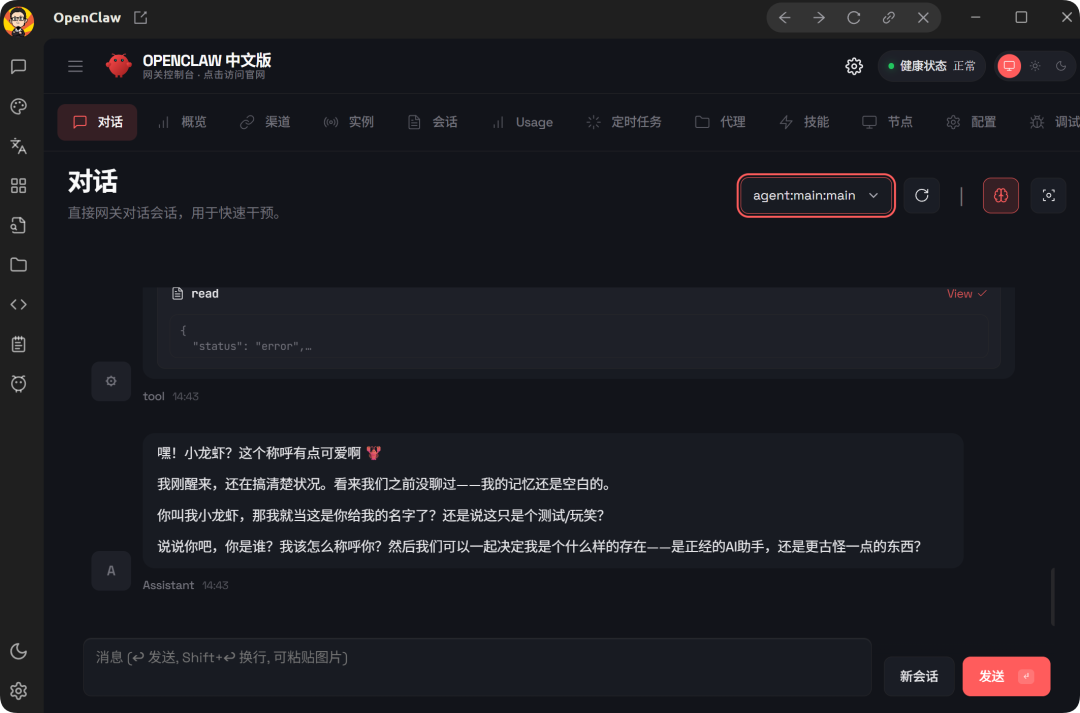

此时,你可以像从前与 Chatbot 聊天一样输入指令,但结果将大不相同。

试着输入:“你好啊,小龙虾。”

OpenClaw 不仅会回复文本,还可能在后台通过编写代码来解析你的意图。随着你进一步探索(例如要求它“帮我整理桌面文件”或“爬取某个网页的数据”),你会发现 Agent 的真正魅力——它不再只是说话,而是开始替你干活。

结语

通过 Cherry Studio,我们成功将复杂的 OpenClaw 部署流程压缩到了几次点击之中。这不仅是一个技术工具的安装过程,更是通过 AI 改变工作流的开始。无论是安装技能插件,还是利用更强大的模型(如 GPT-4)处理复杂任务,这个本地化的 Agent 平台都提供了无限的可能性。

如果在探索过程中遇到报错(例如 Python 环境依赖缺失或 API 额度耗尽),利用好手边的 AI 助手(如豆包、ChatGPT)上传错误截图进行诊断,是每一位 AI 开发者解决问题的高效路径。