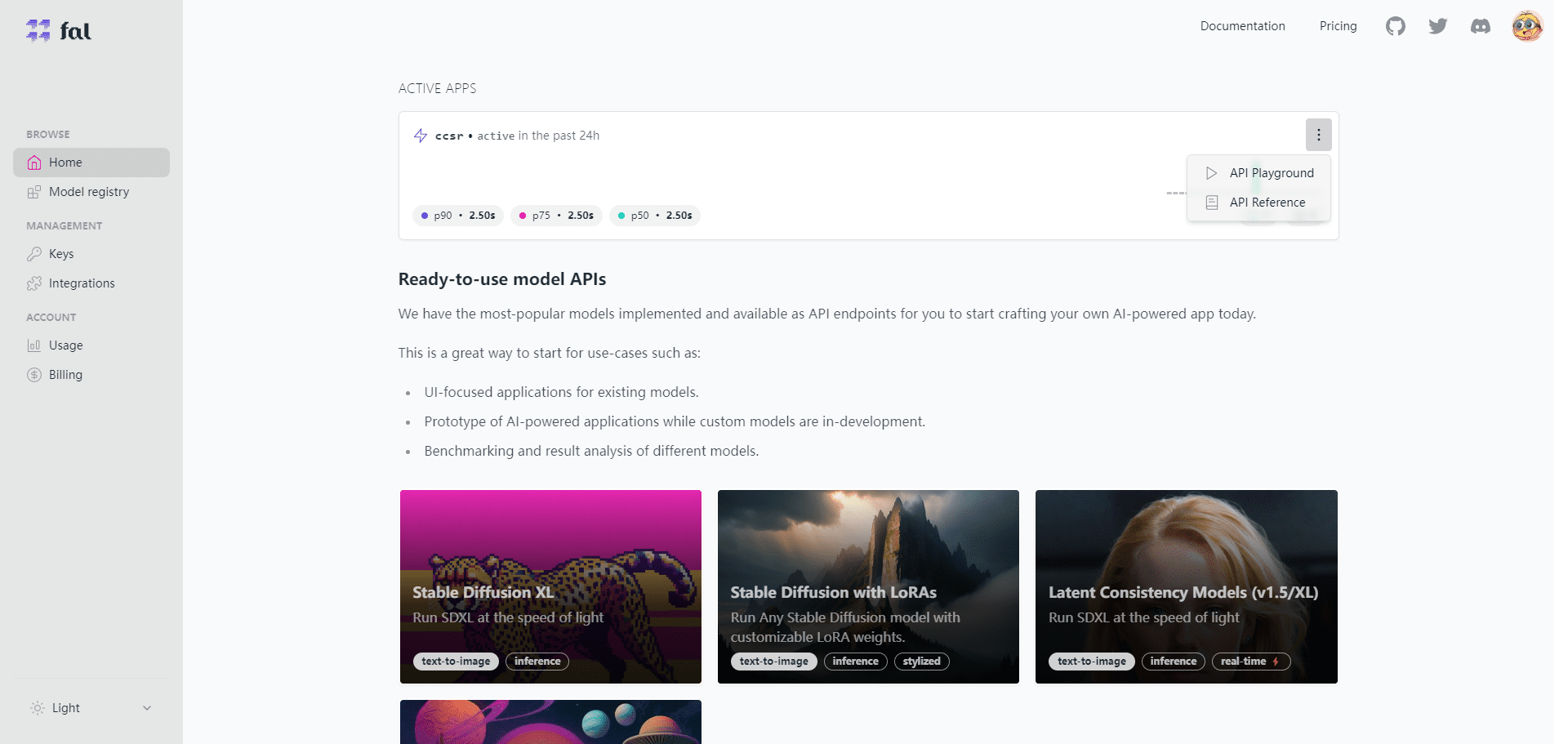

falはオンラインAI推論プラットフォームであり、画像、動画、音声を含む高品質な生成メディアモデルを用いてリアルタイムAIアプリケーションを構築することができます。falは、Stable Diffusion XL、Stable Diffusion with LoRAs、Optimised Latent Consistency (SDv1.5)など、様々な訓練済み生成モデルを提供しており、ユーザーは簡単なテキスト記述や落書きスケッチを使用して、素早く画像を生成することができます。画像を素早く生成することができます。

falは、GPU-A100、GPU-A10G、GPU-T4など、さまざまなマシンのタイプや仕様をサポートしており、さまざまなパフォーマンスやコスト要件を満たすことができます。falには詳細なドキュメントとサンプルが用意されており、ユーザーがすぐに使い始めることができます。

fal.aiは2021年に設立され、サンフランシスコに本社を置き、推論のスピードと効率を最適化することで、クリエイティブな表現の障壁を下げることに専念している。

機能一覧

- 効率的な推論エンジン最大400%の推論速度を持つ、世界最速の拡散モデル推論エンジンを提供します。

- 複数の世代モデルStable Diffusion 3.5やStable Diffusion 3.5など、事前にトレーニングされた様々な生成モデルをサポートしています。 FLUX.1。

- LoRAトレーニング: 業界最高のLoRAトレーニングツールを提供し、5分以内に新しいスタイルをパーソナライズまたはトレーニングできる。

- APIの統合JavaScript、Python、Swiftなど、さまざまなクライアント側ライブラリが用意されており、開発者が簡単に統合できる。

- オンライン推論リアルタイムのクリエイティブツールやカメラ入力のためのメディア推論のリアルタイム生成に対応。

- コスト最適化費用対効果の高い計算を保証するために、使用量に応じた支払い。

ヘルプの使用

インストールと統合

- アカウント登録fal.aiにアクセスし、デベロッパーアカウントにサインアップしてください。

- APIキーの取得ログイン後、"API Key "ページでAPIキーを生成・取得してください。

- クライアント・ライブラリのインストール:

- JavaScript:

import { fal } from "@fal-ai/client"; const result = await fal.subscribe("fal-ai/fast-sdxl", { input: { prompt: "photo of a cat wearing a kimono" }, logs: true, onQueueUpdate: (update) => { if (update.status === "IN_PROGRESS") { update.logs.map((log) => log.message).forEach(console.log); } }, }); - Python:

from fal import Client client = Client(api_key="YOUR_API_KEY") result = client.subscribe("fal-ai/fast-sdxl", input={"prompt": "photo of a cat wearing a kimono"}) print(result) - Swift:

import FalAI let client = FalClient(apiKey: "YOUR_API_KEY") client.subscribe(model: "fal-ai/fast-sdxl", input: ["prompt": "photo of a cat wearing a kimono"]) { result in print(result) }

- JavaScript:

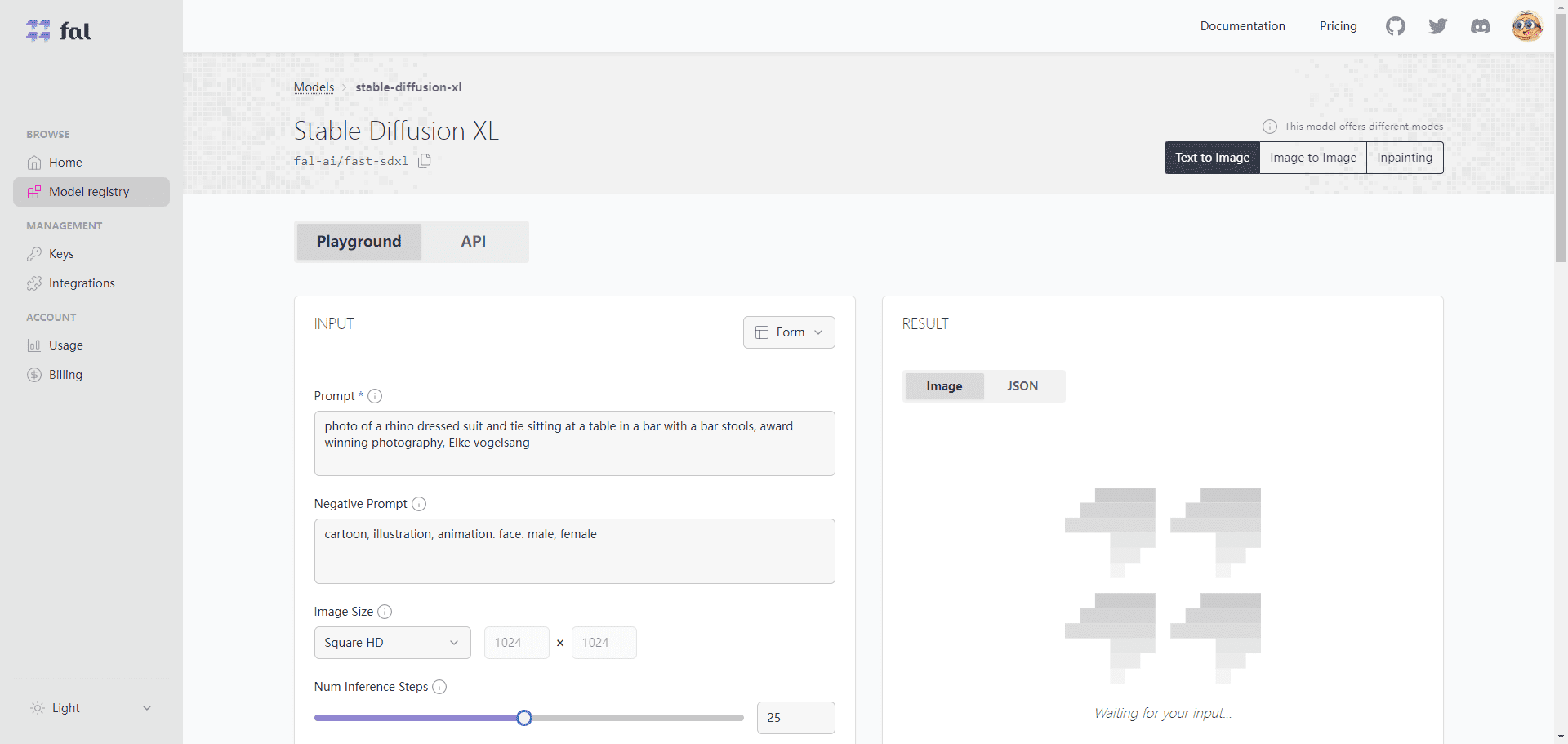

生成モデルの使用

- モデルを選択: fal.aiのモデルライブラリから、Stable Diffusion 3.5やFLUX.1など、プロジェクトに適したモデルを選択します。

- 設定パラメータ推論ステップ数、入力画像サイズなどのモデルパラメータを、プロジェクトの要件に応じて設定します。

- 走り推理APIコールを使用して推論を実行し、生成されたメディアコンテンツを取得します。

- 最適化と調整生成された結果に基づいて、パラメータを調整するか、最適化のために別のモデルを選択します。

LoRAトレーニング

- データのアップロードトレーニングデータを準備し、fal.aiプラットフォームにアップロードします。

- トレーニングモデルの選択FLUX.1のような適切なLoRAトレーニングモデルを選択する。

- トレーニングパラメータの設定学習率、学習ステップ数などの学習パラメータを設定します。

- トレーニング開始トレーニングプロセスを開始すると、プラットフォームはトレーニングを完了し、短時間で新しいスタイルモデルを生成します。

- 新モデルの適用パーソナライズされたメディアコンテンツを生成するために、新しく学習されたモデルを使用した推論。

すべてのモデルは、デバッグインターフェイスとAPIの2つの部分に分かれており、コールAPIで問題なくデバッグインターフェイスを使用することができます:

fal オプションモデル

| モデル名 | モデルの紹介 | モデルカテゴリー | 詳細説明 |

| Stable Diffusion with LoRAs | カスタムLoRA重みで安定拡散モデルを実行する | text-to-image | LoRAは、異なるウェイトを調整することで、得られる画像のスタイルとディテールをコントロールし、画像の品質と多様性を高めるために使用されるテクニックである。 |

| Stable Diffusion XL | 光の速さでSDXLを実行する | text-to-image | SDXLは拡散モデルに基づく画像生成手法であり、少ない推論ステップで高品質な画像を生成し、従来のGAN手法よりも高速で安定している |

| Stable Cascade | より小さく、より安価な潜在的スペースでのイメージ生成 | text-to-image | Stable Cascadeは、潜在空間の複数のレイヤーを利用して、低計算コストで高解像度の画像を生成する画像生成手法で、モバイル機器やエッジコンピューティングに適している |

| Creative Upscaler | クリエイティブな拡大画像の作成 | image-to-image | クリエイティブアップスケーラーとは、画像のシャープネスを維持したまま、テクスチャ、色、形などのクリエイティブな要素を追加するために、画像の拡大に使用される方法です。 |

| CCSR Upscaler | 最先端の画像アンプ | image-to-image | CCSR Upscalerはディープラーニングに基づく画像拡大手法で、ぼかしや歪みを発生させることなく、画像を元の解像度の4倍以上に拡大することができる |

| PhotoMaker | IDエンベッドを重ねてリアルなキャラクター写真をカスタマイズ | image-to-image | PhotoMakerは、さまざまなIDの埋め込みを調整することで、キャラクターの外見、表情、ポーズ、背景などをコントロールし、リアルなキャラクター写真を生成する手法です |

| Whisper | ウィスパーは音声書き起こし翻訳モデル | speech-to-text | WhisperはエンドツーエンドのTransformerベースの音声認識・翻訳モデルで、異なる言語の音声をワンステップでテキストに変換し、複数の言語や方言をサポートします。 |

| Latent Consistency (SDXL & SDv1.5) | 最小限の推論ステップで高品質の画像を生成 | text-to-image | 潜在的一貫性とは、潜在的な空間的一貫性と解釈可能性を維持しながら、より少ない推論ステップで高品質の画像を生成することにより、画像生成の効率と品質を向上させるために使用される技術である。 |

| Optimized Latent Consistency (SDv1.5) | 最小限の推論ステップで高品質の画像を生成。入力画像サイズ512×512に最適化 | image-to-image | Optimized Latent Consistencyは、潜在空間の一貫性と解釈可能性を維持しながら、より少ない推論ステップで高品質の画像を生成するために、特定の入力画像サイズに対して最適化された画像生成手法である。 |

| Fooocus | 自動最適化と品質向上のためのデフォルト・パラメーターの使用 | text-to-image | Fooocusは、ユーザーがパラメータを調整することなく高品質の画像を生成できる画像生成方法であり、自動最適化および品質向上技術を使用して生成された結果を向上させます。 |

| InstantID | ゼロサンプルによる同一性保持生成 | image-to-image | InstantIDは、アイデンティティを保持した画像を生成するための手法であり、ユーザーは学習データなしに、元の画像と同じアイデンティティを持つ画像を生成することができるが、髪型、服装、背景などの他の属性を変更することができる。 |

| AnimateDiff | AnimateDiffでアイデアをアニメーション化! | text-to-video | AnimateDiffは、ユーザーがテキスト説明を入力することで短いビデオクリップを生成できるアニメーション生成メソッドで、カートゥーン、リアル、抽象など様々なスタイルやテーマをサポートしています! |

| AnimateDiff Video to Video | AnimateDiffで動画にスタイルを加える | video-to-video | AnimateDiff Video to Videoは、ビデオスタイル変換のためのメソッドであり、ユーザーはビデオとスタイルの説明を入力することにより、新しいビデオを生成することができます! |

| MetaVoice | MetaVoice-1Bは、TTS(テキスト音声合成)用の12億パラメータのベースモデルで、10万時間の音声でトレーニングされています。 | text-to-speech | MetaVoiceは、ユーザーがテキストを入力することで、さまざまな言語や音声の音声を生成できる音声生成方法で、複数の言語や方言をサポートし、ピッチ、リズム、感情などのさまざまな発声特性もサポートしている。 |

| MusicGen | テキストの説明やメロディーを手がかりに、高品質の音楽を作成する | text-to-audio | MusicGenは、ユーザーがテキスト記述やメロディキューを入力することで、さまざまなスタイルやテーマの音楽を生成するためのメソッドで、さまざまな楽器や音色、ビート、コード、メロディなどのさまざまな音楽機能をサポートしています! |

| Illusion Diffusion | 映像からイリュージョンを作り出す | text-to-image | 錯視拡散は、画像と錯視の説明を入力することで、新たな画像を生成できる錯視生成手法で、視覚、聴覚、触覚など複数の種類の錯視に対応している! |

| Stable Diffusion XL Image to Image | SDXLを光速で画像間で実行 | image-to-image | Stable Diffusion XL Image to Imageは、入力画像から新しい画像を生成できる画像間変換手法で、スタイル変換、超解像、画像復元など、画像から画像への幅広いタスクをサポートします! |

| Comfy Workflow Executor | ファルでの快適なワークフローの実行 | json-to-image | Comfy Workflow Executorは、JSON形式のワークフローを入力して画像を生成するComfyワークフローの実行方法で、データ、モデル、操作、出力など様々なワークフローコンポーネントに対応しています! |

| Segment Anything Model | SAMモデル | image-to-image | Segment Anything Modelは、画像を入力することでセグメンテーションマップを生成できる画像セグメンテーション手法であり、セマンティックセグメンテーション、インスタンスセグメンテーション、フェイスセグメンテーションなど、さまざまな画像セグメンテーションタスクをサポートする。 |

| TinySAM | 蒸留セグメント何でもモデル TinySAM | image-to-image | TinySAMは、Segment Anything Modelを蒸留した画像セグメンテーションのための手法であり、より小さなモデルサイズとより速い推論速度で、元のモデルと同様のセグメンテーション結果を得ることができる。 |

| Midas Depth Estimation | Midasの深度推定を使った深度マップの作成 | image-to-image | ミダス深度推定は、入力画像から深度マップを生成するための手法で、グレースケール、カラー、疑似カラーなど、さまざまな深度マップ形式をサポートしています。 |

| Remove Background | 画像から背景を取り除く | image-to-image | Remove Backgroundは、画像の背景を除去する方法であり、ユーザが画像を入力することで背景を除去した画像を生成することができ、自然風景、屋内シーン、複雑なオブジェクトなど、さまざまな背景タイプをサポートする。 |

| Upscale Images | 画像を任意の倍率で拡大する | image-to-image | Upscale Imagesは、画像と拡大率を入力して新しい画像を生成できる画像拡大方法で、JPG、PNG、BMPなどさまざまな画像形式に対応しています。 |

| ControlNet SDXL | ControlNetを使用した画像生成 | image-to-image | ControlNet SDXLは、画像と制御ベクトルを入力することで新しい画像を生成できる画像生成方法で、スタイル、カラー、シェイプなど幅広い制御ベクトルタイプをサポートしています。 |

| Inpainting sdxl and sd | SDおよびSDXLによる画像の修復 | image-to-image | インペインティングsdxlおよびsdは、画像とマスクを入力することで復元画像を生成できる画像復元手法であり、透かしの除去、隙間の充填、ノイズの除去など、さまざまな画像復元作業をサポートする! |

| Animatediff LCM | 潜在的コヒーレンスモデルでテキストをアニメーション化する | text-to-image | Animatediff LCMは、SDXL、SDv1.5、SDv1.0など様々な潜在一貫性モデルをサポートし、テキストとフレームを入力することで短いビデオクリップを生成できるアニメーション生成手法です。 |

| Animatediff SparseCtrl LCM | 潜在的コヒーレンス・モデルでドローイングをアニメーション化する | text-to-video | Animatediff SparseCtrl LCMは、描画とフレーム数を入力することで短いビデオクリップを生成できるアニメーション生成手法で、SDXL、SDv1.5、SDv1.0など幅広い潜在一貫性モデルをサポートしています。 |

| Controlled Stable Video Diffusion | 画像から短いビデオクリップを生成 | image-to-image | Controlled Stable Video Diffusionは、画像と制御ベクトルを入力することで、短いビデオクリップを生成することができる動画生成手法であり、動き、角度、速度など複数の種類の制御ベクトルをサポートしている。 |

| Magic Animate | モーションシーケンスから短いビデオクリップを生成 | image-to-image | Magic Animateは、画像とモーションシーケンスを入力することで、短いビデオクリップを生成できるビデオ生成手法で、テキスト、アイコン、ジェスチャーなど、さまざまなモーションシーケンス形式をサポートしています! |

| Swap Face | 2つの画像の顔を入れ替える | image-to-image | スワップ・フェイスは、2つの画像を入力することで新しい画像を生成できる顔の入れ替え方法で、人物、動物、漫画など幅広い種類の画像をサポートしています。 |

| IP Adapter Face ID | 高品質ゼロサンプル名入れ | image-to-image | IPアダプター Face IDは、パーソナライズされた画像を生成する方法であり、ユーザーは画像とパーソナライズされた説明を入力することで新しい画像を生成することができる。 |