ピーター・スタインバーガー以来の開発 OpenClaw(チャットボットからAIエージェントへのパラダイムシフト。チャットボット」から「AIエージェント」へのパラダイムシフト。テキストのみと違い ChatGPT オープンクローとは異なり、オープンクローのようなエージェントは “実行力 ”を持っており、人間と同じようにコンピュータを操作し、コードを書き、あらゆる種類のソフトウェアと対話することができる。

しかし、OpenClawの初期のデプロイメントでは、複雑なコマンドラインインターフェイス(CLI)に依存することが多く、黒と緑のターミナルウィンドウは多くのカジュアルユーザーを遠ざけていた。良いニュースは Cherry Studio v1.7.17のリリースにより、この敷居は完全に取り払われた。AIプログラミング、マルチモデル対話、ナレッジベース管理を統合したこのオープンソースプラットフォームは、グラフィカルインターフェースを通じて、ワンクリックでOpenClawをインストールして実行できるようになった。

ピーター・スタインバーガー(Peter Steinberger)氏がOpenAIに参加し、次世代エージェントの開発を推進することを発表しました。この記事では、Windowsを例にして、OpenAIの使い方を説明します。 Cherry Studio 最初の「AIザリガニ」を配備し、それを機能させるために無料の高性能モデルを設定します。

コアツールの準備:チェリースタジオ

Cherry Studioは基本的にAI開発と対話のための強力なコンテナです。経験豊富なプレイヤーにとっては、あらゆる種類のLLM APIを集約したコンソールであり、初心者にとってはローカルAIエージェントへの近道となる。

OpenClawを実行するには、まずCherry Studioのバージョンが v1.7.17 以上

- ダウンロードアドレス: Cherry Studio 公式サイト

セキュリティのヒント: OpenClawはシステム権限でローカルに実行されるエージェントであり、Cherry Studioはラッパーを提供しますが、データセキュリティ上の理由から、このような「実行可能な」AIは、本番環境以外のコンピュータ、仮想マシン(VM)、またはサンドボックス環境で実行することを推奨します。プログラムで実行することを推奨します。

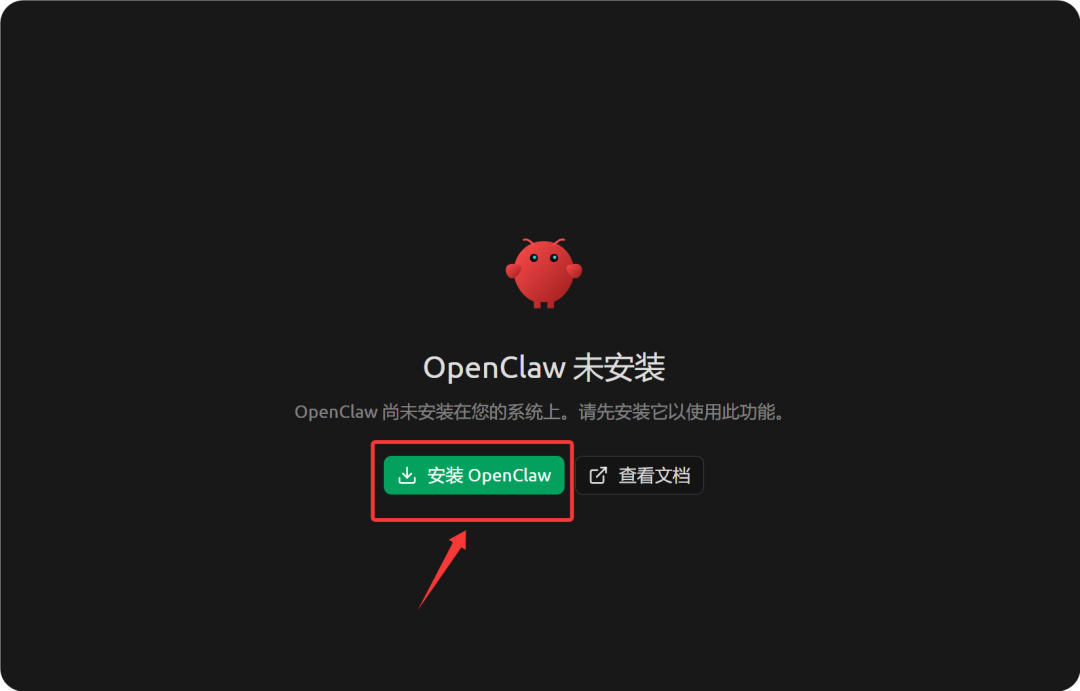

フェーズ1:OpenClaw環境のワンクリックインストール

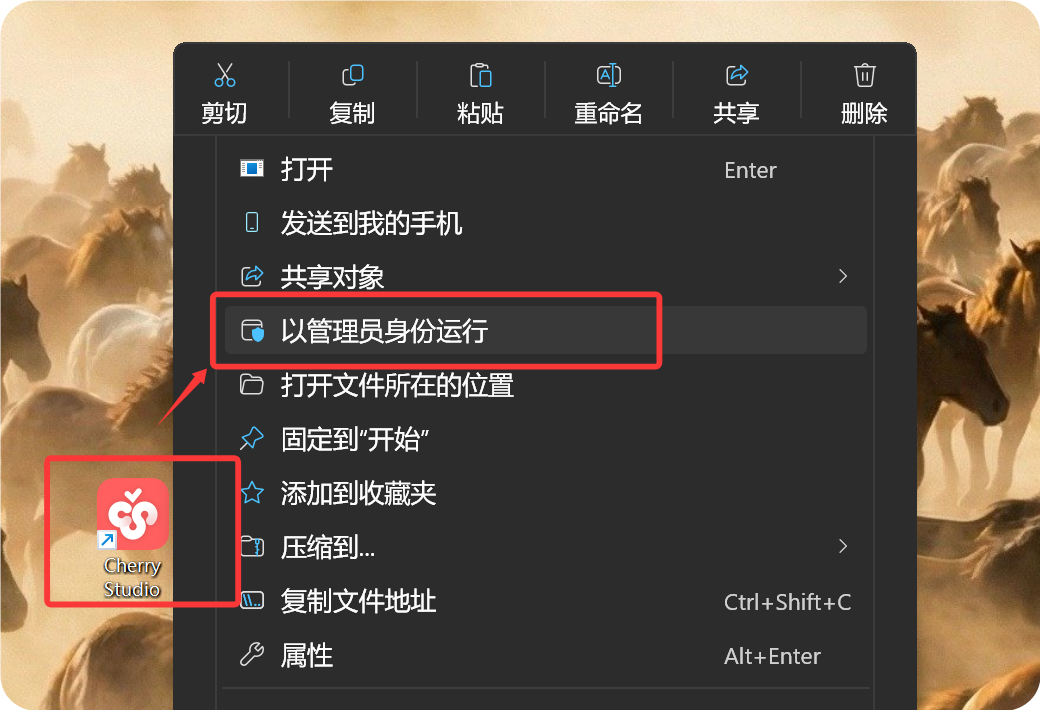

Cherry Studioの強みは「すぐに使える」ことです。一度インストールして管理者として実行すれば、複雑なPython環境やDockerコンテナを手動で設定する必要はありません。

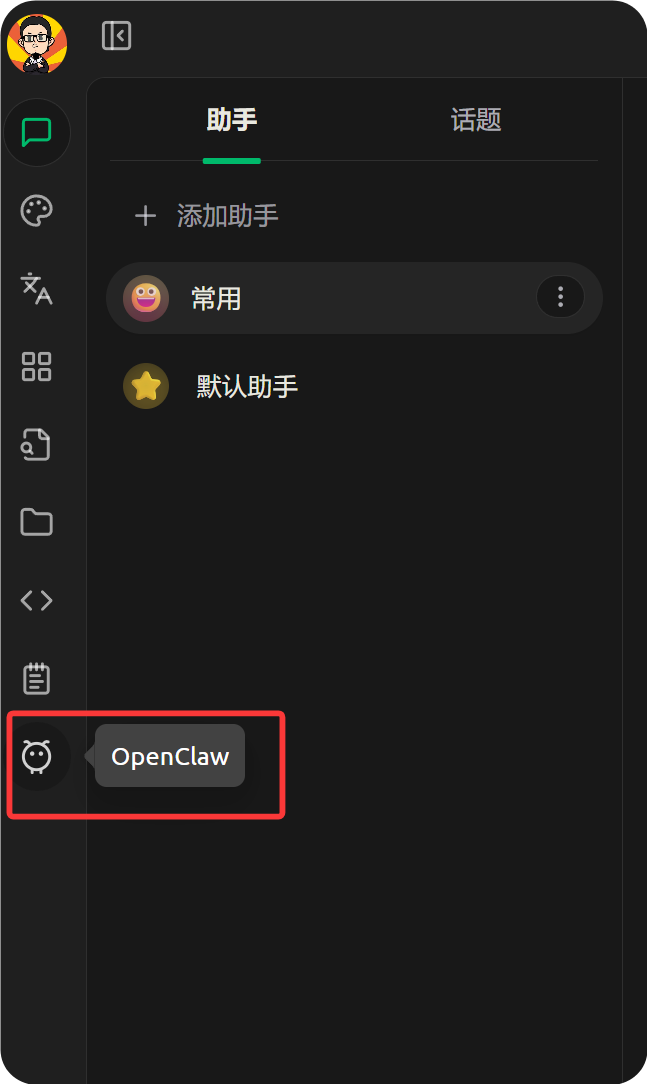

- エージェントセンターへのアクセス:

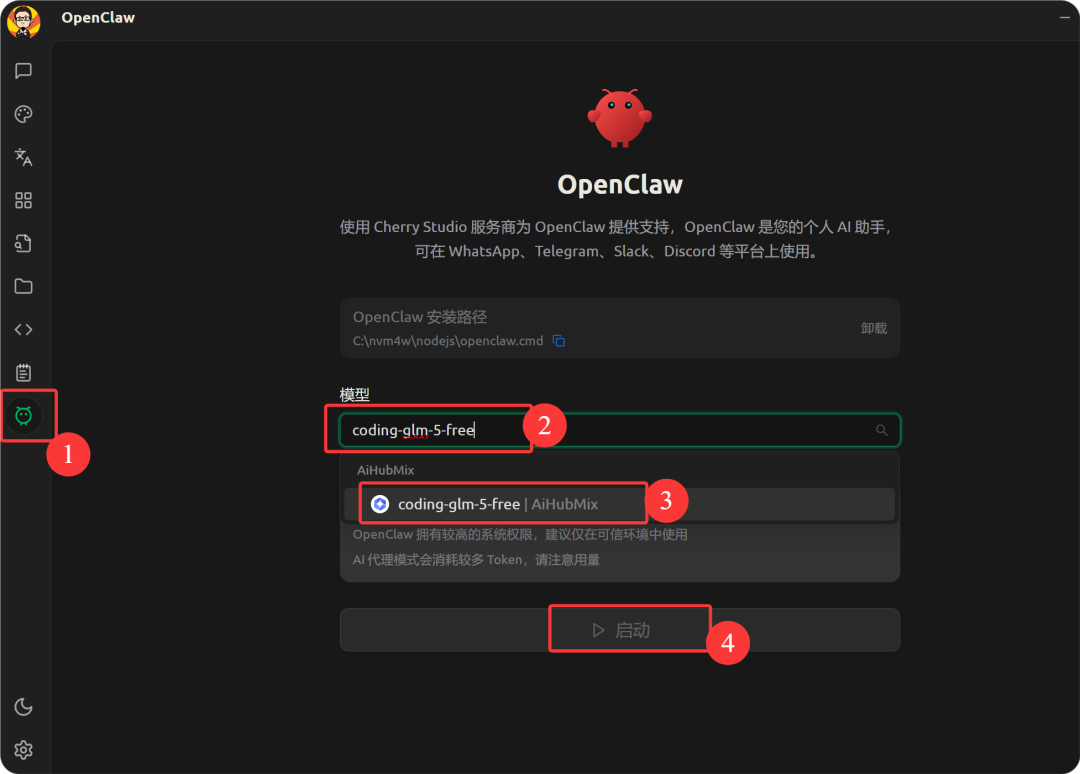

ソフトウェアの左側にあるメニューの一番下にある「ザリガニ」のアイコンを開きます(OpenClawの項目)。

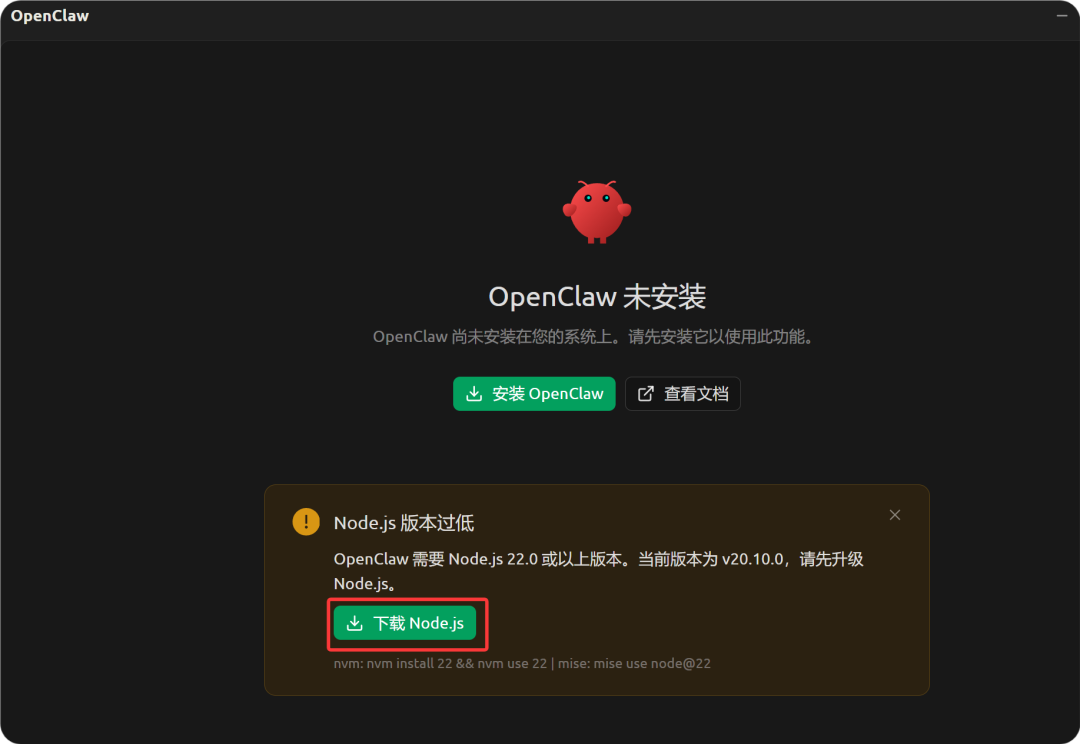

- 環境の自己テストと依存関係のインストール:

システムは自動的にローカル環境を検出する。 Node.js (v22.0+を推奨)。お使いのコンピュータにまだインストールされていない場合は、Cherry Studioがダウンロードのための直接ガイドを提供します。

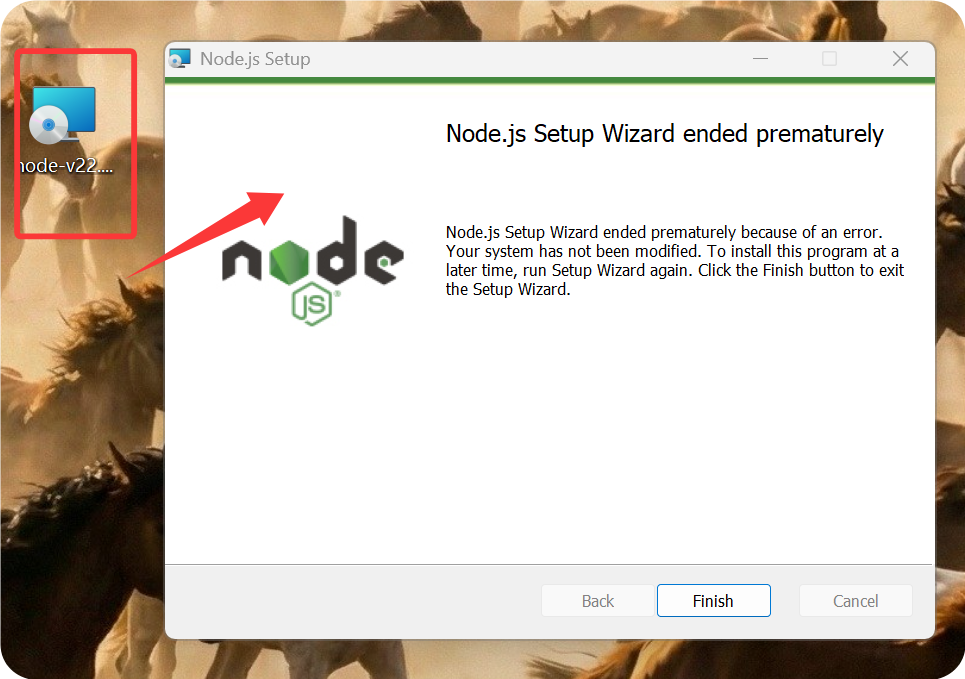

Node.jsのインストーラーをダウンロードしたら、デフォルトのオプションのままでインストールを完了します。これは、OpenClaw がバックグラウンドで論理的判断とコード実行を行うためのベースエンジンです。

- インストールの実行:

環境の準備ができたら、Cherry Studioに戻って「インストール」ボタンをクリックします。

インストールのヒント:

- 初めて手付かずのシステムにインストールする場合、通常、プロセスは非常にスムーズだ。

- システム上に複数のバージョンのNode.jsがある場合(開発者環境など)、バージョンの競合エラーが発生することがあります。この場合

nvm(ノード・バージョン・マネージャー)を使ってバージョンを切り替えるか、そのままの仮想マシンに直接デプロイする。

以下の画面が表示されたら、OpenClawのCherry Studioへの組み込みは完了です。

フェーズ2:モデルレイヤーを設定する(無料のAPIを入手する)

OpenClawは単なる “本体 ”であり、考えるための “頭脳 ”として大規模言語モデル(LLM)へのアクセスが必要だ。Ollamaのような)ローカルモデルを使うこともできるが、パフォーマンスに制約のあるデバイスでは、クラウドAPIがより良いソリューションだ。

ここでは 推理の時代 (AiHubMix) GPT-4、GLM-5などの主流モデルへのアクセスインタフェースを提供し、開発者に一定の無償サポートを行う集計APIサービスを提供。

- APIキーの取得:

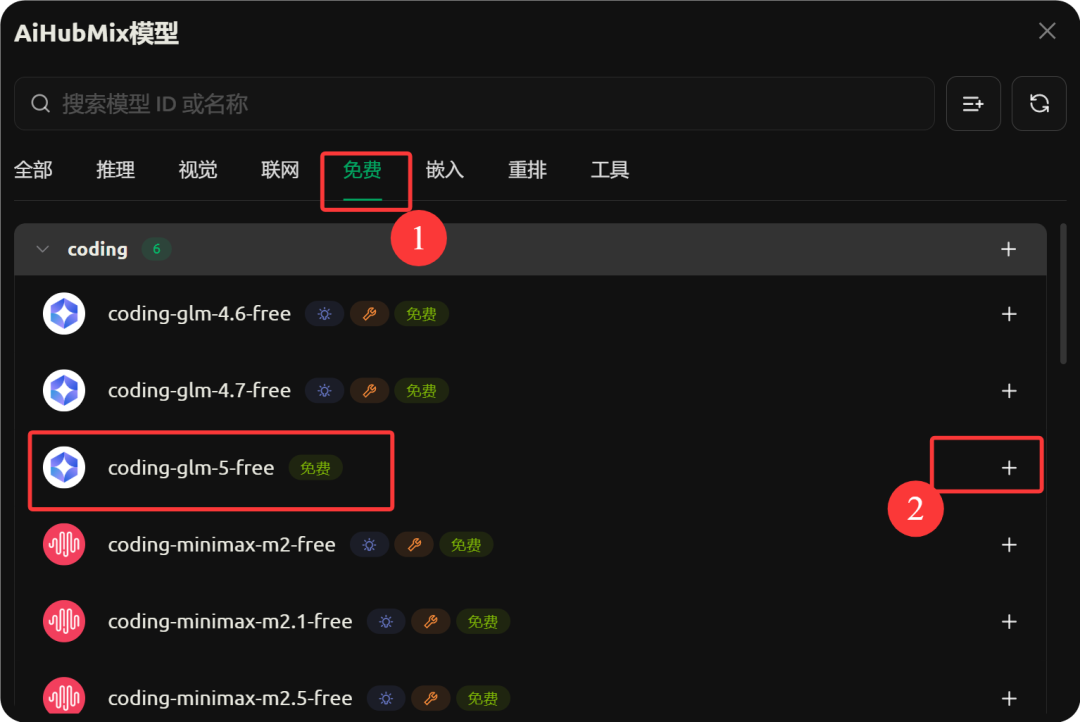

Age of Reasoningのウェブサイト(aihubmix.com)にアクセスし、アカウント登録をしてデフォルトのAPIコールクレジットを受け取ってください。- 自由戦略プラットフォームで利用可能な無料モデルには、次のようなものがあります。

coding-glm-5-free(コーディングに適している)、Gemini 3 Flashその他 - 制限速度国内シリーズのモデルは、通常5RPM(5リクエスト/分)/500RPD(500リクエスト/日)に制限されており、個人的なテストや簡単なエージェントとのやり取りには十分です。

あなたの

sk-xxxxxxxxフォーマット (API-Key) を使用します。 - 自由戦略プラットフォームで利用可能な無料モデルには、次のようなものがあります。

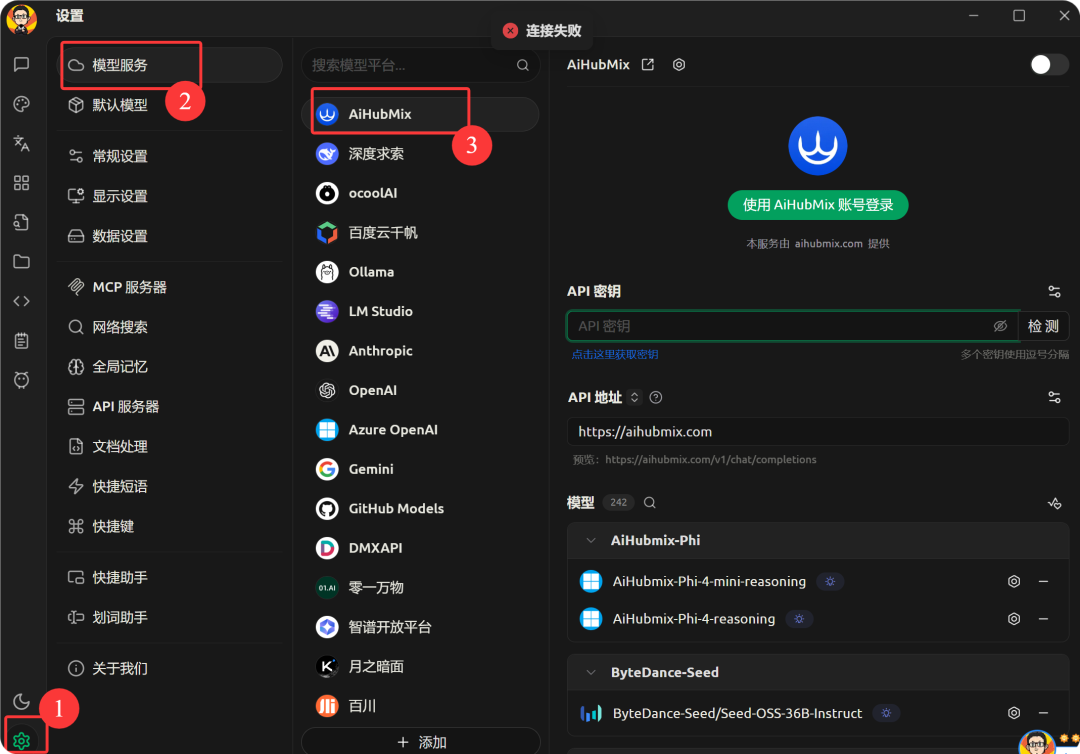

- チェリースタジオでのドッキングサービス:

ソフトウェアの左下にある歯車のアイコンをクリックしてセットアップモデルサービス “リストから検索したい場合は、”モデルサービス "ボタンをクリックしてください。 AiHubMix。

- APIアドレス通常は自動的に充填されます(https://aihubmix.com)。

- APIキー取得したキーを貼り付ける。

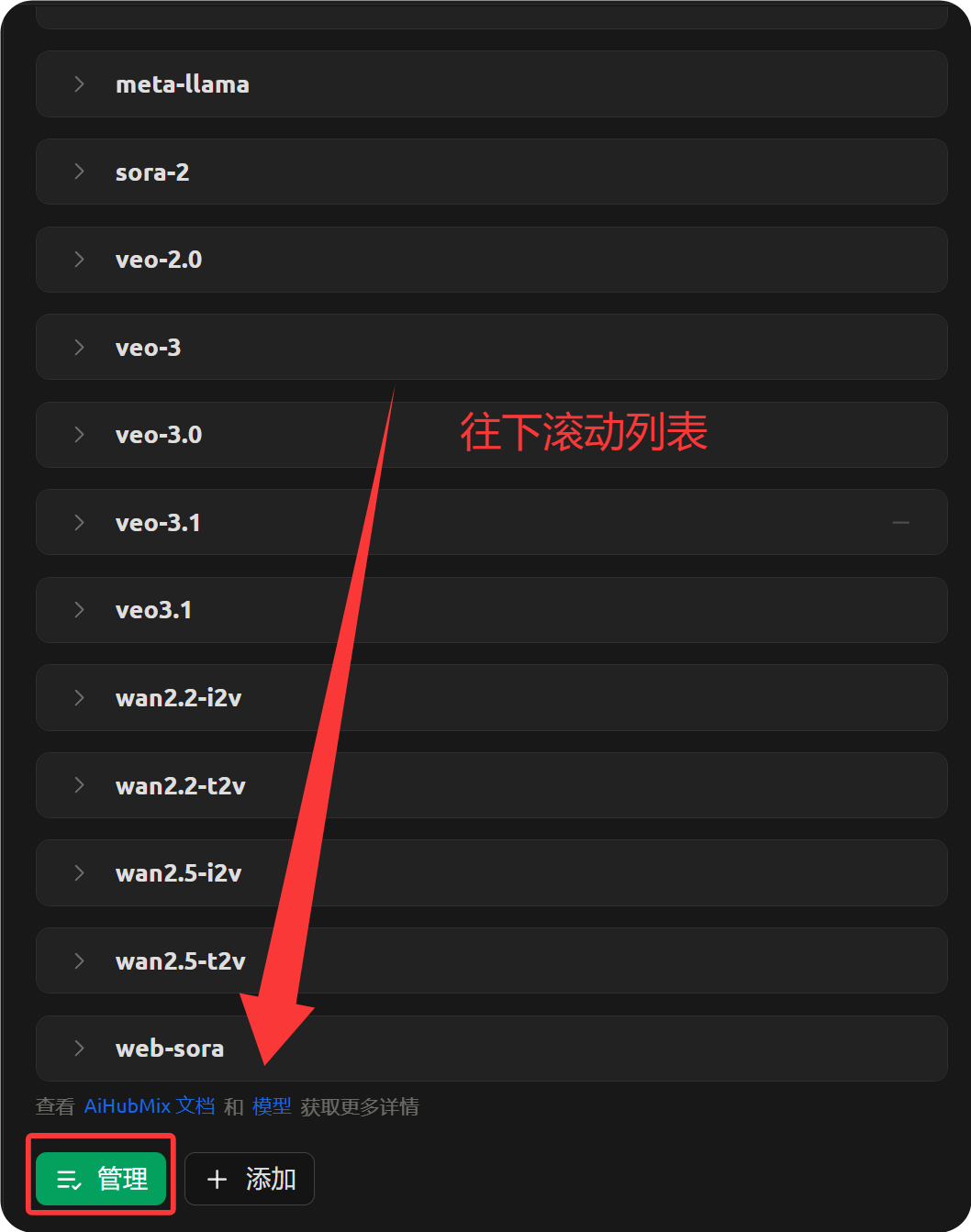

- 特定モデルのフィルタリングと追加:

右上の「サービス・プロバイダー・スイッチ」をオンにし(緑色になる)、下の「管理」ボタンをクリックする。

モデル管理インタフェースでは、悪用を避けるために、余分な有料モデルを削除することをお勧めします。無料 “カテゴリに移動し

coding-glm-5-freeOpenClaw はタスクを実行するときに大量のトークンを消費するので、これは非常に重要です。なぜなら、OpenClaw はタスクを実行する際に多くのトークンを消費するからです。コードに最適化されたフリーモデルを使用することで、試行錯誤のコストを大幅に削減できます。

- 接続性テスト:

APIキーの右側にある “Detect ”をクリックし、次のように入力する。coding-glm-5-free握手テストを行う。接続成功」とは、脳と身体の間に神経接続が確立されたことを意味する。

第III段階:イニシエーションと交流

OpenClaw インターフェースに戻り、モデル選択フィールドで先ほど設定したモデルを指定します。 coding-glm-5-freeクリックアクティベート。

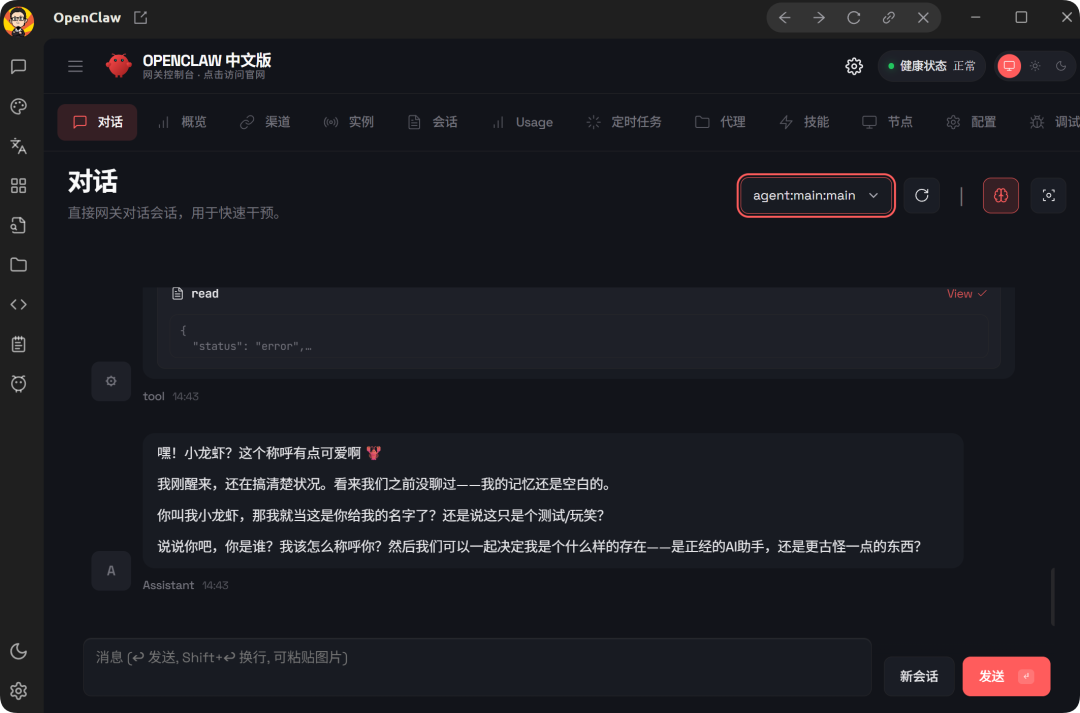

この時点では、チャットボットと同じようにコマンドを入力できるが、結果は大きく異なる。

と入力してみてください。“こんにちは、ザリガニさん。”

OpenClawは、テキストに返信するだけでなく、あなたの意図を解析するためにバックグラウンドでコードを書くこともできます。例えば、「デスクトップファイルの整理」や「ウェブページのデータのクロール」をお願いしてみましょう。単に話すだけでなく、あなたのために仕事をしてくれるのです。

結語

Cherry Studioを使うことで、複雑なOpenClawの導入プロセスを数クリックに圧縮することができました。これは単なる技術ツールのインストール作業ではなく、AIによるワークフローの変革の始まりでした。スキルプラグインをインストールするにしても、複雑なタスクのためにGPT-4のような強力なモデルを活用するにしても、このローカライズされたAgentプラットフォームがあれば可能性は無限に広がります。

探索中にエラーに遭遇した場合(例えば、Python環境の依存関係が見つからない、APIクォータを使い果たしたなど)、便利なAIアシスタント(Beanbag、ChatGPTなど)を活用して、診断のためにエラーのスクリーンショットをアップロードすることは、すべてのAI開発者にとって非常に効率的な問題解決方法だ。