Wan ist eine KI-gestützte Website zur Erstellung visueller Inhalte, deren Herzstück eine Website namensWan 2.2Das Open-Source-Modell des Nutzer können mit diesem Tool schnell Text, Bilder oder Audio in hochwertige Videos umwandeln. Die Website unterstützt eine Vielzahl von Erzeugungsmethoden, darunter "Text zu Video", "Bild zu Video" und die einzigartige Funktion "Stimme zu Video", die digitale menschliche Videos mit natürlichen Ausdrücken und Bewegungen auf der Grundlage der Zeichen in den Audiodatei-gesteuerten Bildern erzeugen kann. Das Modell Wan 2.2 verwendet eine fortschrittliche MoE-Architektur (Mixed-Mode Expertise), die die Qualität und Effizienz der erzeugten Videos verbessert und sogar auf Grafikkarten der Verbraucherklasse laufen kann. Es wurde entwickelt, um Inhaltserstellern, Entwicklern und akademischen Forschern eine leistungsstarke und benutzerfreundliche Plattform für die Videoerstellung zu bieten, sei es für die Produktion von Kurzfilmen mit Kinofeeling oder für die Erstellung realistischer digitaler Menschenbilder.

Funktionsliste

- Text zu Video. Geben Sie einen beschreibenden Text ein, und die KI wandelt ihn in ein bewegtes Video um, wobei Sie den filmischen Stil des Videos genau steuern können.

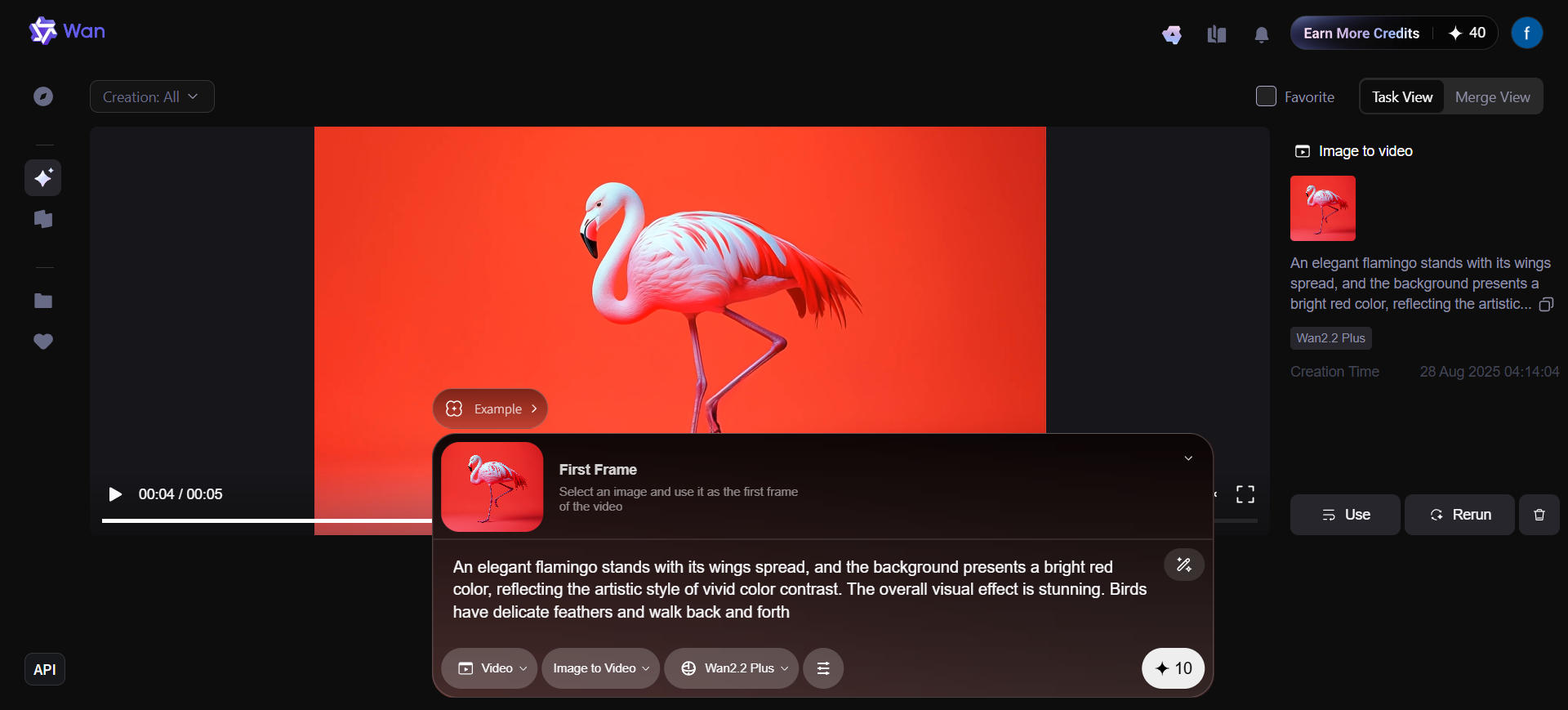

- Bild zu Video. Laden Sie ein statisches Bild hoch, und AI kann es bewegen, um ein Video zu erzeugen. Das Modell leistet gute Arbeit, indem es das Thema und die stilistische Konsistenz des Originalbildes beibehält.

- Rede zu Video. Dies ist eine besondere Funktion der Website. Laden Sie ein Bild (z. B. ein Cartoonbild, ein Tier- oder Charakterfoto) und einen Audioclip hoch, und die KI kann die Figur auf dem Bild steuern, um ein Video mit reichhaltiger Mimik und Körperbewegungen auf der Grundlage des Audioinhalts zu erzeugen.

- Text zu Bild. Geben Sie Textvorgaben ein, um qualitativ hochwertige Bilder mit Fotorealismus oder verschiedenen künstlerischen Stilen zu erstellen.

- 开源模型: Das Kernmodell Wan 2.2 ist quelloffen und kann von Entwicklern für ihre eigenen Projekte oder für die Sekundärentwicklung verwendet werden.

- Hohe Auflösung. Unterstützung für die Erstellung von Videos mit einer Auflösung von 720p und 24 Bildern pro Sekunde, optimiert für den effizienten Betrieb auf Consumer-Grafikkarten wie der 4090.

Hilfe verwenden

Die Wan-Website bietet eine Reihe von leistungsstarken KI-Tools, mit denen sich Videos und Bilder schnell und einfach erstellen lassen. Selbst wenn Sie keinen professionellen Hintergrund haben, können Sie mit den folgenden Schritten ganz einfach loslegen.

1. der Zugang zur Hauptschnittstelle und das Verständnis dieser Schnittstelle

Besuchen Sie zunächst die offizielle Website von Wan über Ihren Browser. Die Startseite der Website zeigt deutlich die wichtigsten Funktionsmodule:

- Rede auf Video

- Bild zu Video

- Text zu Video

- Text zu Bild

Jede Funktion hat eine Schaltfläche "Jetzt ausprobieren" oder "Jetzt ausprobieren", die angeklickt werden kann, um die entsprechende Funktionsschnittstelle zu öffnen. Unten auf der Homepage finden Sie eine detaillierte Beschreibung der Kerntechnologie, des Wan-2.2-Modells, einschließlich der MoE-Architektur, der Datenskala und der technischen Vorteile, die Ihnen helfen, die Leistungsfähigkeit des Tools zu verstehen.

2. die Nutzung der Kernfunktionen

So verwenden Sie die Funktion "Text in Video"

Dies ist eine der am häufigsten verwendeten Funktionen zur schnellen Visualisierung einer Idee oder einer Szene.

- Schritt 1: Rufen Sie den Funktionsbildschirm auf. Suchen Sie das Modul "Text to Video" auf der Startseite der Website und klicken Sie auf die Schaltfläche "Try Now".

- Schritt 2: Geben Sie den Beschreibungstext ein. Es wird ein Texteingabefeld angezeigt, in das Sie eine detaillierte Beschreibung des zu erzeugenden Videomaterials eingeben können. Je genauer die Beschreibung ist, desto mehr wird der erzeugte Effekt den Erwartungen entsprechen. Sie können z. B. eingeben: "Ein Astronaut reitet auf einem Pferd auf dem Mars mit einem wunderschönen Sternenhimmel im Hintergrund, das Filmmaterial hat Kinoatmosphäre".

- Schritt 3: Passen Sie die Parameter an (falls vorhanden). Die Schnittstelle kann einige erweiterte Optionen bieten, wie z. B. Videodauer, Auflösung (unterstützt 480P und 720P), Bildschirmstil (z. B. "cinematic", "anime style") und so weiter. Wählen Sie nach Ihren Bedürfnissen.

- Schritt 4: Generieren und Herunterladen. Klicken Sie auf die Schaltfläche "Generieren" und die KI beginnt mit der Bearbeitung Ihrer Anfrage, was einige Minuten dauern kann. Sobald die Verarbeitung abgeschlossen ist, erscheint das Video auf der Benutzeroberfläche und Sie können das Ergebnis in der Vorschau ansehen. Wenn Sie zufrieden sind, können Sie es herunterladen und auf Ihrem Computer speichern.

So verwenden Sie die Funktion "Bild zu Video"

Diese Funktion kann ein statisches Bild zum Leben erwecken.

- Schritt 1: Rufen Sie den Funktionsbildschirm auf. Suchen Sie das Modul "Image to Video" auf der Homepage und klicken Sie auf "Try Now".

- Schritt 2: Laden Sie Ihr Bild hoch. Klicken Sie auf die Schaltfläche Hochladen und wählen Sie ein Bild aus, das Sie in ein Video umwandeln möchten. Die besten Ergebnisse erzielen Sie, wenn Sie ein Bild mit einem klaren, hochwertigen Motiv wählen.

- Schritt 3: Richten Sie dynamische Effekte ein. Sie können einige einfache Textanweisungen eingeben, um die KI anzuweisen, wie sie das Bild bewegen soll, z. B. "der Wind weht, die Blätter wiegen sich sanft und das Haar der Figur flattert im Wind".

- Schritt 4: Erzeugen Sie das Video. Klicken Sie auf die Schaltfläche "Generieren" und warten Sie, bis die KI das Bild verarbeitet hat. Danach können Sie sehen, wie aus einem Standbild ein bewegtes Video wird.

So verwenden Sie die Funktion "Sprachgeneriertes Video" (Sonderfunktion)

Dies ist eines der Highlights der Wan-Website und kann zur Erstellung digitaler Podcasts, zum Geschichtenerzählen und mehr genutzt werden.

- Schritt 1: Rufen Sie den Funktionsbildschirm auf. Suchen Sie das Modul "Speech to Video" oben auf der Homepage.

- Schritt 2: Laden Sie ein Charakterbild hoch. Laden Sie ein Bild hoch, das die Hauptfigur des Videos darstellt. Dieses Bild kann ein Foto einer realen Person, ein Cartoon-Bild oder sogar ein Bild eines Tieres sein.

- Schritt 3: Laden Sie die Audiodatei hoch. Laden Sie ein Audiomaterial hoch, das als Quelle für das Sprechen und die Mimik der Figur verwendet wird. Das kann eine Aufnahme von Ihnen oder eine Voiceover-Datei sein.

- Schritt 4: Beginnen Sie mit der Erstellung. Klicken Sie auf die Schaltfläche "Generieren". Die KI analysiert das Audio auf Stimme und Emotionen und übersetzt es in fotorealistische Gesichtsausdrücke, Mundformen und Kopfbewegungen für den Charakter.

- Schritt 5: Vorschau und Export. Wenn es fertig ist, können Sie sehen, wie die Figur im Bild entsprechend Ihrem Audio "spricht", und der Effekt ist sehr lebendig. Sie können es als Videodatei exportieren und in Ihren Projekten verwenden.

3. die Verwendung von Open-Source-Modellen

Für Entwickler und Technikbegeisterte bietet die Wan-Website auch ihre KernmodelleWan2.2Die Open-Source-Version des

- Besuchen Sie GitHub: In der Regel befindet sich unter dem entsprechenden Funktionsmodul einer Website ein "Github"-Link. Wenn Sie auf den Link klicken, gelangen Sie auf die Seite des Open-Source-Projekts.

- Herunterladen und einsetzen: Auf der GitHub-Seite finden Sie den Quellcode des Modells, Pre-Training-Gewichte und eine ausführliche Dokumentation zur Bereitstellung. Anhand der Dokumentation können Sie das Modell auf Ihrem eigenen Server oder auf einem lokalen Computer einsetzen (der mit einer Consumer-Grafikkarte wie der NVIDIA 4090 ausgestattet sein muss).

- Sekundäre Entwicklung: Das Open-Source-Modell bietet Ihnen große Flexibilität bei der Feinabstimmung des Modells auf Ihre Bedürfnisse oder bei der Integration in Ihre eigenen Anwendungen für individuellere Funktionen.

Anwendungsszenario

- Autoren von Inhalten und soziale Medien

Videoblogger und Betreiber sozialer Medien können mit der Funktion "Text zu Video" Texte schnell in ansprechende Kurzvideos verwandeln. Mit der Funktion "Voice Generated Video" können Sie eine einzigartige virtuelle digitale Person IP erstellen, um Nachrichten zu verbreiten, Wissen zu erklären oder mit Fans zu interagieren, was die Hemmschwelle und die Kosten für einen Auftritt vor der Kamera erheblich reduziert. - Werbung und Marketing

Marketingteams können schnell Demos von Produktwerbevideos erstellen, und mit der Funktion "Bild zu Video" können statische Produktbilder oder Poster in dynamische Anzeigen verwandelt werden, um die Attraktivität von Werbematerialien zu erhöhen. Gleichzeitig können Sie mit der Funktion "Text zu Video" schnell mehrere Versionen von Videowerbung auf der Grundlage von Marketingtexten für A/B-Tests erstellen. - Bildung und Ausbildung

Lehrer oder Ausbilder können mit der Funktion "Sprachgeneriertes Video" ein Cartoon-Bild und den Ton der Lektion hochladen, um interessante animierte Lehrvideos zu erstellen, die das Interesse der Schüler am Lernen steigern. Komplexe Konzepte können auch durch "Text zu Video" visualisiert werden, um das Verständnis der Schüler zu verbessern. - Entwickler und akademische Forschung

Da das Wan-2.2-Modell quelloffen ist, können Entwickler es in ihre Anwendungen integrieren, um ihren Produkten KI-Videogenerierungsfunktionen hinzuzufügen. Akademische Forscher können auf der Grundlage dieses fortschrittlichen Modells Sekundärentwicklungen durchführen, um die Grenzen der Videogenerierungstechnologie zu erforschen und den Forschungsfortschritt in verwandten Bereichen zu fördern.

QA

- Ist die Wan-Website kostenlos?

Die Website bietet eine "Try now"-Erfahrung an, gibt aber keine detaillierte Preisstrategie an. In der Regel bieten solche Dienste eine kostenlose Testversion für einen bestimmten Zeitraum an und können bei intensiver Nutzung oder kommerzieller Nutzung kostenpflichtig sein. - Wie hoch ist die Qualität des erzeugten Videos?

Laut der Website zeichnet sich das Modell Wan 2.2 durch eine hervorragende Qualität bei der Videogenerierung aus und unterstützt eine Auflösung von bis zu 720p und eine Bildrate von 24 Bildern pro Sekunde. Dank der MoE-Architektur und des umfangreichen Datentrainings sind die erzeugten Videos in Bezug auf Bewegung, Semantik und Ästhetik branchenführend und übertreffen sogar einige kommerzielle Closed-Source-Modelle in einigen Aspekten. - Was für einen Computer brauche ich, um es zu benutzen?

Für die Online-Nutzung der auf der Website bereitgestellten Tools benötigen Sie lediglich einen normalen Computer mit Internetzugang, da alle Berechnungen auf den Cloud-Servern durchgeführt werden. Wenn Sie ein Entwickler sind und das Open-Source-Modell (z. B. TI2V-5B) lokal einsetzen möchten, benötigen Sie einen Computer mit einer High-End-Grafikkarte der Verbraucherklasse (z. B. NVIDIA 4090). - Wer besitzt das Urheberrecht an dem erstellten Video?

Auf der Website wird nicht ausdrücklich auf das Urheberrecht an den generierten Inhalten hingewiesen. Normalerweise liegt das Urheberrecht an Inhalten, die aus vom Nutzer bereitgestelltem Originalmaterial (Text, Bilder, Audio) generiert wurden, beim Nutzer, aber es wird empfohlen, die Nutzungsvereinbarung und die Urheberrechtsbestimmungen der Website vor der Nutzung im Detail zu lesen.