Together AI ist eine Plattform, die sich auf generative KI-Modelle konzentriert und eine breite Palette von Dienstleistungen vom Modelltraining über die Feinabstimmung bis hin zur Inferenz anbietet. Benutzer können die hocheffiziente Inferenz-Engine und GPU-Cluster von Together AI nutzen, um eine Vielzahl von Open-Source-Modellen schnell bereitzustellen und auszuführen. Die Plattform unterstützt mehrere Modellarchitekturen, um unterschiedliche Anforderungen von KI-Anwendungen zu erfüllen.

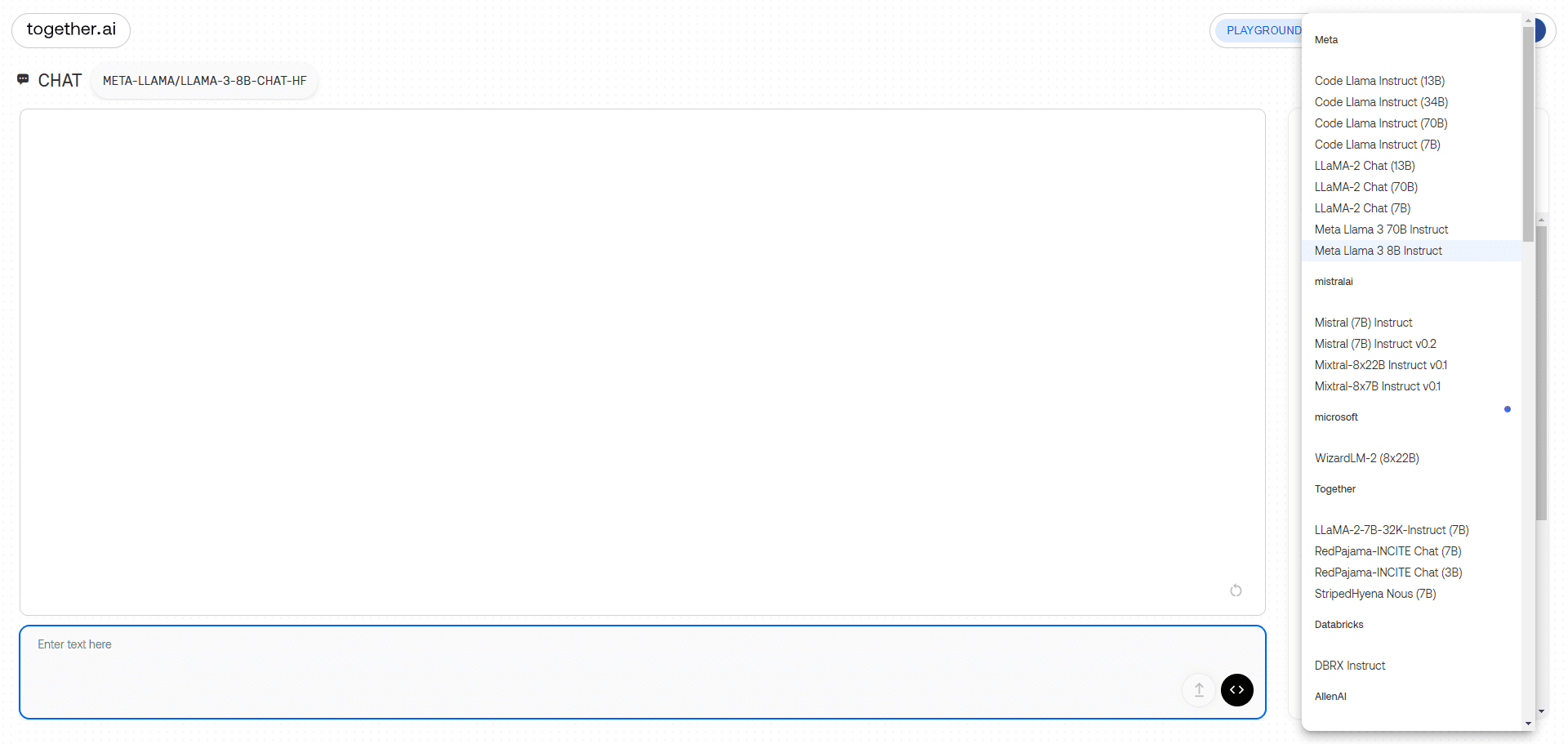

Große Modell-Chat-Demo-Schnittstelle

Funktionsliste

- Inferenz-APIUnterstützt das Reasoning auf mehr als 100 Open-Source-Modellen und bietet sowohl serverlose als auch dedizierte Instanzmodelle.

- FeinabstimmungsfunktionErmöglicht den Nutzern die Feinabstimmung generativer KI-Modelle unter Verwendung ihrer eigenen Daten, wobei das Eigentum an den Daten erhalten bleibt.

- GPU-ClusterBietet hochmoderne Cluster mit 16 bis 1000+ GPUs zur Unterstützung des Modelltrainings in großem Maßstab.

- Benutzerdefinierte ModellschulungTrainieren Sie hochmoderne Modelle von Grund auf und unterstützen Sie mehrere Modellarchitekturen.

- multimodales ModellUnterstützt Bilderkennung, Bildinferenz, Bilderzeugung und mehr.

- Effiziente InferenzmaschineIntegration der neuesten Inferenztechnologien wie FlashAttention-3 und Flash-Decoding zur Bereitstellung schneller und präziser Inferenzdienste.

Hilfe verwenden

Installation und Nutzung

- Registrieren & Anmelden:

- Besuchen Sie die Website von Together AI (https://www.together.ai/) und klicken Sie auf die Schaltfläche "Start Building", um sich zu registrieren.

- Sobald die Registrierung abgeschlossen ist, melden Sie sich bei Ihrem Konto an und gehen Sie zum Benutzer-Kontrollzentrum.

- Dienst auswählen:

- Wählen Sie im Bedienfeld das zu verwendende Servicemodul aus, z. B. die Inferenz-API, die Feinabstimmungsfunktion oder den GPU-Cluster.

- Wählen Sie je nach Bedarf den serverlosen oder den dedizierten Instanzmodus.

- Verwendung der Inferenz-API:

- Wählen Sie das Open-Source-Modell aus, das Sie ausführen möchten, z. B. Llama-3, RedPajama, usw.

- Integrieren Sie das Modell über die von Together AI bereitgestellte API-Schnittstelle in Ihre Anwendung.

- Erstellen Sie Ihre eigene RAG-Anwendung mit den eingebetteten Endpunkten von Together AI.

- Feinabstimmungsfunktion:

- Laden Sie Ihren Datensatz hoch und wählen Sie die Modelle aus, die einer Feinabstimmung unterzogen werden müssen.

- Konfigurieren Sie die Feinabstimmungsparameter, um den Feinabstimmungsprozess zu starten.

- Sobald die Feinabstimmung abgeschlossen ist, laden Sie das feinabgestimmte Modell herunter und stellen es bereit.

- GPU-Cluster-Nutzung:

- Wählen Sie die gewünschte GPU-Clustergröße aus und konfigurieren Sie die Hardwareparameter.

- Laden Sie Trainingsdaten und Modellcode hoch, um mit dem Training zu beginnen.

- Nach Abschluss des Trainings wird das trainierte Modell zur Inferenz oder weiteren Feinabstimmung heruntergeladen.

- Benutzerdefinierte Modellschulung:

- Wählen Sie das Modul Custom Model Training, um die Modellarchitektur und die Trainingsparameter zu konfigurieren.

- Laden Sie den Datensatz hoch und starten Sie den Trainingsprozess.

- Sobald das Training abgeschlossen ist, wird das Modell heruntergeladen, um es einzusetzen und Schlussfolgerungen zu ziehen.

Arbeitsablauf

- Zugriff auf das BedienfeldNach dem Einloggen gehen Sie zum Bedienfeld und wählen das gewünschte Servicemodul aus.

- KonfigurationsparameterKonfigurieren Sie die Inferenz-, Feinabstimmungs- oder Trainingsparameter nach Bedarf.

- Daten hochladenUpload des gewünschten Datensatzes oder Modellcodes.

- Beginn der MissionInitiieren Sie Argumentations-, Feinabstimmungs- oder Trainingsaufgaben und überwachen Sie den Fortschritt der Aufgaben in Echtzeit.

- Ergebnisse herunterladenNach Abschluss der Aufgabe werden die Modell- oder Inferenzergebnisse zur Anwendungsintegration heruntergeladen.

allgemeine Probleme

- Wie wählt man das richtige Modell?

- Wählen Sie das geeignete Open-Source-Modell je nach Anwendungsszenario, z. B. Texterstellung, Bilderkennung usw.

- Was ist, wenn ich bei der Feinabstimmung auf einen Fehler stoße?

- Überprüfen Sie das Datensatzformat und die Parameterkonfigurationen und ziehen Sie die offizielle Dokumentation für Anpassungen zu Rate.

- Schlechte Leistung bei der Nutzung von GPU-Clustern?

- Vergewissern Sie sich, dass die Hardwarekonfiguration den Anforderungen entspricht, und passen Sie die Trainingsparameter an, um die Effizienz zu verbessern.

brauchbares Modell

| Serverless Endpoints | Author | Type | Pricing (per 1M tokens) | |

|---|---|---|---|---|

| Meta Llama 3.2 11B Vision Instruct Turbo | ||||

| Meta | chat | $0.18 | ||

| Meta Llama 3.2 90B Vision Instruct Turbo | ||||

| Meta | chat | $1.20 | ||

| Qwen2.5 7B Instruct Turbo | ||||

| Qwen | chat | $0.30 | ||

| Qwen2.5 72B Instruct Turbo | ||||

| Qwen | chat | $1.20 | ||

| FLUX.1 [schnell] | ||||

| Black Forest Labs | image | See pricing | ||

| FLUX1.1 [pro] | ||||

| Black Forest Labs | image | See pricing | ||

| FLUX.1 [pro] | ||||

| Black Forest Labs | image | See pricing | ||

| FLUX.1 [schnell] Free | ||||

| Black Forest Labs | image | See pricing | ||

| Meta Llama 3.2 3B Instruct Turbo | ||||

| Meta | chat | $0.06 | ||

| Meta Llama Vision Free | ||||

| Meta | chat | Free | ||

| Meta Llama Guard 3 11B Vision Turbo | ||||

| Meta | moderation | $0.18 | ||

| Meta Llama 3.1 8B Instruct Turbo | ||||

| Meta | chat | $0.18 | ||

| Mixtral-8x22B Instruct v0.1 | ||||

| mistralai | chat | $1.20 | ||

| Stable Diffusion XL 1.0 | ||||

| Stability AI | image | See pricing | ||

| Meta Llama 3.1 70B Instruct Turbo | ||||

| Meta | chat | $0.88 | ||

| Meta Llama 3.1 405B Instruct Turbo | ||||

| Meta | chat | $3.50 | ||

| Gryphe MythoMax L2 Lite (13B) | ||||

| Gryphe | chat | $0.10 | ||

| Salesforce Llama Rank V1 (8B) | ||||

| salesforce | rerank | $0.10 | ||

| Meta Llama Guard 3 8B | ||||

| Meta | moderation | $0.20 | ||

| Meta Llama 3 70B Instruct Turbo | ||||

| Meta | chat | $0.88 | ||

| Meta Llama 3 70B Instruct Lite | ||||

| Meta | chat | $0.54 | ||

| Meta Llama 3 8B Instruct Lite | ||||

| Meta | chat | $0.10 | ||

| Meta Llama 3 8B Instruct Turbo | ||||

| Meta | chat | $0.18 | ||

| Meta Llama 3 70B Instruct Reference | ||||

| Meta | chat | $0.90 | ||

| Meta Llama 3 8B Instruct Reference | ||||

| Meta | chat | $0.20 | ||

| Qwen 2 Instruct (72B) | ||||

| Qwen | chat | $0.90 | ||

| Gemma-2 Instruct (27B) | ||||

| chat | $0.80 | |||

| Gemma-2 Instruct (9B) | ||||

| chat | $0.30 | |||

| Mistral (7B) Instruct v0.3 | ||||

| mistralai | chat | $0.20 | ||

| Qwen 1.5 Chat (110B) | ||||

| Qwen | chat | $1.80 | ||

| Meta Llama Guard 2 8B | ||||

| Meta | moderation | $0.20 | ||

| WizardLM-2 (8x22B) | ||||

| microsoft | chat | $1.20 | ||

| DBRX Instruct | ||||

| Databricks | chat | $1.20 | ||

| DeepSeek LLM Chat (67B) | ||||

| DeepSeek | chat | $0.90 | ||

| Gemma Instruct (2B) | ||||

| chat | $0.10 | |||

| Mistral (7B) Instruct v0.2 | ||||

| mistralai | chat | $0.20 | ||

| Mixtral-8x7B Instruct v0.1 | ||||

| mistralai | chat | $0.60 | ||

| Mixtral-8x7B v0.1 | ||||

| mistralai | language | $0.60 | ||

| Qwen 1.5 Chat (72B) | ||||

| Qwen | chat | $0.90 | ||

| Llama Guard (7B) | ||||

| Meta | moderation | $0.20 | ||

| Nous Hermes 2 – Mixtral 8x7B-DPO | ||||

| NousResearch | chat | $0.60 | ||

| Mistral (7B) Instruct | ||||

| mistralai | chat | $0.20 | ||

| Mistral (7B) | ||||

| mistralai | language | $0.20 | ||

| LLaMA-2 Chat (13B) | ||||

| Meta | chat | $0.22 | ||

| LLaMA-2 Chat (7B) | ||||

| Meta | chat | $0.20 | ||

| LLaMA-2 (70B) | ||||

| Meta | language | $0.90 | ||

| Code Llama Instruct (34B) | ||||

| Meta | chat | $0.78 | ||

| Upstage SOLAR Instruct v1 (11B) | ||||

| upstage | chat | $0.30 | ||

| M2-BERT-Retrieval-32k | ||||

| Together | embedding | $0.01 | ||

| M2-BERT-Retrieval-8k | ||||

| Together | embedding | $0.01 | ||

| M2-BERT-Retrieval-2K | ||||

| Together | embedding | $0.01 | ||

| UAE-Large-V1 | ||||

| WhereIsAI | embedding | $0.02 | ||

| BAAI-Bge-Large-1p5 | ||||

| BAAI | embedding | $0.02 | ||

| BAAI-Bge-Base-1p5 | ||||

| BAAI | embedding | $0.01 | ||

| MythoMax-L2 (13B) | ||||

| Gryphe | chat | $0.30 |

Anwendungsbeispiel

Beispiele für Modellüberlegungen

import os

import requests

url = "https://api.together.xyz/v1/chat/completions"

payload = {

"model": "mistralai/Mixtral-8x7B-Instruct-v0.1",

"max_tokens": 512,

"temperature": 0.7,

"top_p": 0.7,

"top_k": 50,

"repetition_penalty": 1

}

headers = {

"accept": "application/json",

"content-type": "application/json",

"Authorization": "Bearer TOGETHER_API_KEY"

}

response = requests.post(url, json=payload, headers=headers)

print(response.text)

Beispiel für die Feinabstimmung des Modells

import os

import requests

url = "https://api.together.xyz/v1/fine-tune"

payload = {

"model": "togethercomputer/llama-2-70b-chat",

"data": "path/to/your/data",

"epochs": 3,

"batch_size": 8

}

headers = {

"accept": "application/json",

"content-type": "application/json",

"Authorization": "Bearer TOGETHER_API_KEY"

}

response = requests.post(url, json=payload, headers=headers)

print(response.text)