TEN Framework ist eine Open-Source-Softwareplattform, die Entwicklern hilft, multimodale Sprach-KI-Intelligenzen in Echtzeit und mit geringer Latenz zu erstellen. Es unterstützt mehrere Programmiersprachen, darunter C, C++, Go, Python, JavaScript und TypeScript, und ermöglicht es Entwicklern, schnell Intelligenzen mit Sprach-, Seh- und Textinteraktionsfunktionen zu erstellen. Das Framework bietet ein modulares Erweiterungssystem, das sich nahtlos in externe Plattformen wie Dify und Coze integrieren lässt. Es unterstützt auch den Einsatz in der Cloud und auf Edge-Geräten, wodurch es sich für eine Vielzahl von Anwendungsszenarien eignet. Das TEN-Framework wird unter der Apache-2.0-Lizenz veröffentlicht, die die Open-Source-Zusammenarbeit fördert, und es steht Entwicklern frei, sich an Codebeiträgen, Dokumentationsverbesserungen oder der Entwicklung von Funktionen zu beteiligen. Die offizielle Dokumentation und Blogs bieten detaillierte Anleitungen für Anfänger und professionelle Entwickler.

Funktionsliste

- Unterstützung von Sprachinteraktion in Echtzeit: Erzielen Sie einen Vollduplex-Dialog, unterstützen Sie Spracherkennung in Echtzeit und Text-to-Speech.

- Multimodale Unterstützung: Kombination von Sprach-, Bild- und Textverarbeitung zum Aufbau integrierter KI-Intelligenzen.

- Modulares Erweiterungssystem: Bietet wiederverwendbare Erweiterungen für die einfache Integration von externen Tools wie Wetterabfrage, Websuche usw.

- Plattformübergreifender Betrieb: unterstützt Windows, Mac, Linux und mobile Geräte, kompatibel mit Edge-Geräten wie ESP32.

- Workflow-Build-Tool: Vereinfacht die Entwicklung von Smart Bodies durch die Bereitstellung einer Low-Code/No-Code-Schnittstelle über den TMAN Designer.

- Integration der wichtigsten großen Modelle: Unterstützung von Llama 4, Google Gemini, DeepSeek R1 usw., die eine Interaktion in Echtzeit ermöglichen.

- Bilderzeugung in Echtzeit: Die StoryTeller-Erweiterung unterstützt die Erzeugung von Bildern zu einer Geschichte, um das interaktive Erlebnis zu verbessern.

- Unterstützung der Open-Source-Zusammenarbeit: Bietet GitHub Issues und Projekte für Entwickler, um Code beizusteuern oder Feedback zu Problemen zu geben.

Hilfe verwenden

Einbauverfahren

Der Installationsprozess für das TEN-Framework variiert je nach Zielplattform und Entwicklungsanforderungen. Die folgenden generischen Installationsschritte, die auf der offiziellen Dokumentation basieren, sind für die meisten Benutzer geeignet:

- Vorbereitung der Umwelt

- Stellen Sie sicher, dass die erforderlichen Entwicklungswerkzeuge auf Ihrem System installiert sind. Für die Entwicklung von C/C++ ist beispielsweise die Installation eines Compilers (z. B. GCC) erforderlich, und für die Entwicklung von Python ist die Umgebung Python 3.8+ erforderlich.

- Installieren Sie Git, um das TEN Framework-Code-Repository zu klonen. Führen Sie den folgenden Befehl aus, um das Repository zu klonen:

git clone https://github.com/TEN-framework/ten-framework.git - Rufen Sie den Projektkatalog auf:

cd ten-framework

- Installation von Abhängigkeiten

- Das TEN-Framework stützt sich auf eine Reihe von Bibliotheken von Drittanbietern, die in den jeweiligen Paketbeschreibungen aufgeführt sind.

LICENSEDatei. Führen Sie den folgenden Befehl aus, um die grundlegenden Abhängigkeiten zu installieren:pip install -r requirements.txt - Für C/C++-Komponenten verwendet das TEN-Framework ein Build-System, das auf Google GN basiert. Die GN-Tools müssen, wie in den folgenden Schritten beschrieben, installiert werden

ten_gnTeilmodul desREADME.md:git submodule update --init --recursive cd core/ten_gn ./configure

- Das TEN-Framework stützt sich auf eine Reihe von Bibliotheken von Drittanbietern, die in den jeweiligen Paketbeschreibungen aufgeführt sind.

- Externe Dienste konfigurieren

- Der TEN-Rahmen unterstützt die Integration mit externen APIs wie Deepgram (Spracherkennung), Elevenlabs (Text-to-Speech) und OpenAI (Big Models). Die Nutzer müssen sich für diese Dienste registrieren und einen API-Schlüssel erhalten.

- Erstellen Sie eine Konfigurationsdatei im Stammverzeichnis des Projekts (z. B.

config.json), geben Sie den API-Schlüssel ein:{ "agora_app_id": "<your_agora_app_id>", "openai_api_key": "<your_openai_api_key>", "deepgram_api_key": "<your_deepgram_api_key>", "elevenlabs_api_key": "<your_elevenlabs_api_key>" } - Diese Schlüssel sind über eine kostenlose Testversion auf jeder Plattform verfügbar, siehe die Dokumentation für das TEN-Portal.

- Lauf Spielplatz

- Die TEN stellt ein Playground-Beispiel zur Verfügung, mit dem Sie sich schnell mit den Funktionen des Frameworks vertraut machen können. Führen Sie den folgenden Befehl aus, um es zu starten:

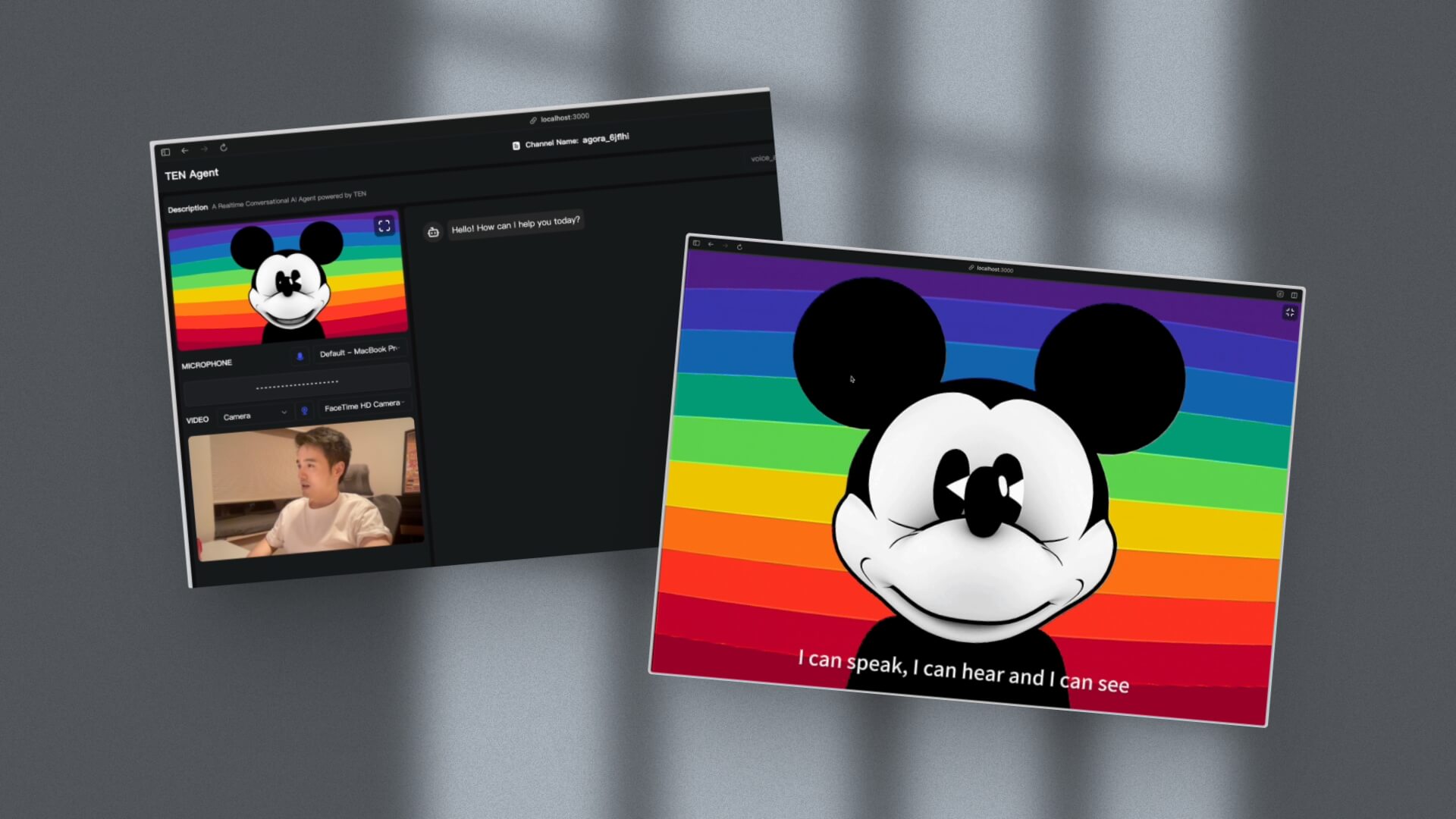

python playground.py - Playground unterstützt die Interaktion mit dem TEN-Agenten zur Demonstration von Echtzeit-Sprachdialogen und Bilderzeugungsfunktionen.

- Die TEN stellt ein Playground-Beispiel zur Verfügung, mit dem Sie sich schnell mit den Funktionen des Frameworks vertraut machen können. Führen Sie den folgenden Befehl aus, um es zu starten:

Funktion Betriebsablauf

Sprachinteraktion in Echtzeit

Das TEN-Framework ermöglicht Sprachinteraktion in Echtzeit durch den TEN-Agenten. Die Benutzer können es durch die folgenden Schritte erleben:

- Nach dem Start des TEN-Agenten wählen Sie DeepSeek R1 oder Google Gemini als Sprachmodell.

- Das System verwendet das Mikrofon zur Spracheingabe, wandelt die Sprache in Echtzeit in Text um und generiert eine Antwort anhand eines großen Modells.

- Die Antworten werden über die Text-to-Speech-Funktion von Elevenlabs als Sprache ausgegeben.

- Beispiel: Sagen Sie "Erzählen Sie eine Geschichte über ein Abenteuer im Wald", und der TEN-Agent wird die Geschichte und das dazugehörige Bild über die StoryTeller-Erweiterung generieren.

Konstruktion von Arbeitsabläufen (TMAN Designer)

TMAN Designer ist ein Low-Code-Tool zum schnellen Aufbau von KI-Intelligenzen:

- Zugang zum TMAN Designer Webinterface (zur lokalen Ausführung oder zum Zugriff auf die offiziell verfügbare Online-Version).

- Ziehen Sie die Module per Drag & Drop in die Schnittstelle, um einen Sprachinteraktionsfluss zu erstellen. Fügen Sie zum Beispiel das Modul "Spracheingabe" hinzu, um eine Verbindung zum Modul "OpenAI-Verarbeitung" herzustellen, und verbinden Sie es dann mit dem Modul "Sprachausgabe".

- Nachdem Sie den Workflow gespeichert haben, klicken Sie auf die Schaltfläche "Ausführen", um die Interaktion des Smart Body zu testen.

- Der TMAN Designer unterstützt die Umschaltung zwischen dunklen und hellen Themen, einen integrierten Editor und einen Log-Viewer für einfaches Debugging.

Erweiterte Integration

Der modulare Aufbau des TEN-Frameworks ermöglicht es Entwicklern, eigene Erweiterungen hinzuzufügen. Zum Beispiel die Integration einer Wetterabfragefunktion:

- Laden Sie die Erweiterung Weather Check herunter und installieren Sie sie im TEN-Framework unter

extensionsKatalog. - Fügen Sie das Modul Weather Check zum Workflow hinzu und konfigurieren Sie den API-Schlüssel (z. B. OpenWeatherMap).

- Testverfahren: Geben Sie ein: "Wie ist das Wetter in Peking heute", und das System gibt Echtzeit-Wetterinformationen zurück.

Hardware-Unterstützung (ESP32)

TEN Agent wird auf dem ESP32-S3 Korvo V3 Entwicklungsboard unterstützt:

- Klon (Lehnwort)

TEN-Agent/esp32-clientVerzweigung. - Verwenden Sie die ESP-IDF-Toolchain zum Kompilieren und Flashen der Firmware, siehe

esp32-client/README.md。 - Sobald die Wi-Fi- und API-Schlüssel konfiguriert sind, ist das ESP32-Gerät bereit, den TEN-Agenten auszuführen, der Echtzeit-Sprachinteraktion unterstützt.

caveat

- Stellen Sie eine stabile Internetverbindung sicher, da einige der Funktionen auf die Cloud-API angewiesen sind.

- Prüfen Sie regelmäßig auf Aktualisierungen auf GitHub, indem Sie die

git pullHolen Sie sich die neueste Version. - Wenn Sie auf Probleme stoßen, senden Sie uns Ihr Feedback auf GitHub Issues oder nehmen Sie an der Discord-Diskussion in der TEN-Community teil (Link im TEN-Portal).

Anwendungsszenario

- Pädagogische Hilfsmittel

TEN Agent kann zur Erstellung interaktiver Lernassistenten verwendet werden. Die Schüler stellen Fragen per Stimme, und der intelligente Körper antwortet in Echtzeit und generiert entsprechende Bilder. Wenn ein Schüler beispielsweise fragt: "Was ist ein Vulkan?", erklärt der TEN-Agent die Grundsätze der Vulkanbildung und generiert ein Bild eines ausbrechenden Vulkans, um das Lerninteresse zu steigern. - Intelligentes Kundenservicesystem

Unternehmen können das TEN-Framework nutzen, um einen sprachgesteuerten Echtzeit-Kundendienst aufzubauen, der mehrsprachige Interaktionen unterstützt. Kundenservice-Intelligenzen können allgemeine Fragen, wie z. B. Bestellanfragen oder technischen Support, bearbeiten und aktuelle Informationen über Websuch-Erweiterungen finden. - IoT-Gerätesteuerung

In einem Smart-Home-Szenario läuft der TEN-Agent auf dem ESP32-Gerät und ermöglicht es dem Benutzer, Geräte per Sprache zu steuern. Sagen Sie zum Beispiel: "Schalten Sie das Wohnzimmerlicht ein", und der intelligente Körper wird den Befehl analysieren und ein Steuersignal senden. - Erzeugung von Kindergeschichten

Eltern können die StoryTeller-Erweiterung nutzen, um TEN Agent die Möglichkeit zu geben, personalisierte Geschichten für ihre Kinder zu erstellen und Illustrationen in Echtzeit zu generieren, um das immersive Erlebnis zu verbessern.

QA

- Ist der TEN-Rahmen kostenlos?

Das TEN-Framework ist vollständig quelloffen und wird unter der Apache-2.0-Lizenz veröffentlicht. Die Nutzer können es kostenlos herunterladen und nutzen. Für einige Funktionen sind jedoch API-Schlüssel von Drittanbietern erforderlich, was mit Kosten verbunden sein kann. - Brauche ich Programmiererfahrung, um den TEN-Rahmen zu nutzen?

Nicht unbedingt: Der TMAN Designer bietet eine Low-Code-Schnittstelle für Benutzer ohne Programmierkenntnisse. Entwickler können mehrere Programmiersprachen durch Code-Anpassungsfunktionen unterstützen. - Welche großen Modelle werden von TEN Agent unterstützt?

Derzeit werden Modelle von Llama 4, Google Gemini, DeepSeek R1 und OpenAI unterstützt, und die Unterstützung weiterer Modelle wird in Zukunft erweitert. - Wie kann der TEN-Agent auf Edge-Geräten eingesetzt werden?

Um den TEN Agent auf Geräten wie ESP32 auszuführen, müssen Sie die ESP-IDF Toolchain installieren und die Firmware konfigurieren. Für weitere Informationen lesen Sie bitteTEN-Agent/esp32-clientDokumentation.