Am 5. August 2025. OpenAI hat mit der offiziellen Veröffentlichung von zwei Modellen namens gpt-oss-120b 和 gpt-oss-20b des Open-Source-Sprachmodells. Dieser Schritt markiert das erste Mal seit GPT-2 seither.OpenAI ist zum ersten Mal zu Open Source für die Sprachmodellierung in großem Maßstab zurückgekehrt, ein Schritt, der weithin als Reaktion auf den zunehmenden Wettbewerb auf dem Markt, insbesondere im Bereich der Meta 的 Llama Serien und Mistral AI und andere direkte Antworten im Zusammenhang mit dem Aufstieg der Open-Source-Macht.

Diese beiden Modelle sind in Apache 2.0 Sie wird unter Lizenz veröffentlicht und gibt Entwicklern und Unternehmen die Freiheit, zu experimentieren, Anpassungen vorzunehmen und sie sogar kommerziell einzusetzen, ohne sich Gedanken über Urheberrechts- oder Patentrisiken zu machen.

Modellcharakterisierung und tiefgreifende Anpassung

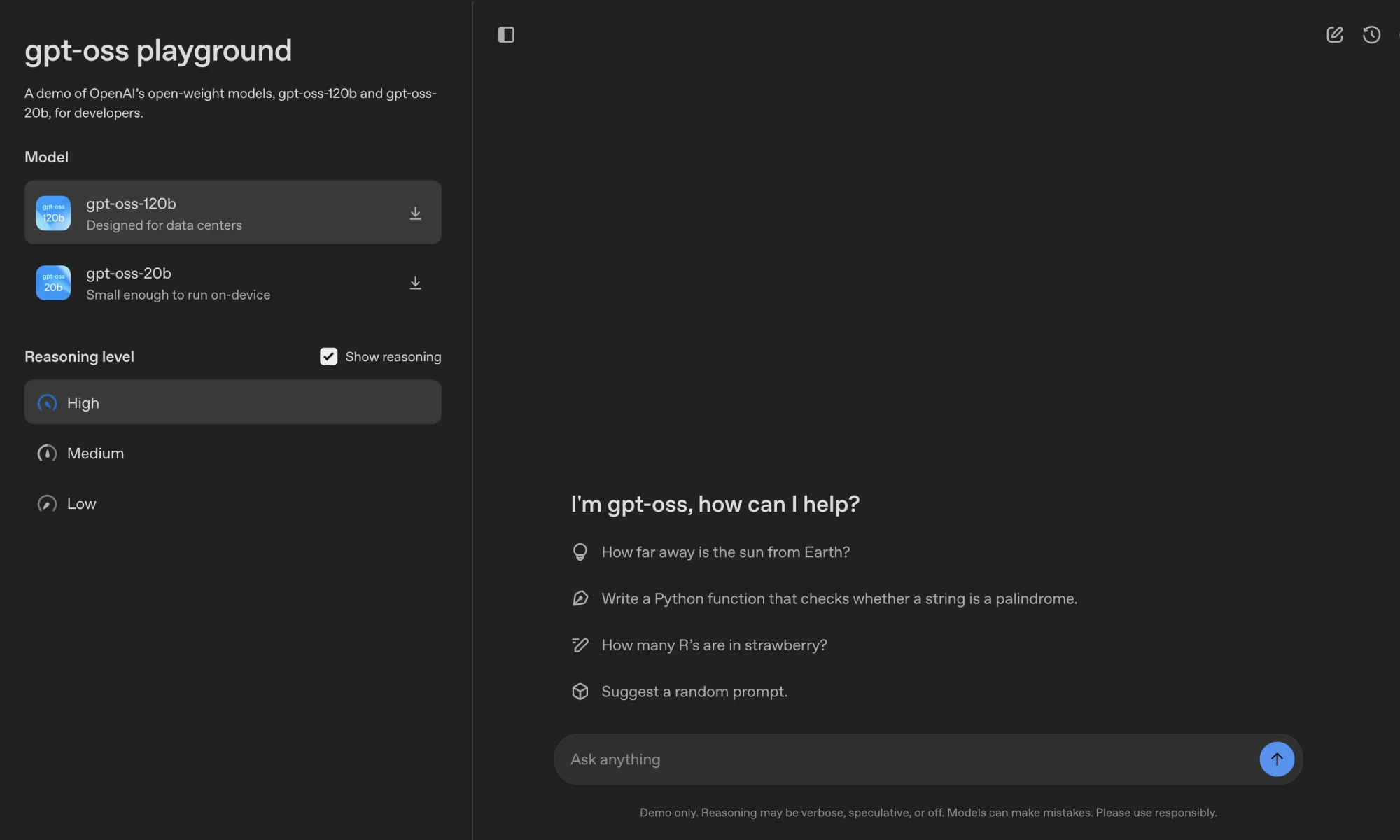

OpenAI Ich betone das.gpt-oss Das Modell ist für intelligente (Agenten-)Arbeitsabläufe mit leistungsstarken Funktionen für die Befehlsverfolgung, den Einsatz von Werkzeugen und Schlussfolgerungen konzipiert. Seine Kernfunktionen umfassen:

- Entwickelt für intelligente KörperaufgabenModelle verfügen über leistungsstarke integrierte Funktionen zur Nutzung von Tools wie Websuche und

PythonCode-Ausführung, was es sehr vielversprechend für die Erstellung komplexer automatisierter Aufgabenabläufe macht. - Tiefgreifend anpassbarBenutzer können die Rückschlussstärke des Modells je nach spezifischen Anwendungsszenarien zwischen niedrig, mittel und hoch einstellen. Gleichzeitig unterstützt das Modell die Feinabstimmung aller Parameter und bietet so maximalen Spielraum für die persönliche Gestaltung.

- Gedankenkette:

OpenAIDurch die Entscheidung, die Denkkette (CoT) dieses Modells nicht direkt zu überwachen, können die Entwickler auf den gesamten Denkprozess des Modells zugreifen. Dies erleichtert nicht nur die Fehlersuche und fördert das Vertrauen in die Ergebnisse des Modells, sondern bietet auch der Forschungsgemeinschaft eine wertvolle Möglichkeit, das Verhalten des Modells zu überwachen und zu untersuchen.

OpenAI Ein einfacher Online-Playground ermöglicht es Entwicklern, die interaktiven Möglichkeiten beider Modelle direkt im Browser zu erleben.

Technische Architektur und Leistung

gpt-oss Die Serie verwendet die gleiche Technologie wie die GPT-3 akin Transformer Architektur und führte die Mixture-of-Experts-Technologie (MoE) ein, um die Effizienz zu verbessern.MoE Die Architektur senkt die Rechenkosten erheblich, da nur einige der für die Bearbeitung der jeweiligen Aufgabe erforderlichen Parameter aktiviert werden.

gpt-oss-120bDas Modell hat insgesamt 117 Milliarden Parameter, aber es ist nicht einfach, jeden dieser Parameter zu verarbeiten. token Zu diesem Zeitpunkt waren nur 5,1 Milliarden Parameter aktiviert.gpt-oss-20bDas Modell hat insgesamt 21 Milliarden Parameter und 3,6 Milliarden aktivierte Parameter.

Beide Modelle unterstützen Kontextlängen von bis zu 128k und verwenden gruppierte Multi-Abfrage-Attention und Rotational Position Embedding (RoPE), um Inferenz und Speichereffizienz zu optimieren.

Details der Modellarchitektur

| Modellierung | Stockwerk | Gesamtparametrierung | Aktive Parameter für jedes Token | Gesamtzahl der Experten | Anzahl der aktiven Experten pro Token | Länge des Kontexts |

|---|---|---|---|---|---|---|

| gpt-oss-120b | 36 | 117b | 5.1b | 128 | 4 | 128k |

| gpt-oss-20b | 24 | 21b | 3.6b | 32 | 4 | 128k |

Was die Leistung betrifft.OpenAI Die veröffentlichten Benchmarking-Daten zeigen gpt-oss Die Leistung ist äußerst wettbewerbsfähig.

Leistungsvergleich der Modelle

| gpt-oss-120b | gpt-oss-20b | OpenAI o3 | OpenAI o4-mini | |

|---|---|---|---|---|

| Vernunft und Wissen | ||||

| MMLU | 90.0 | 85.3 | 93.4 | 93.0 |

| GPQA Diamant | 80.9 | 74.2 | 77.0 | 81.4 |

| Der ultimative Menschentest | 19.0 | 17.3 | 24.9 | 17.7 |

| Wettbewerbsmathematik | ||||

| AIME 2024 | 96.6 | 96.0 | 91.6 | 93.4 |

| AIME 2025 | 97.9 | 98.7 | 88.9 | 92.7 |

Die Daten zeigen, dass das Flaggschiff gpt-oss-120b In einer Reihe von Kerninferenz-Benchmarks ist die Leistung vergleichbar mit der des OpenAI Eigenes Closed-Source-Modell o4-mini Nicht zu übertreffen und sogar noch zu übertreffen in bestimmten Bereichen wie der Wettbewerbsmathematik. Und das Leichtgewicht gpt-oss-20b Seine Leistung ist auch ähnlich wie die des o3-mini vergleichbar oder besser. Diese Leistung macht es nicht nur zu einem theoretischen Kraftpaket, sondern hat auch das Potenzial, die besten Closed-Source-Modelle in praktischen Anwendungen herauszufordern.

Sicherheitsstandards und Ökosysteme

Angesichts des Risikos, dass Open-Source-Modelle für böswillige Zwecke missbraucht werden könnten, hat dieOpenAI Es wurde betont, dass die Sicherheit in den Mittelpunkt gestellt wurde.

OpenAI Verabschiedung des internen Bereitschaftsrahmens für die Feinabstimmung von Gegnern gpt-oss-120b Die Version wurde einer strengen Prüfung unterzogen, die zu dem Ergebnis führte, dass das Modell die Risikostufe "hohe Kapazität" nicht erfüllte. Darüber hinaus.OpenAI Außerdem wurde eine Red Team Testing Challenge mit einem Preisgeld von 500.000 Dollar ins Leben gerufen, um die Community zu ermutigen, gemeinsam potenziellen Sicherheitsproblemen auf den Grund zu gehen.

In Bezug auf die Benutzerfreundlichkeit.OpenAI Zusammenarbeit mit Hugging Face、Azure、AWS und andere Einsatzplattformen, sowie NVIDIA、AMD und anderen Hardware-Anbietern, um sicherzustellen, dass das Modell umfassend und effizient genutzt werden kann.gpt-oss-120b wurde für eine einzelne GPU mit 80 GB RAM quantifiziert, während die gpt-oss-20b Außerdem sind nur 16 GB RAM erforderlich, was die Hürden für Entwickler, lokal auf Consumer-Hardware zu arbeiten und zu experimentieren, drastisch senkt.

Strategische Bedeutung: Ist Offenheit der neue Burggraben?

OpenAI Diese öffentlichkeitswirksame Umarmung von Open Source ist zweifelsohne ein tiefer Einblick in das aktuelle KI-Muster und die strategische Anpassung. In der Vergangenheit hat dieOpenAI etw., auf das man sich verlässt GPT Die Leistungsvorteile einer Reihe von Closed-Source-Modellen haben zu einem großen Erfolg bei der Vermarktung geführt. Allerdings Meta 的 Llama Die Serie beweist, dass ein starkes Open-Source-Modell ein großes und lebendiges Entwickler-Ökosystem hervorbringen kann, das selbst ein mächtiger Graben ist.

Durch die Veröffentlichung eines Wettbewerbs gpt-oss Modelle.OpenAI Es verlangsamt nicht nur den Zustrom von Entwicklern zu den Open-Source-Ökosystemen der Konkurrenten, sondern setzt auch deren eigene Technologie-Stacks (wie das Harmony prompt format) als Industriestandard beworben. Es ist eine Verteidigung und ein Vergehen. Es erlaubt OpenAI in der Lage sein, sowohl auf dem Closed-Source- als auch auf dem Open-Source-Schlachtfeld gleichzeitig zu kämpfen, sowohl durch die API Bieten Sie erstklassige Closed-Source-Modelle an, um Einnahmen zu erzielen, und seien Sie gleichzeitig in der Lage, Gemeinschaften aufzubauen, Talente anzuziehen und neue Geschäftsmöglichkeiten durch Open-Source-Modelle zu erkunden.

Für die gesamte Branche.OpenAI wird den Kampf im Bereich der großen Open-Source-Modelle völlig neu entfachen. Die Entwickler werden mehr hochwertige, anpassbare Optionen haben, und die Standards für Modellleistung und Sicherheit werden in neue Höhen getrieben. Was genau ist das? OpenAI Ob es sich um eine einmalige taktische Verteidigung oder eine grundlegende Änderung der langfristigen Strategie handelt, wird von den weiteren Investitionen und dem Feedback der Community abhängen. In jedem Fall ist die Ära der Offenheit in der KI wirklich angekommen.