Paradigmenwechsel in der 3D-Interaktion

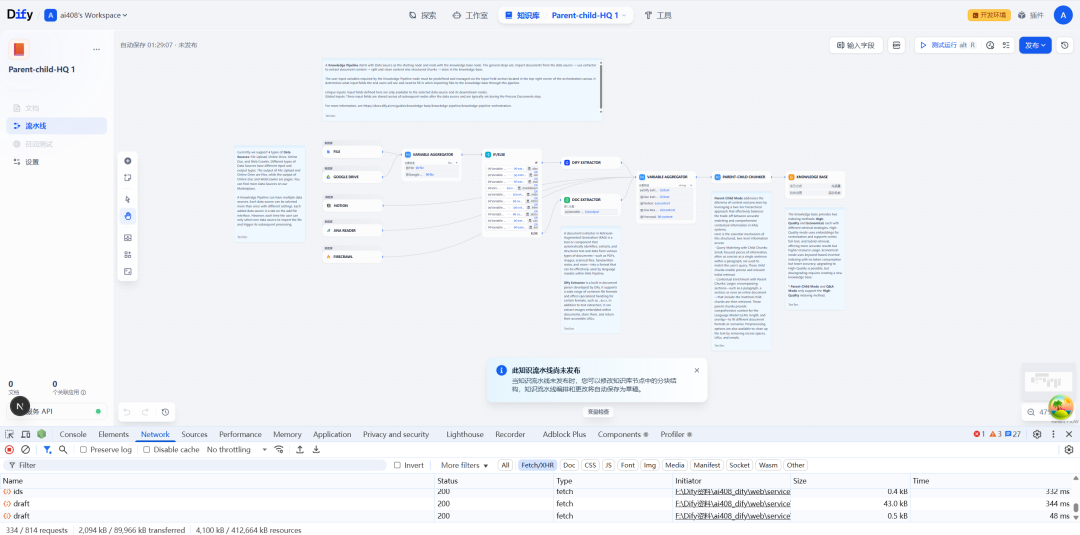

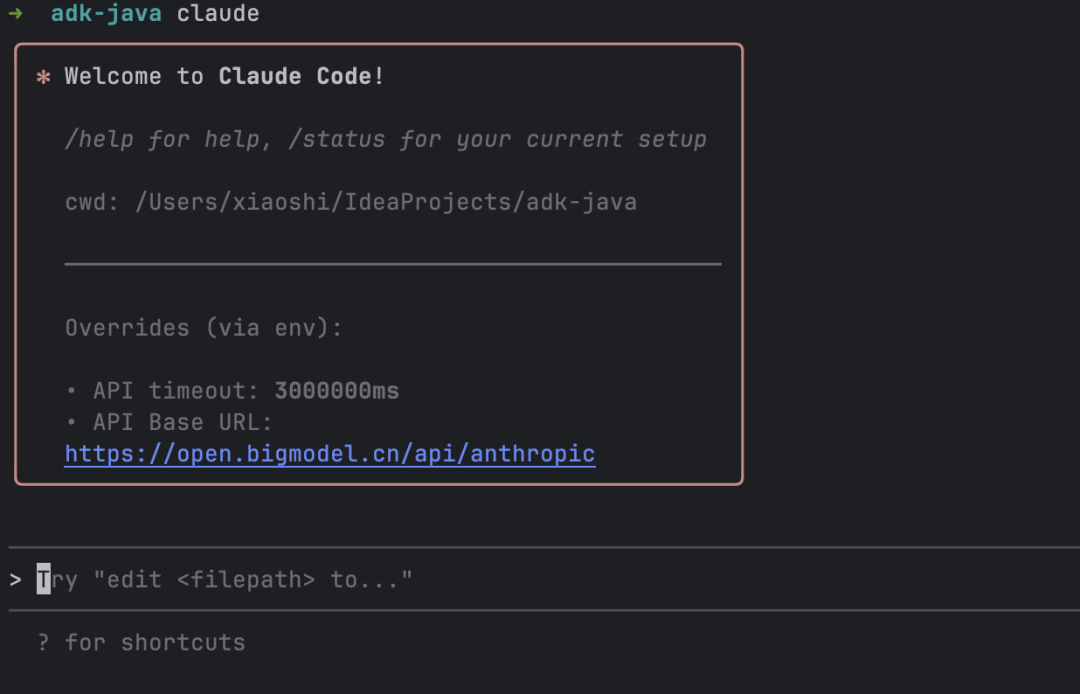

KI-Implementierungsszenarien auf dem Apple Vision Pro geben einen Ausblick auf zukünftige KI-Interaktionsmuster:

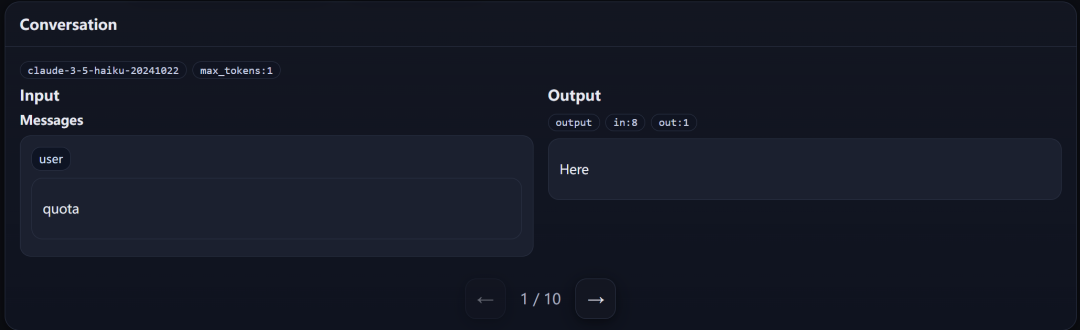

- Weltraum-UI-SystemNutzung der volumetrischen Fensterfunktion von visionOS für die parallele Anzeige von Sprachtranskription, Dokumentenanalyse und KI-Chat mit drei Aufgaben

- Tiefe Integration der GestensteuerungPinch-Gesten lösen direkt die Spracheingabe aus, und das Anhalten des Blicks initiiert das Scannen von Dokumenten für eine intuitive Interaktion mit räumlicher Datenverarbeitung.

- UmweltbewusstseinAnpassung der KI-Reaktionsstrategien in Echtzeit anhand der Sensordaten von Vision Pro, z. B. Erkennung von Konferenzraumumgebungen zur automatischen Aktivierung des Geräuschreduzierungsmodus

Die Entwicklungsprotokolle zeigen, dass diese Version das visuell-verbale multimodale Modell für den R1-Chip optimiert, was zu einer Beschleunigung von 40% bei der Texterkennung in AR-Szenarien führt und einen neuen Maßstab für KI-Tools im Zeitalter des Meta-Universums setzt.

Diese Antwort stammt aus dem ArtikelOn Device AI: AI-Sprachtranskription und Chat-Tool für iPhone Native RunningDie