MedGemma ist eine Reihe von Open-Source-KI-Modellen, die von Google auf der Hugging Face-Plattform veröffentlicht wurden und sich auf das Text- und Bildverständnis im medizinischen Bereich konzentrieren. Es basiert auf Gemma 3 Modellentwicklung zur Unterstützung von Entwicklern bei der Erstellung von KI-Anwendungen im Gesundheitswesen MedGemma bietet mehrere Modellvarianten, darunter ein multimodales Modell mit 4B-Parametern und ein Text- und multimodales Modell mit 27B-Parametern. Diese Modelle wurden speziell für medizinische Texte, elektronische Gesundheitsakten (EHRs) und eine Vielzahl medizinischer Bilder wie Röntgenbilder, dermatologische Bilder, ophthalmologische Bilder und histopathologische Objektträger trainiert. Entwickler können diese Modelle nutzen, um die Entwicklung medizinischer KI-Anwendungen zu beschleunigen, z. B. für die Erstellung von Radiologieberichten, medizinische Fragen und Antworten, Bildklassifizierung usw. Da MedGemma Open Source ist, ist es leicht zugänglich und kann von Forschern und Entwicklern auf einem einzigen Grafikprozessor ausgeführt werden, was die Entwicklungsbarriere senkt.

Funktionsliste

- Medizinische Textverarbeitung: Analysiert und generiert medizinisch relevante Textinhalte wie medizinische Berichte, Frage-Antwort-Paare und elektronische Gesundheitsakten.

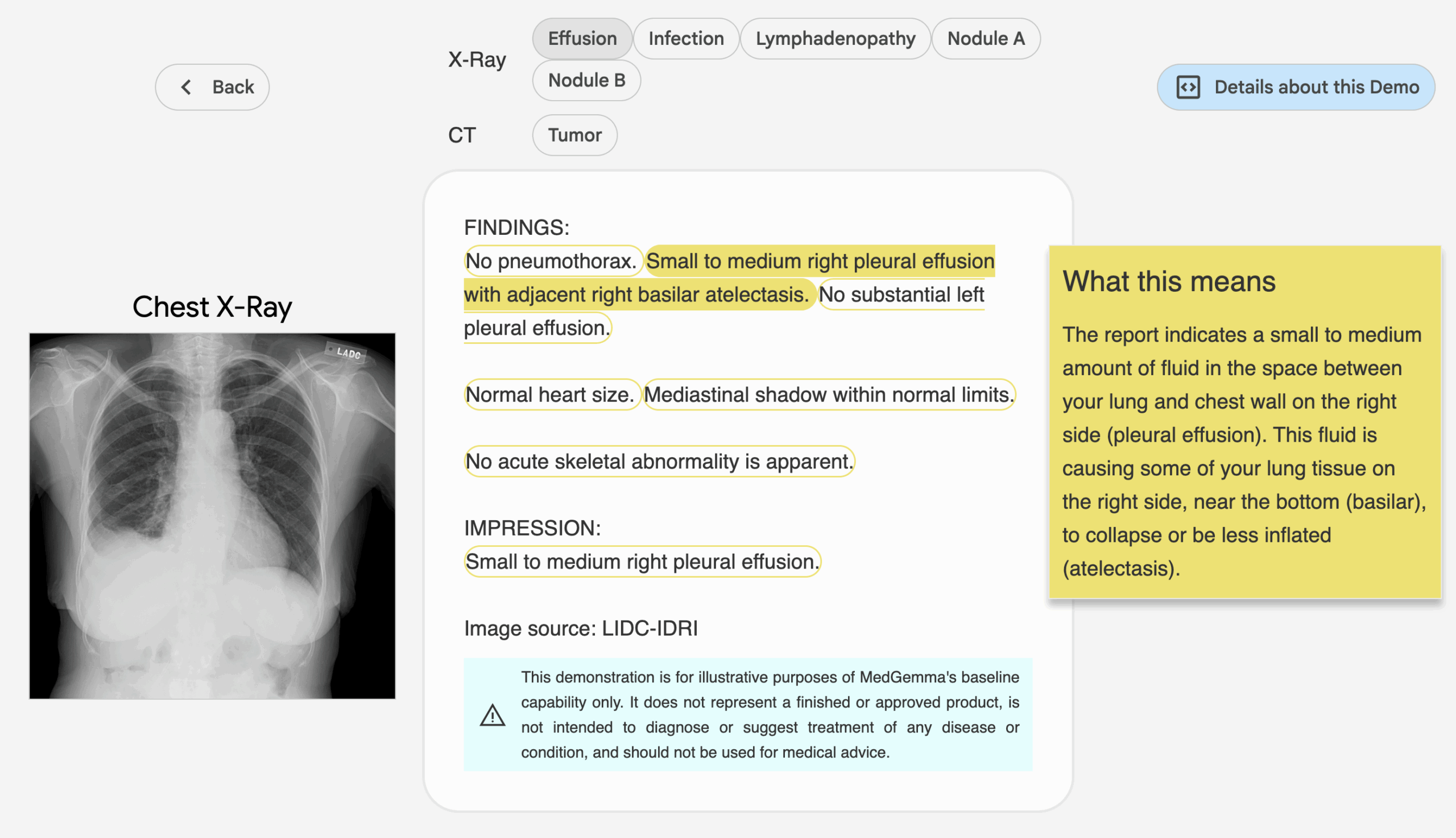

- Medical Image Understanding: Unterstützt die Analyse eines breiten Spektrums medizinischer Bilder, einschließlich Röntgenaufnahmen der Brust, dermatologischer Bilder, ophthalmologischer Bilder und histopathologischer Präparate.

- Multimodales Reasoning: Kombination von Text- und Bilddaten zur Bereitstellung integrierter medizinischer Reasoning-Funktionen, z. B. zur Erstellung von Radiologieberichten oder zur Interpretation von Bildinhalten.

- Auswahl an Modellvarianten: 4B-Parameter-Multimodalmodell (vortrainierte und auf Befehl feinabgestimmte Version) und 27B-Parameter-Text- und Multimodalmodell (nur auf Befehl feinabgestimmte Version) sind verfügbar.

- Effiziente Inferenzoptimierung: Modelle werden so optimiert, dass sie auf einem einzigen Grafikprozessor ausgeführt werden können, was den Bedarf an Rechenressourcen reduziert.

- Quelloffen und fein abstimmbar: Das Modell ist vollständig quelloffen und kann von den Entwicklern fein abgestimmt werden, um die Leistung je nach den spezifischen Anforderungen zu verbessern.

Hilfe verwenden

Installation und Einsatz

Die MedGemma-Modelle werden auf der Hugging Face-Plattform gehostet und können von Entwicklern ohne komplizierte Installation verwendet werden. So funktioniert es:

- Zugang zur Modellseite

zeigen (eine Eintrittskarte)https://huggingface.co/collections/google/medgemma-release-680aade845f90bec6a3f60c4Diese Seite enthält Links zu Downloads und Dokumentation für die parametrischen Modelle 4B und 27B. Die Seite enthält Links zum Herunterladen und zur Dokumentation für die parametrischen Modelle 4B und 27B. - Vorbereitung der Umwelt

- Stellen Sie sicher, dass Python 3.8 oder höher installiert ist.

- Installieren Sie die Transformers-Bibliothek für Hugging Face und führen Sie den folgenden Befehl aus:

pip install transformers - Installieren Sie PyTorch oder TensorFlow (wählen Sie je nach Modellanforderungen). Zum Beispiel, installieren Sie PyTorch:

pip install torch - Wenn Sie Bilddaten verarbeiten, müssen Sie zusätzliche Bibliotheken installieren, wie z.B.

Pillow:pip install Pillow

- Modelle herunterladen

Wählen Sie auf der Seite des Modells Hugging Face die gewünschte MedGemma-Variante (z. B.google/medgemma-4b-it或google/medgemma-27b-multimodal). Verwenden Sie den folgenden Code zum Herunterladen und Laden des Modells:from transformers import AutoModel, AutoTokenizer model_name = "google/medgemma-4b-it" tokenizer = AutoTokenizer.from_pretrained(model_name) model = AutoModel.from_pretrained(model_name)Das Modell 27B benötigt mehr Speicher und es wird ein Grafikprozessor mit mindestens 16 GB Videospeicher empfohlen.

- Betriebsumgebung

MedGemma-Modelle werden auf einer einzelnen GPU für die lokale Entwicklung oder den Cloud-Einsatz unterstützt. Wir empfehlen die Verwendung von Google Cloud oder Hugging Face Inference Endpoints für die Bereitstellung.https://gke-ai-labs.dev/Leitlinien für den Einsatz.

Hauptfunktionen

1. medizinische Textverarbeitung

MedGemma kann medizinische Texte verarbeiten, z. B. Berichte erstellen oder medizinische Fragen beantworten. Die Vorgehensweise ist wie folgt:

- Vorbereitung der Eingabe: Bereiten Sie einen medizinisch relevanten Text vor, z. B. einen Auszug aus einer elektronischen Patientenakte oder eine medizinische Frage.

- Code-Beispiel:

input_text = "患者胸部 X 光显示肺部阴影,可能是什么原因?" inputs = tokenizer(input_text, return_tensors="pt") outputs = model.generate(**inputs, max_length=200) response = tokenizer.decode(outputs[0], skip_special_tokens=True) print(response) - am EndeDas Modell generiert mögliche diagnostische Erklärungen oder Empfehlungen, die auf seinem Training mit medizinischen Texten basieren.

2. medizinisches Bildverständnis

Das multimodale Modell von MedGemma unterstützt die Analyse von medizinischen Bildern (z.B. Röntgenbilder, Hautbilder). Verfahren:

- Vorverarbeitung von BildernKonvertiert das Bild in ein für das Modell akzeptables Format (z. B. PNG oder JPEG).

- Code-Beispiel(4B multimodales Modell als Beispiel):

from PIL import Image import torch image = Image.open("chest_xray.png").convert("RGB") inputs = tokenizer(text="描述这张胸部 X 光图像", images=[image], return_tensors="pt") outputs = model.generate(**inputs, max_length=200) response = tokenizer.decode(outputs[0], skip_special_tokens=True) print(response) - am EndeDas Modell generiert Bildbeschreibungen oder Diagnosevorschläge, wie z. B. "Das Bild zeigt einen Schatten im Unterlappen der rechten Lunge, was auf eine Lungenentzündung hindeuten könnte".

3. multimodale Argumentation

Multimodale Modelle können sowohl Text als auch Bilder verarbeiten. Geben Sie beispielsweise ein Röntgenbild und die Frage "Zeigt dieses Bild Anzeichen einer Lungenentzündung?" ein, und das Modell kombiniert Bild und Text, um eine Antwort zu generieren. Das Modell kombiniert das Bild und den Text, um eine Antwort zu generieren. Der Vorgang ist ähnlich wie der oben beschriebene, nur dass die tokenizer Übergeben Sie sowohl Text als auch Bilder in der

4. die Feinabstimmung des Modells

Der Entwickler kann das Modell für bestimmte Aufgaben fein abstimmen. Die Schritte sind wie folgt:

- Sammlung spezifischer medizinischer Datensätze (z. B. benutzerdefinierte radiologische Bilder oder Texte).

- Hugging Face's verwenden

TrainerAPI für die Feinabstimmung:from transformers import Trainer, TrainingArguments training_args = TrainingArguments( output_dir="./medgemma_finetuned", per_device_train_batch_size=4, num_train_epochs=3, ) trainer = Trainer(model=model, args=training_args, train_dataset=your_dataset) trainer.train() - Speichern Sie das feinabgestimmte Modell zur späteren Verwendung.

caveat

- Risiko der DatenverunreinigungMedGemma kann während des Vortrainings mit öffentlich zugänglichen medizinischen Daten in Berührung gekommen sein, und die Entwickler müssen die Leistung des Modells anhand unveröffentlichter Datensätze validieren, um seine Verallgemeinerungsfähigkeit zu gewährleisten.

- Nicht-klinische VerwendungMedGemma ist nur für Forschungs- und Entwicklungszwecke bestimmt und sollte ohne Validierung nicht für die tatsächliche klinische Diagnose verwendet werden.

- Hardware-VoraussetzungDas 4B-Modell eignet sich für Umgebungen mit geringen Ressourcen, während das 27B-Modell einen leistungsstärkeren Grafikprozessor erfordert.

Anwendungsszenario

- Erstellung von Radiologieberichten

Radiologen können MedGemma nutzen, um Röntgen- oder CT-Bilder zu analysieren und einen vorläufigen Bericht zu erstellen, der sie bei der schnellen Interpretation der Bilder unterstützt. - Medizinisches Frage- und Antwortsystem

Entwickler können medizinische Q&A-Bots erstellen, die die Textverarbeitungsfunktionen von MedGemma nutzen, um allgemeine Fragen von Patienten oder Medizinstudenten zu beantworten. - Analyse der elektronischen Gesundheitsakte

Gesundheitseinrichtungen können das multimodale 27B-Modell nutzen, um komplexe EHR-Daten zu analysieren, Schlüsselinformationen zu extrahieren und Behandlungsprozesse zu optimieren. - Unterstützung der medizinischen Forschung

Forscher können MedGemma zur Analyse medizinischer Literatur oder von Bilddatensätzen verwenden, um den Forschungsprozess zu beschleunigen, z. B. zur dermatologischen Bildklassifizierung oder histopathologischen Analyse.

QA

- Kann MedGemma für eine tatsächliche klinische Diagnose verwendet werden?

Derzeit wird MedGemma nur für Forschung und Entwicklung verwendet und kann ohne klinische Validierung nicht direkt für diagnostische Zwecke eingesetzt werden. Die Entwickler müssen die Zuverlässigkeit des Modells bei spezifischen Aufgaben weiter validieren. - Was ist der Unterschied zwischen dem Modell 27B und dem Modell 4B?

Das 4B-Modell eignet sich für ressourcenarme Umgebungen und unterstützt multimodale und textuelle Aufgaben; das 27B-Modell ist in eine textuelle und eine multimodale Version unterteilt, die leistungsfähiger sind und sich für komplexe Aufgaben eignen, aber mehr Rechenressourcen erfordern. - Wie gehen Sie mit Datenverunreinigungen um?

Validierung der Modelle anhand nicht öffentlicher oder interner institutioneller Datensätze, um zu vermeiden, dass die Verallgemeinerungsfähigkeit durch vorbereitende Daten beeinträchtigt wird. - Welche medizinischen Bilder werden von MedGemma unterstützt?

Unterstützt eine breite Palette medizinischer Bilder wie Röntgenaufnahmen der Brust, dermatologische Bilder, ophthalmologische Bilder und histopathologische Präparate.