Die Technologie der Large Language Modelling (LLM) entwickelt sich rasant, und die Open-Source-Gemeinschaft bringt eine Fülle wertvoller Lernressourcen hervor. Diese Projekte sind eine Fundgrube für Entwickler, die LLM systematisch beherrschen wollen. Dieser Artikel bietet einen detaillierten Blick auf neun Projekte in der GitHub Bei den weithin anerkannten Top-Open-Source-Projekten wird nicht nur der gesamte Prozess von der Theorie bis zur Praxis abgedeckt, sondern es werden auch konkrete Anleitungen zur Code-Implementierung und zum Engineering gegeben, die als solide Leiter auf Ihrem Lernpfad dienen können.

Datawhale-Serie: Systematische Tutorials für chinesische Entwickler

inländisch Datawhale Open-Source-Organisationen haben auf dem Gebiet der Verbreitung von KI-Wissen eine wichtige Rolle gespielt. Sie haben eine Reihe von LLM-Tutorials ins Leben gerufen, die aufgrund ihres systematischen Inhalts, der freundlichen Unterstützung für chinesische Umgebungen und der klaren Lernpfade von einheimischen Entwicklern sehr begrüßt werden.

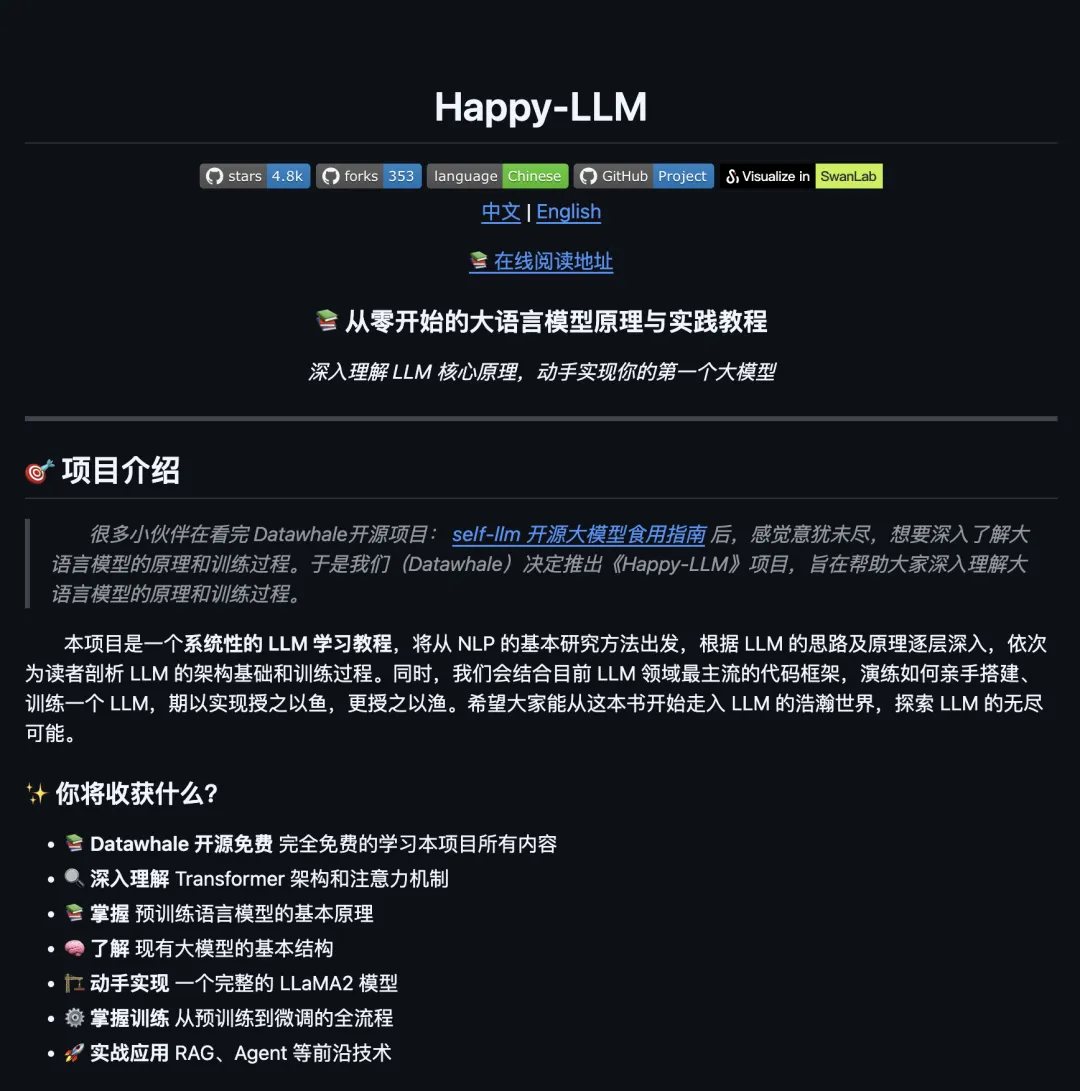

1. happy-LLM: Prinzipien und Praktiken von Null auf Eins

Happy-LLM (5k Stars) ist ein völlig kostenloser, systematischer Lehrgang über die Prinzipien und die Praxis von Large Models, der Entwicklern helfen soll, ein tiefes Verständnis für den Kern von LLM zu erlangen. Der Kurs beginnt mit den grundlegenden Konzepten von NLP und analysiert im Detail die Transformer Architektur und Aufmerksamkeitsmechanismen und bietet einen klaren Überblick über die Grundsätze von Pre-Training-Modellen.

Der wichtigste Aspekt des Programms ist der "praktische" Ansatz. Es führt Sie nicht nur durch den Prozess der PyTorch Implementierung eines kompletten Systems von Grund auf LLaMA2 Modell und umfasst auch die Ausbildung Tokenizer, das Vortraining des Modells und die überwachte Feinabstimmung des gesamten Prozesses. Außerdem umfasst der Kurs eine Übersicht über die RAG(Search Enhanced Generation) und Agent Praktische Vorlesungen über Spitzentechnologien wie z. B.

- Open-Source-Adresse:

https://github.com/datawhalechina/happy-llm

2) LLM-Universum: Entwicklung großer Modellanwendungen für Anfänger

LLM-Universe (8.8k Sterne) ist ein Einführungskurs für Programmieranfänger mit dem Schwerpunkt auf der Anwendung von Big Models. Das Tutorial basiert auf einem repräsentativen Projekt - "Intelligent Q&A Assistant Based on Personal Knowledge Base" - und wird auf AliCloud-Servern geübt.

Der Inhalt des Kurses ist sehr praktisch und deckt den Ruf der wichtigsten in- und ausländischen Großmodelle ab API(z.B.. GPTWenxin Yiyi, Wisdom Spectrum GLM) Methode,Prompt Technische Fähigkeiten, Verwendung LangChain Rahmen, den Aufbau der Vektordatenbank und schließlich die Nutzung der Streamlit Verpackung der Anwendung in eine interaktive Front-End-Schnittstelle.

- Open-Source-Adresse:

https://github.com/datawhalechina/llm-universe

3 Self-LLM: Ein essbarer Leitfaden für die Lokalisierung von Open-Source-Großmodellen

Self-LLM (20k Stars) ist bekannt als der "essbare Leitfaden für große Open-Source-Modelle, die auf chinesische Babys zugeschnitten sind", und sein Hauptziel ist es, das Problem des privaten Einsatzes und der Feinabstimmung von Open-Source-Modellen in der heimischen Umgebung zu lösen. Dieses Projekt ist wertvoll für Entwickler, denen der Datenschutz und die Modellanpassung wichtig sind.

Es bietet die Möglichkeit, die Linux Umweltauswirkungen LLaMA、ChatGLM、Qwen(Tausende von Fragen),InternLM(Shusheng-Puyin) und Dutzende anderer in- und ausländischer Mainstream-Modelle für den lokalen Einsatz, die Feinabstimmung aller Parameter und die LoRA Ausführliche Schritte für eine effiziente Feinabstimmung. Darüber hinaus erstreckt sich das Tutorial auf den Einsatz von großen multimodalen Modellen.

- Open-Source-Adresse:

https://github.com/datawhalechina/self-llm

4 LLM-Kochbuch: Eine praktische chinesische Version des Wu-Enda-Kurses

LLM Cookbook (20,2k Sterne) ist eine praxisorientierte chinesische Version, die auf einer Reihe von Big Model-Kursen von Professor Ernest Ng basiert. Es destilliert und lokalisiert die Kernideen des ursprünglichen Kurses und deckt Folgendes ab Prompt Technik,RAG Entwicklung, Modellfeinabstimmung und andere wichtige Aspekte.

Eine Besonderheit dieses Programms ist das Angebot von zweisprachigen Chinesisch- und Englischkursen, die den ursprünglichen Lehrplan ergänzen. Jupyter Notebook Code und für die Bedürfnisse inländischer Entwickler, insbesondere optimiert für chinesische Prompt Design und API Aufforderungsmethoden. Der Kurs ist in einen "obligatorischen" und einen "fakultativen" Teil gegliedert, so dass die Lernenden je nach ihren eigenen Voraussetzungen Schritt für Schritt vorankommen können.

- Open-Source-Adresse:

https://github.com/datawhalechina/llm-cookbook

Ingenieurwesen und vertiefte Praxis

Nach der Beherrschung der Theorie geht es darum, das Modell in die tatsächliche Produktion zu überführen. Die folgenden Projekte konzentrieren sich auf die wichtigsten technischen Herausforderungen während des Lebenszyklus eines großen Modells.

5 LLM-Action: Entwicklung und Umsetzung von Modellen in großem Maßstab

LLM-Action (19k Stars) ist ein Projekt zur gemeinsamen Nutzung von Technologien, das sich auf die Entwicklung großer Modelle und die Implementierung von Anwendungen konzentriert. Es ist nicht so einfach wie ein einführendes Tutorial, sondern geht auf spezifische technische Details wie Modelltraining, Inferenz, Kompression und Sicherheit ein.

Ihr Inhalt kann als eine riesige Fundgrube für technisches Wissen angesehen werden:

- Zug:

LoRA、QLoRA、P-TuningEffiziente Feinabstimmungstechniken für Iso-Parameter und verteiltes Training. - Optimierung der Argumentation: Eingehende Erklärung

TensorRT-LLM、vLLMund anderen branchenüblichen Inferenzsystemen. - Modell Kompression: Eine systematische Einführung in Techniken wie Modellquantifizierung, Pruning und Wissensdestillation.

- Anpassung für die LokalisierungErfahrung mit der Anpassung inländischer Hardware-Plattformen wie Huawei Rising.

- Open-Source-Adresse:

https://github.com/liguodongiot/llm-action

6. das AI Engineering Hub: eine Sammlung von KI-Anwendungen aus der Praxis

AI Engineering Hub (13.2k Sterne) ist eine reichhaltige Sammlung von detaillierten Tutorials und praktischen Beispielen, die sich auf das Konzept der "realitätsnahen AI Anwendungen". Anstatt über vage Theorien zu sprechen, bietet dieses Projekt eine große Anzahl von Codebeispielen, die direkt unterwegs geändert und ausgeführt werden können.

Sie dreht sich um DeepSeek、Llama、Gemma und andere beliebte Open-Source-Modelle, die eine breite Palette von Modellen bieten, darunter RAGviele Agent Zusammenarbeit, multimodale Anwendungen und viele andere Lösungen. Das Projekt hat die wichtigsten Tutorials in einem über 500-seitigen Dokument zusammengefasst PDF Das Dokument ist wie ein detailliertes "Betriebshandbuch" und hat einen hohen Sammlerwert.

- Open-Source-Adresse:

https://github.com/patchy631/ai-engineering-hub

Refactoring von Grund auf: ein tieferes Verständnis der Modellgrundlagen

Um einen echten Einblick in die Funktionsweise von LLM zu erhalten, geht nichts über die Implementierung eines Modells von Grund auf.

7. die Replikation von MiniMind: zwei Stunden Schulung ausschließlich für MiniGPT.

MiniMind (22.6k Sterne) ist ein phänomenales Open-Source-Projekt, das uns beweist, dass gewöhnliche Entwickler ihre eigene Software von Grund auf neu entwickeln können. GPTMit Hilfe dieses Projekts. Mit Hilfe dieses Projekts kann nur ein Teil der NVIDIA 3090 Grafikkarte, dauert es etwa 2 Stunden, um ein ultraleichtes, nur 26 MB großes GPT Modelle.

Dieses Projekt ist wertvoll, weil es die nativen PyTorch umstrukturiert Transformer Decoder, Drehlagekodierung (RoPE)、SwiGLU Alle Kernalgorithmen, wie z.B. die Aktivierungsfunktionen, haben hochgradig gekapselte Schnittstellen, die nicht auf Bibliotheken von Drittanbietern angewiesen sind. Es reproduziert vollständig alle Kernalgorithmen vom Pre-Training über die überwachte Feinabstimmung (SFT)、LoRA Anpassung, an DPO(Der industrialisierte Prozess der (direkten Präferenzoptimierung) Ausrichtung ist ein ausgezeichnetes Lehrbuch, um ein tieferes Verständnis der zugrunde liegenden Details des LLM zu erlangen.

- Open-Source-Adresse:

https://github.com/jingyaogong/minimind

Internationale Perspektive: maßgebliche Programme von führenden Institutionen und Experten

Und schließlich bieten Open-Source-Kurse von internationalen Spitzenforschern und Tech-Giganten eine maßgebliche und hochmoderne Perspektive für das LLM-Lernen.

8 LLM-Kurs: Der Weg zum LLM-Wissenschaftler

由 Maxime Labonne erstellt LLM Course (56,5k Sterne) ist ein umfassendes Programm für fortgeschrittene Lernende. Es unterteilt den Lernpfad klar in LLM Stiftung,LLM Wissenschaftler und LLM Die drei Hauptbestandteile des Ingenieurs.

Das Programm bietet eine breite Palette von Kursen, die direkt in den folgenden Bereichen belegt werden können Google Colab läuft NotebookDer Inhalt umfasst die Verwendung von QLoRA / DPO Feinabstimmung des Modells durchführen,GGUF / GPTQ Quantifizierung und die Verwendung von mergekit Fortgeschrittene Themen wie das Zusammenführen von Modellen. Außerdem bietet es Funktionen wie AutoQuant、LazyMergekit und andere automatisierte Tools, die den Entwicklern helfen, die Modelloptimierung effizient durchzuführen.

- Open-Source-Adresse:

https://github.com/mlabonne/llm-course

9. generative KI für Einsteiger: Das ultimative Einführungs-Tutorial von Microsoft

Generative AI for Beginners (87,5k Sterne) besteht aus Microsoft Der offizielle Einführungskurs in generative KI ist von extrem hoher Qualität und eignet sich perfekt für Entwickler ohne Vorkenntnisse. Dieser Kurs enthält 21 gut gestaltete Lektionen, die alles von Prompt Technische Grundlagen, Vincennes-Gebäudeanwendungen, Integration RAG 与 Agent und andere zentrale Wissenspunkte.

Der Kurs bietet Python 和 TypeScript Codebeispiele, mit besonderem Schwerpunkt auf "verantwortungsvoller KI" (Responsible AI) zu diesem wichtigen Thema. Sie beschreibt auch, wie man Gradio Low-Code-Tools, wie die schnelle Erstellung von Anwendungsprototypen, senken die Lernschwelle erheblich.

- Open-Source-Adresse:

https://github.com/microsoft/generative-ai-for-beginners