Obwohl GLM-4.5 über multimodale Verarbeitungsmöglichkeiten für Text und Bilder verfügt, gibt es die folgenden Einschränkungen:

- MedienartDerzeit werden nur statische Bilder (JPEG/PNG usw.) und PDF-Parsing unterstützt, keine Videoverarbeitung.

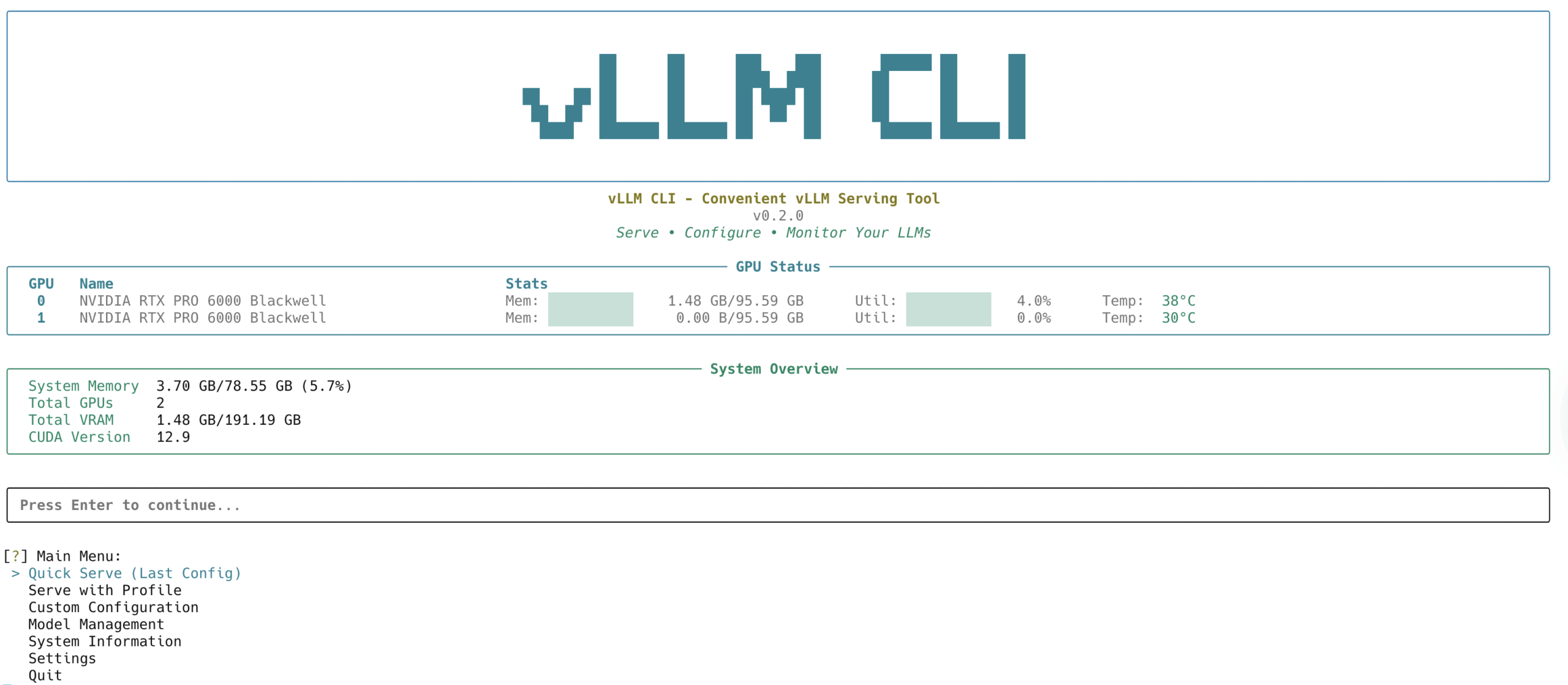

- GleichzeitigkeitsgrenzeDie vLLM-API verarbeitet bis zu 300 Bilder in einer einzigen Anfrage.

- grafisches VerständnisGeringere Genauigkeit als spezielle CV-Modelle bei komplexen visuellen Aufgaben (z. B. Objekterkennung)

- cross-modale Assoziation:: Die grafischen und textuellen Möglichkeiten des Joint Reasoning (z. B. die Erstellung von Analysen auf der Grundlage von Grafiken) werden noch optimiert.

Vorschläge für praktische Anwendungen: für Szenen wie Foto-Analyse von mathematischen Problemen, mit strukturierter Ausgabe (format="json") können bessere Ergebnisse zu erhalten; mit professionellen Bildverarbeitung sollte mit OpenCV und anderen speziellen Bibliotheken kombiniert werden.

Diese Antwort stammt aus dem ArtikelGLM-4.5: Open Source Multimodale Großmodelle zur Unterstützung intelligenter Schlussfolgerungen und CodegenerierungDie