Entwickelt seit Peter Steinberger OpenClaw(Seit dem Aufkommen des KI-Krebses hat sich im Bereich der KI ein Paradigmenwechsel vom Chatbot zum KI-Agenten vollzogen. Ein Paradigmenwechsel vom “Chatbot” zum “KI-Agenten”. Im Gegensatz zu reinem Text ChatGPT Im Gegensatz zu OpenClaw haben Agenten wie OpenClaw “ausführende Befugnisse” - sie können Computer bedienen, Code schreiben und mit allen Arten von Software interagieren, genau wie Menschen.

Die ersten Implementierungen von OpenClaw basierten jedoch häufig auf komplexen Befehlszeilenschnittstellen (CLIs), und diese schwarz auf grün dargestellten Terminalfenster hielten viele Gelegenheitsnutzer davon ab, es auszuprobieren. Die gute Nachricht ist, dass mit Cherry Studio Mit der Veröffentlichung von Version 1.7.17 wurde diese Schwelle vollständig überwunden. Die Open-Source-Plattform, die KI-Programmierung, Multi-Modell-Dialog und Wissensdatenbank-Management integriert, ermöglicht es den Nutzern jetzt, OpenClaw mit einem Klick über eine grafische Oberfläche zu installieren und auszuführen.

Mit der Ankündigung von Peter Steinberger, dass er bei OpenAI einsteigt und die Entwicklung der nächsten Generation von Agenten vorantreibt, gab es nie einen besseren Zeitpunkt, um einen Vorgeschmack auf diese Zukunftstechnologie zu bekommen. In diesem Artikel zeigen wir am Beispiel von Windows, wie man OpenAI in der Cherry Studio Setzen Sie Ihren ersten “AI Crayfish” ein und konfigurieren Sie ein kostenloses Hochleistungsmodell, damit es funktioniert.

Vorbereitung des Kernwerkzeugs: Cherry Studio

Cherry Studio ist im Wesentlichen ein leistungsstarker Container für die KI-Entwicklung und den Dialog. Für erfahrene Spieler ist es eine Konsole, die alle Arten von LLM-APIs zusammenfasst; für Neueinsteiger ist es eine Abkürzung zu einem lokalen KI-Agenten.

Um OpenClaw auszuführen, vergewissern Sie sich zunächst, dass sich Ihre Version von Cherry Studio im v1.7.17 und darüber.

- Download-Adresse: Cherry Studio offizielle Website

Tipps zur SicherheitOpenClaw ist ein Agent, der lokal mit Systemprivilegien ausgeführt wird. Obwohl Cherry Studio einen Wrapper bereitstellt, wird empfohlen, solche “ausführungsfähigen” KI-Programme aus Gründen der Datensicherheit auf Computern in Nicht-Produktionsumgebungen, virtuellen Maschinen (VMs) oder Sandbox-Umgebungen auszuführen. Programm.

Phase 1: Ein-Klick-Installation der OpenClaw-Umgebung

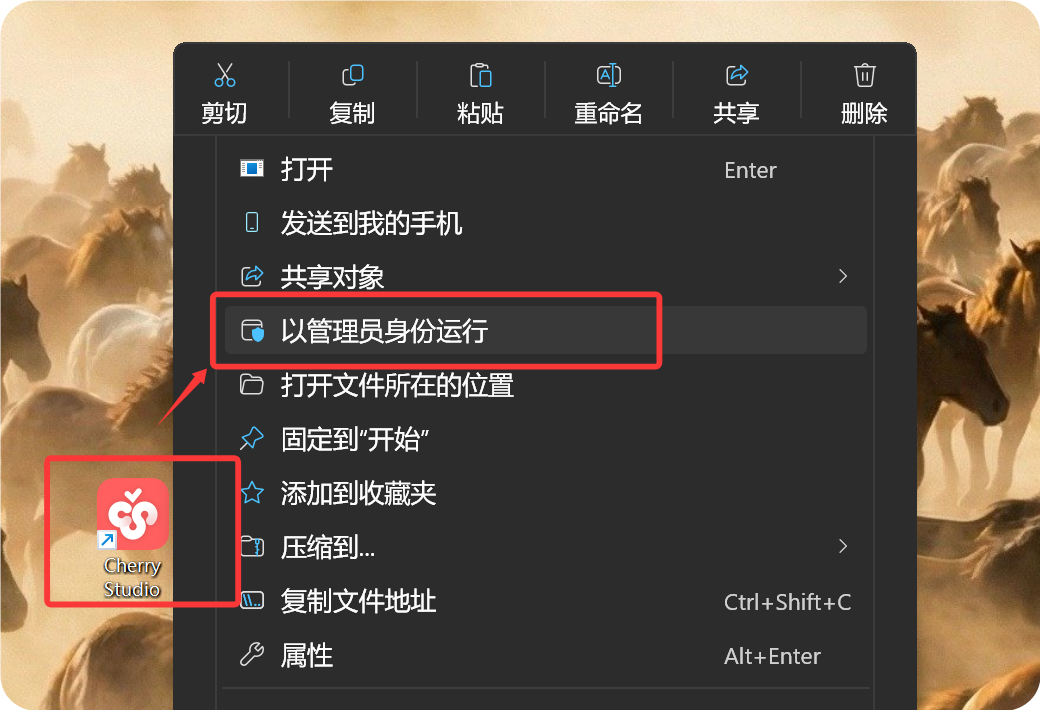

Die Stärke von Cherry Studio ist seine “Out-of-the-Box”-Erfahrung. Einmal installiert und als Administrator ausgeführt, müssen Sie keine komplexen Python-Umgebungen oder Docker-Container manuell konfigurieren.

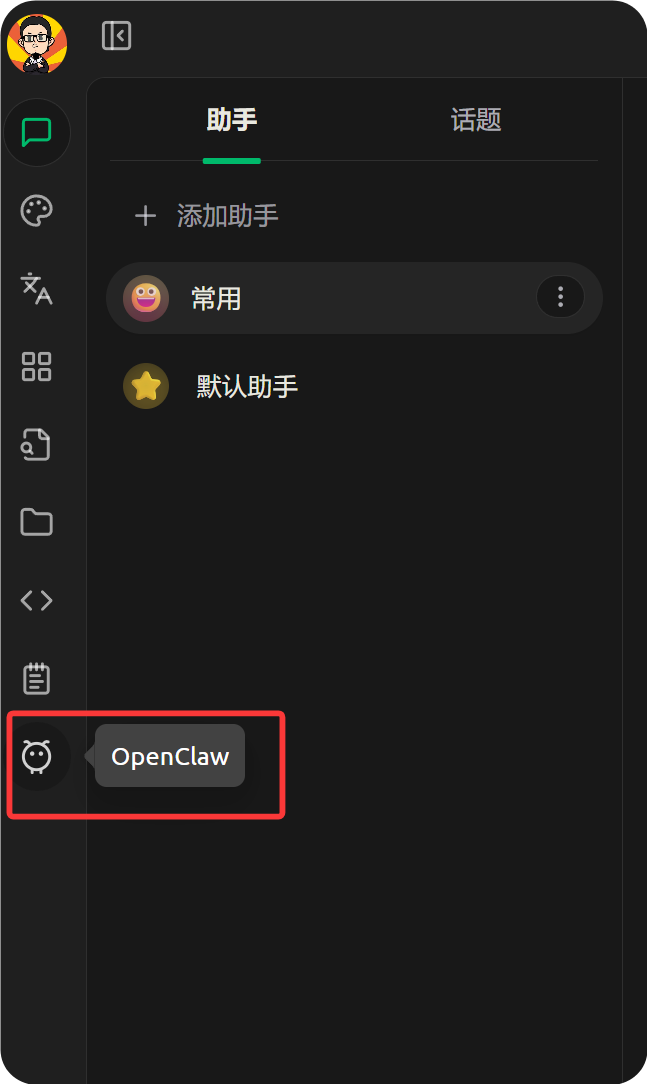

- Zugang zum Agentenzentrum:

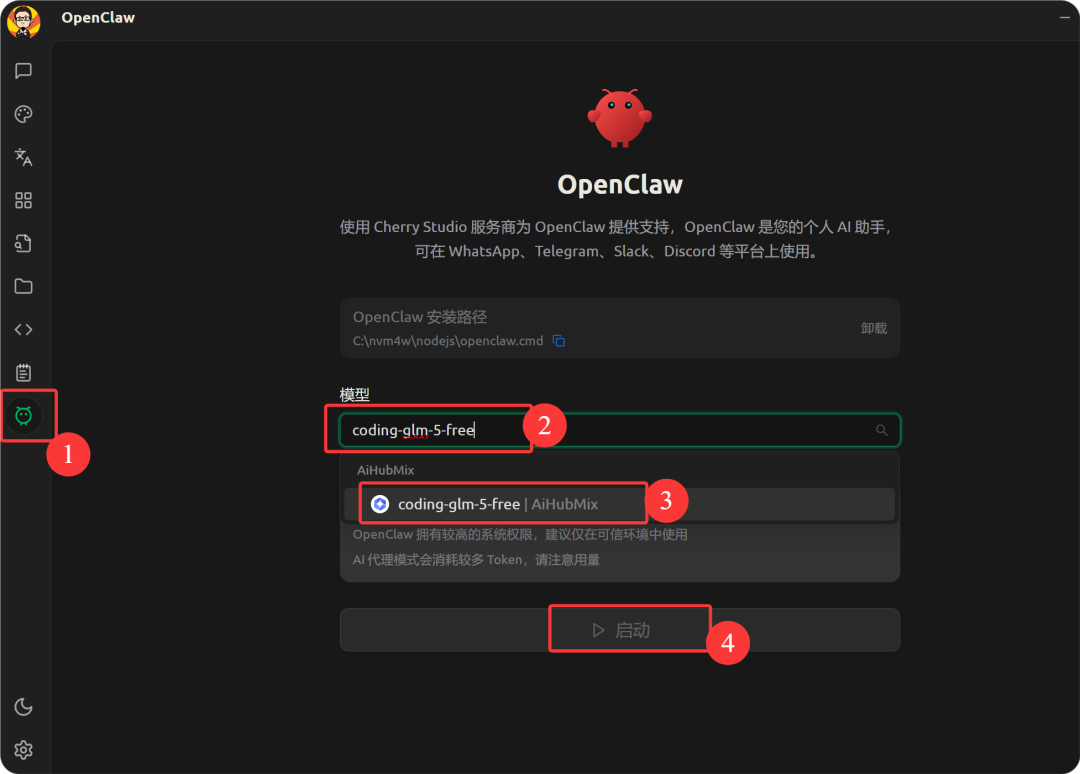

Öffnen Sie das Symbol “Crayfish” unten im Menü auf der linken Seite der Software (Eintrag OpenClaw).

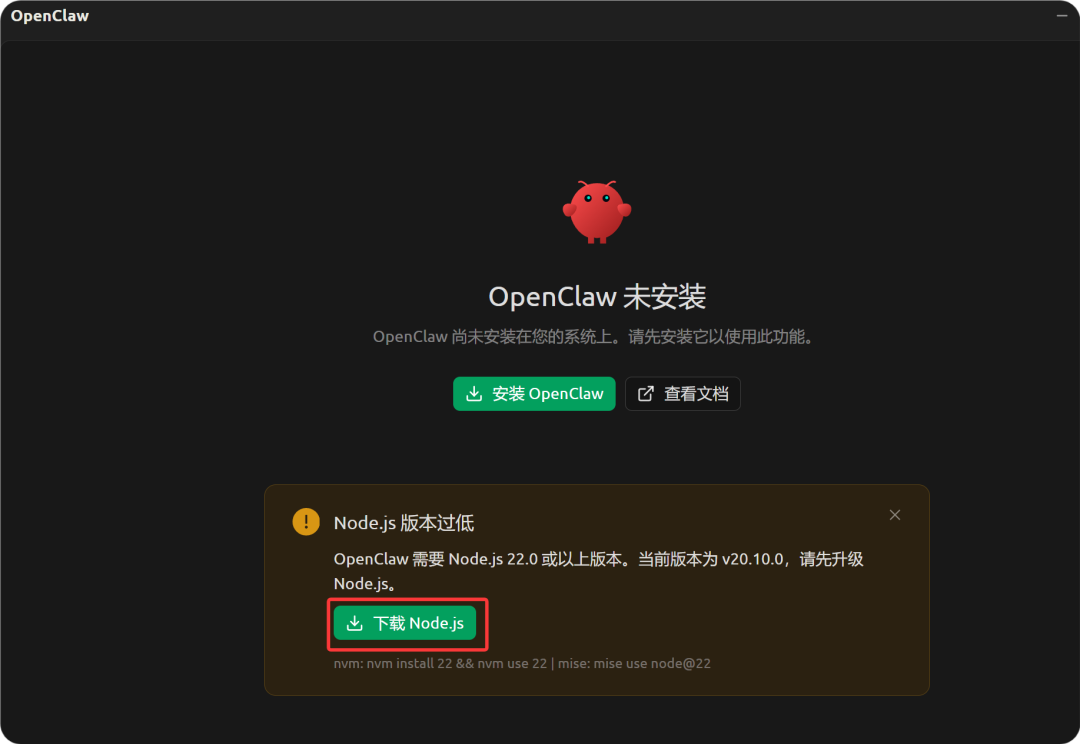

- Selbsttest der Umgebung und Installation von Abhängigkeiten:

Das System erkennt automatisch die lokale Umgebung. Node.js (v22.0+ empfohlen). Wenn es auf Ihrem Computer noch nicht installiert ist, finden Sie in Cherry Studio eine direkte Anleitung zum Herunterladen des Programms.

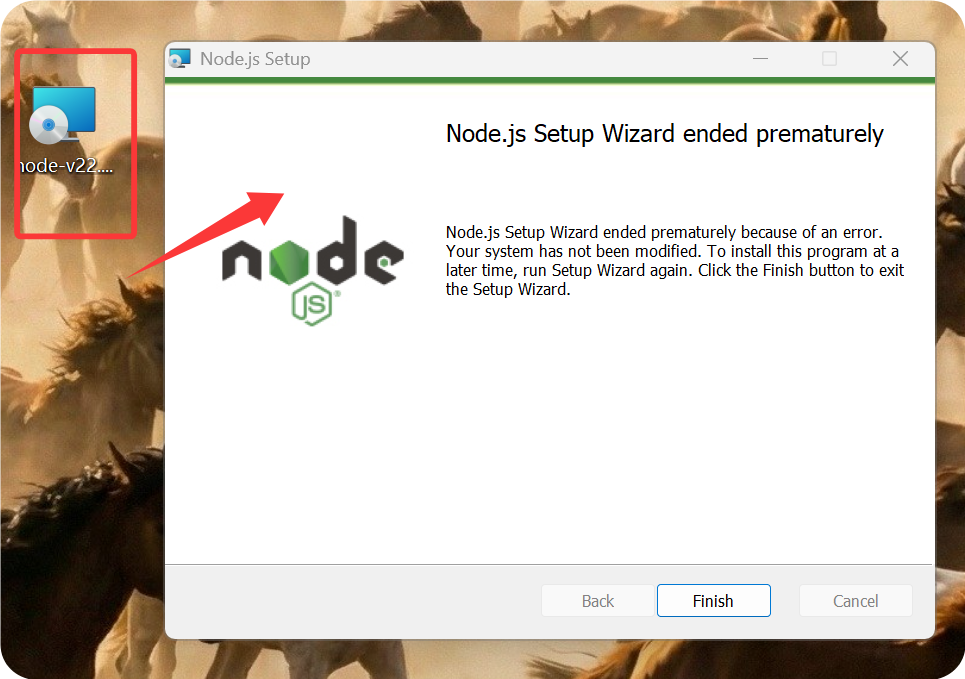

Nachdem Sie das Node.js-Installationsprogramm heruntergeladen haben, lassen Sie einfach die Standardoptionen stehen, um die Installation abzuschließen. Dies ist die Basis-Engine für OpenClaw, um logische Entscheidungen und die Codeausführung im Hintergrund durchzuführen.

- Durchführung der Installation:

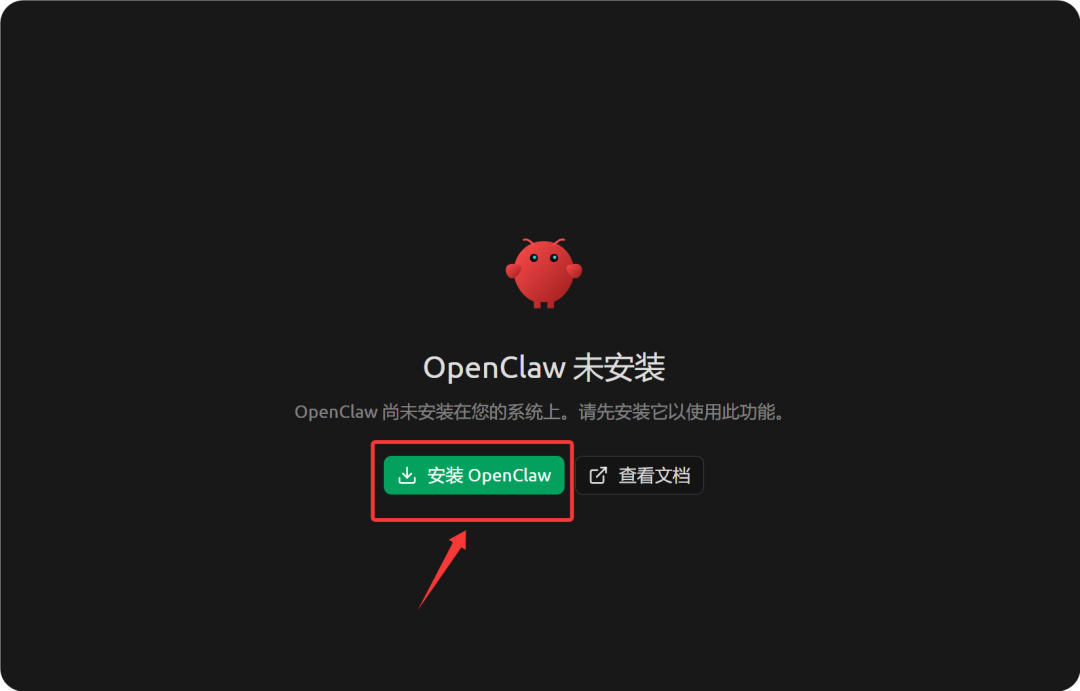

Sobald die Umgebung fertig ist, gehen Sie zurück zu Cherry Studio und klicken Sie auf die Schaltfläche “Installieren”.

Tipps zur Installation:

- Wenn Sie die Installation zum ersten Mal auf einem makellosen System vornehmen, verläuft sie in der Regel problemlos.

- Wenn es mehrere Versionen von Node.js auf Ihrem System gibt (z. B. in einer Entwicklerumgebung), können Versionskonflikte auftreten. In diesem Fall empfiehlt es sich, die

nvm(Node Version Manager), um zwischen den Versionen zu wechseln, oder direkt in einer unberührten virtuellen Maschine einzusetzen.

Wenn Sie den folgenden Bildschirm sehen, wurde OpenClaw erfolgreich in Ihr Cherry Studio implantiert.

Phase 2: Konfigurieren Sie die Modellebene (holen Sie sich die kostenlose API)

OpenClaw ist nur der “Körper”, er braucht Zugang zu einem Large Language Model (LLM) als “Gehirn”, um zu denken. Wir könnten ein lokales Modell (wie Ollama) verwenden, aber auf Geräten mit Leistungseinschränkungen ist eine Cloud-API die bessere Lösung.

Wir empfehlen hier die Verwendung von Zeitalter der Vernunft (AiHubMix) Der bereitgestellte Aggregations-API-Dienst bietet Zugangsschnittstellen zu den gängigen Modellen, einschließlich GPT-4, GLM-5 usw., und verfügt über eine gewisse kostenlose Unterstützung für Entwickler.

- Abrufen des API-Schlüssels:

Besuchen Sie die Age of Reasoning-Website (aihubmix.com) und registrieren Sie sich für ein Konto, um Ihre Standardguthaben für API-Aufrufe zu erhalten.- kostenlose StrategieDie Palette der auf der Plattform verfügbaren kostenlosen Modelle umfasst

coding-glm-5-free(für die Codierung geeignet),Gemini 3 Flashusw. - TempolimitDie Modelle der Domestic-Serie sind in der Regel auf 5 RPM (5 Anfragen pro Minute) / 500 RPD (500 Anfragen pro Tag) begrenzt, was für persönliche Tests und einfache Agenteninteraktionen ausreichend ist.

Bitte holen Sie Ihre

sk-xxxxxxxxFormat (API-Schlüssel). - kostenlose StrategieDie Palette der auf der Plattform verfügbaren kostenlosen Modelle umfasst

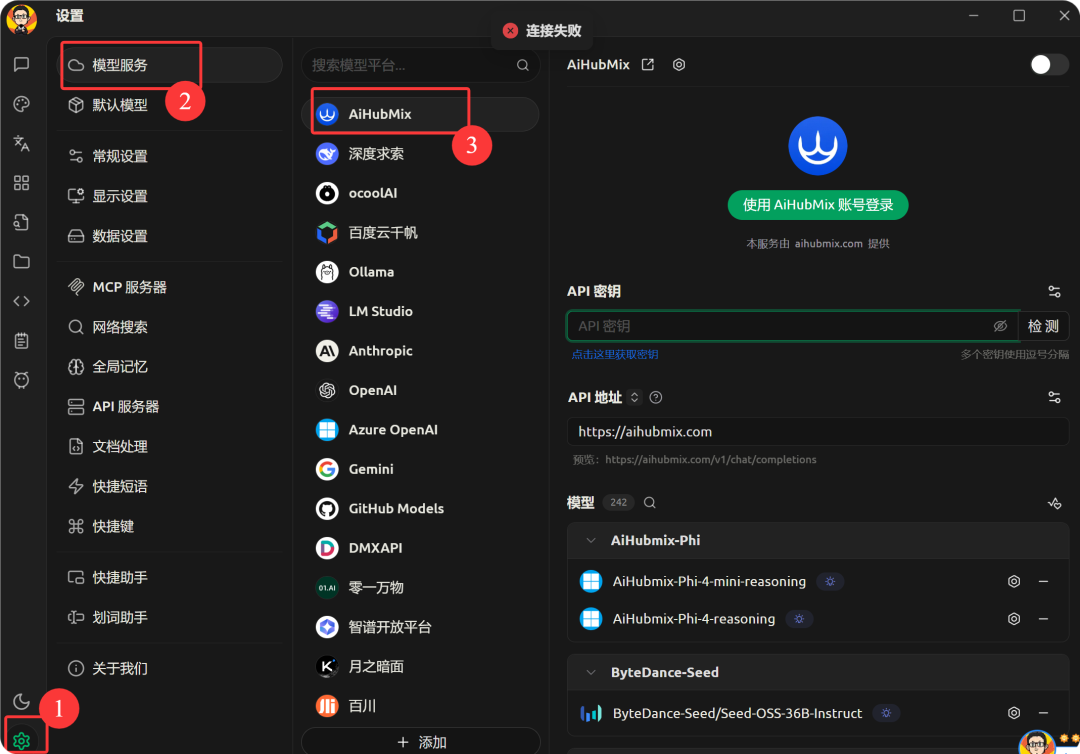

- Andockdienste im Cherry Studio:

Klicken Sie auf das Zahnradsymbol in der unteren linken Ecke der Software, um dieaufstellenWenn Sie in der Liste “Model Services” suchen oder suchen wollen, können Sie dies tun, indem Sie auf die Schaltfläche "Model Services" klicken. AiHubMix。

- API-AdresseDas System wird in der Regel automatisch vorausgefüllt (https://aihubmix.com).

- API-SchlüsselEinfügen des Schlüssels, den Sie gerade erhalten haben.

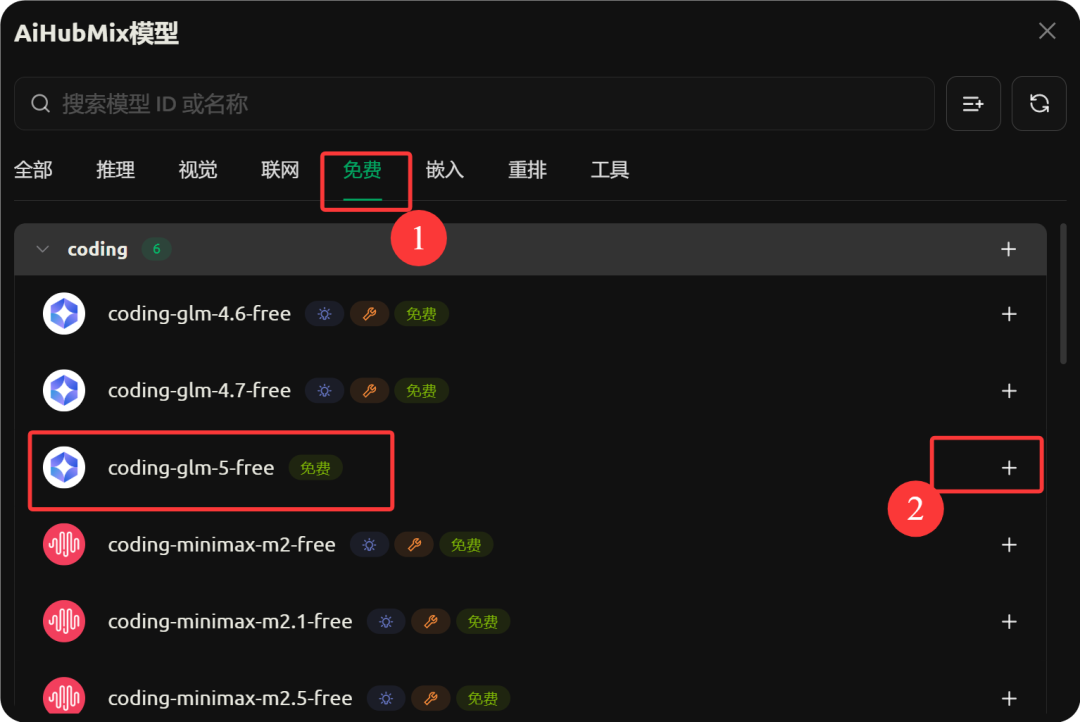

- Filtern und Hinzufügen bestimmter Modelle:

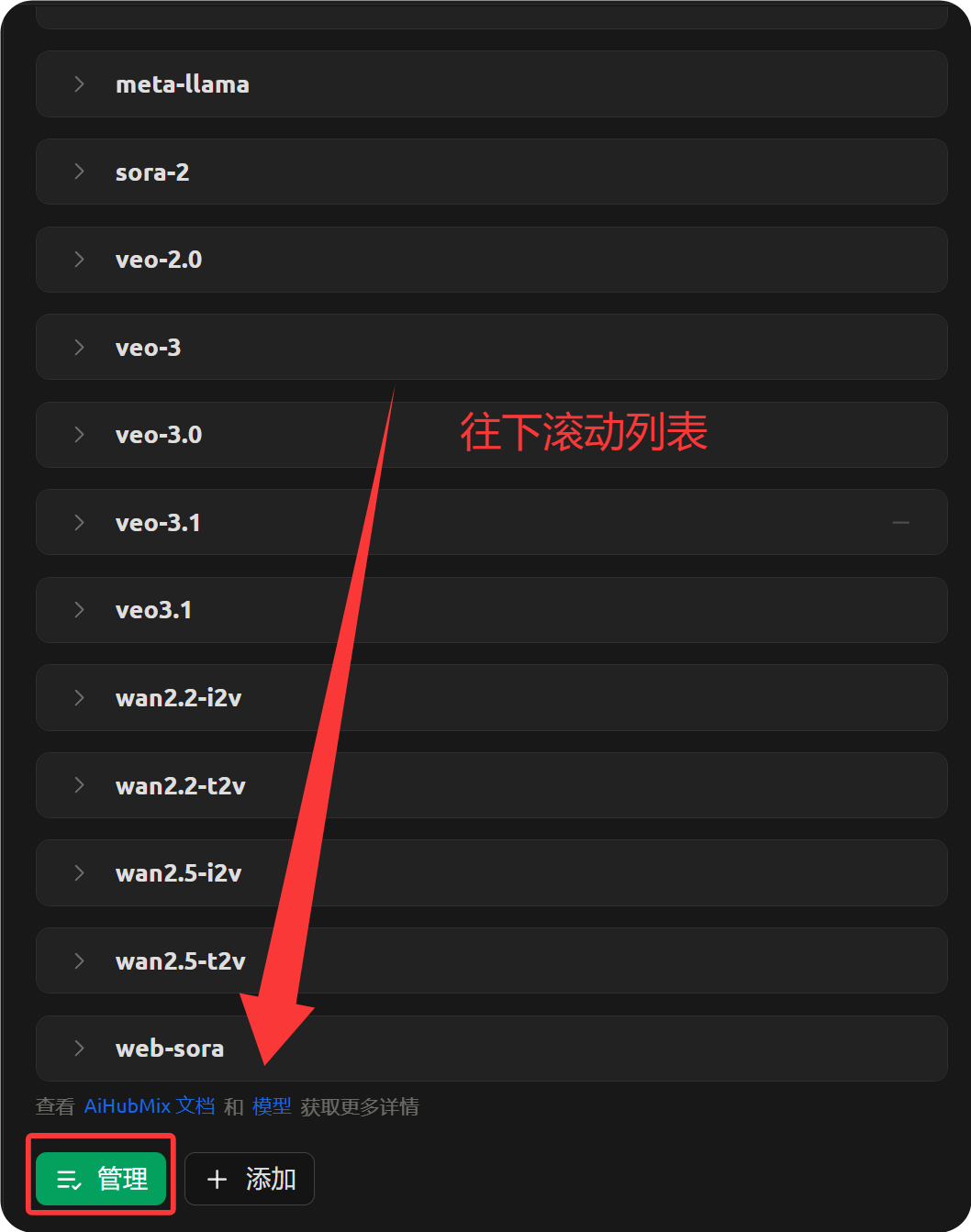

Schalten Sie den “Service Provider Switch” in der oberen rechten Ecke ein (wird grün), und klicken Sie dann auf die Schaltfläche “Verwalten” am unteren Rand.

In der Modellverwaltungsoberfläche wird empfohlen, die überflüssigen bezahlten Modelle zu löschen, um Missbrauch zu vermeiden. Gehen Sie zur Kategorie “Frei”, fügen Sie

coding-glm-5-freeDies ist von entscheidender Bedeutung, da OpenClaw bei der Ausführung von Aufgaben eine Menge Token verbraucht. Dies ist von entscheidender Bedeutung, da OpenClaw bei der Durchführung von Aufgaben eine Menge Token verbraucht und die Verwendung eines kostenlosen, für den Code optimierten Modells die Kosten für Versuch und Irrtum erheblich reduziert.

- Prüfung der Konnektivität:

Klicken Sie rechts neben dem API-Schlüssel auf “Erkennen” und geben Siecoding-glm-5-freeFühren Sie den Handshake-Test durch. Eine “erfolgreiche Verbindung” bedeutet, dass eine neuronale Verbindung zwischen dem Gehirn und dem Körper hergestellt worden ist.

Phase III: Initiierung und Interaktion

Gehen Sie zurück zur OpenClaw-Schnittstelle und geben Sie im Feld Modellauswahl das gerade konfigurierte Modell an coding-glm-5-freeKlicken Sie aufaktivieren (einen Plan)。

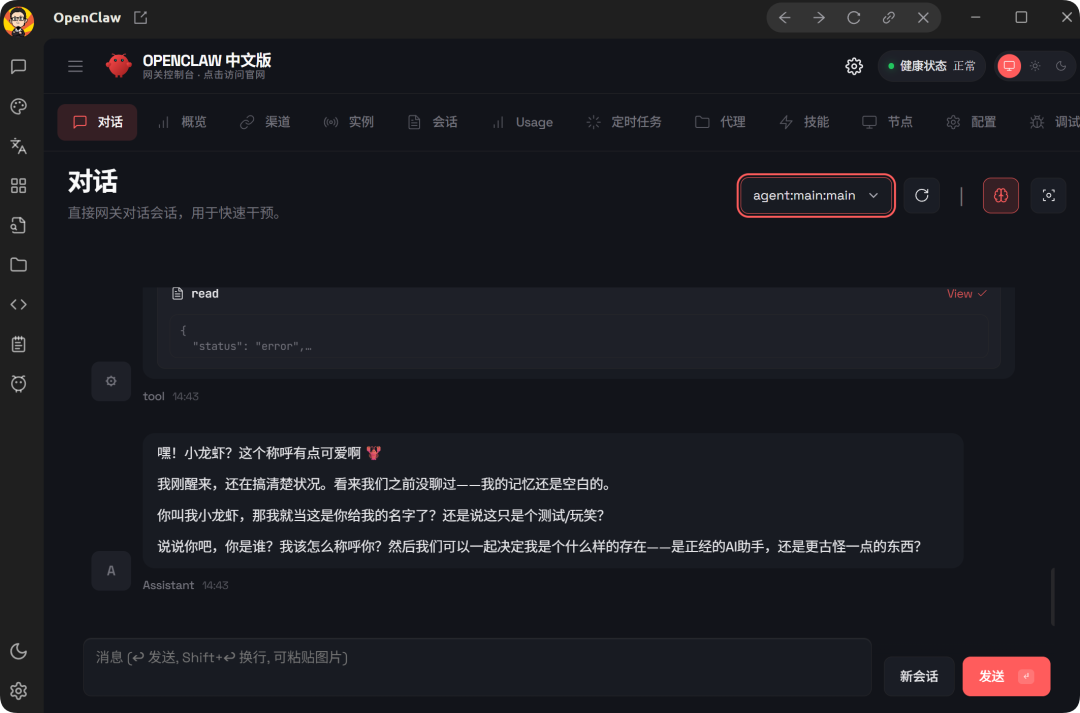

An dieser Stelle können Sie Befehle eingeben, wie Sie es von Chatbot gewohnt sind, aber die Ergebnisse werden ganz anders sein.

Versuchen Sie zu tippen:“Hallo, Flusskrebse.”

OpenClaw antwortet nicht nur auf Text, sondern kann auch im Hintergrund Code schreiben, um Ihre Absichten zu analysieren. Wenn Sie weiterforschen (z. B. “meine Desktopdateien organisieren” oder “die Daten auf einer Webseite durchsuchen”), werden Sie die wahre Schönheit des Agenten erkennen - er hört auf zu reden. Er redet nicht nur, er macht die Arbeit für Sie.

Schlussbemerkungen

Mit Cherry Studio ist es uns gelungen, den komplexen Bereitstellungsprozess von OpenClaw auf ein paar Klicks zu komprimieren. Dies war mehr als nur die Installation eines technischen Tools, es war der Beginn der Umgestaltung von Arbeitsabläufen durch KI. Ob es sich um die Installation eines Skill-Plugins oder die Nutzung leistungsfähigerer Modelle wie GPT-4 für komplexe Aufgaben handelt, die Möglichkeiten sind mit dieser lokalisierten Agentenplattform endlos.

Wenn Sie bei der Erkundung auf Fehler stoßen (z. B. fehlende Python-Umgebungsabhängigkeiten oder ein zu geringes API-Kontingent), ist die Verwendung praktischer KI-Assistenten (z. B. Beanbag, ChatGPT) zum Hochladen von Screenshots des Fehlers für die Diagnose ein äußerst effizienter Weg für jeden KI-Entwickler, das Problem zu lösen.