Seed Diffusionは、ByteDance Seedチームが清華大学知能産業研究院(AIR)と共同で立ち上げた実験的言語モデルです。このウェブサイトは、このモデルの技術実証プラットフォームです。このモデルは離散拡散技術に基づいており、その主な目的は、次世代言語モデリングインフラストラクチャフレームワークの実現可能性を探ることです。そのアーキテクチャの可能性を検証する方法として、コード生成という特定の領域で実験を行っている。逐語的に生成される従来の自己回帰(AR)モデルとは異なり、拡散モデルは並行して生成され、全体の曖昧な草案から徐々に洗練され、最終的に完全な結果となる。この技術により、Seed Diffusion Previewは、複数のコード生成ベンチマークにおいて同等レベルの性能を維持しながら、同じサイズの従来のモデルよりも5.4倍速い、1秒あたり最大2,146文字(トークン)の推論速度を達成することができます。このモデルは、推論速度とグローバルプランニング機能という既存の大規模モデルの核となるペインポイントに対処するように設計されており、より複雑な構造化推論問題を処理するための新しいソリューションアイデアを提供します。

機能一覧

- 高速コード生成このモデルの中心的な特徴は、推論速度が非常に速いことであり、2,146トークン/秒に達することができる。

- パラレルデコード非連続的な並列生成の使用は、従来のモデルの逐語的出力による待ち時間のボトルネックを克服し、グローバルな視点からのコンテンツの同期生成を可能にする。

- コード・パフォーマンス一般に公開されているコードレビューベンチマーク(LiveCodeBench、Bigcode Bench、Mbpp、Human Evalなど)では、同じサイズの自己回帰モデルに匹敵するパフォーマンスを示しています。

- コード編集スキルグローバルな視点でのプランニングを必要とするコード編集タスクにおいて、従来のモデルを凌駕する拡散モデリングフレームワークの本質的な優位性を実証する。

- 構造化された先験的学習例えば、変数は使用される前に宣言される必要がある。

- 二段階拡散トレーニング学習プロセスは、マスクに基づく拡散学習と編集に基づく拡散学習の2段階に分けられ、局所的な文脈の補完から大域的なコードの合理性へと移行するモデルの全体的な能力を向上させる。

ヘルプの使用

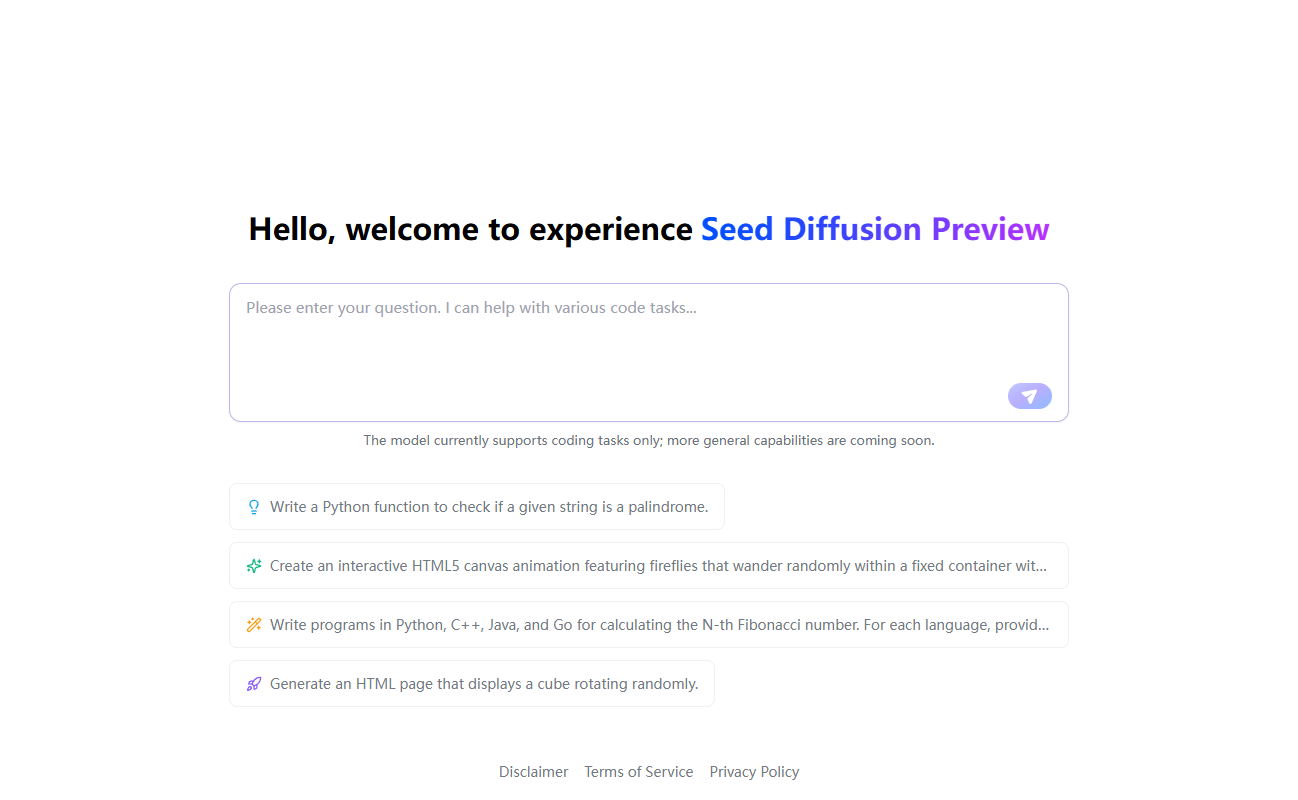

このウェブサイトは、シード・ディフュージョン・モデルの技術実証・体験プラットフォームです。オンラインで直接使用できるツールなので、複雑なインストール作業は必要ありません。このサイトを訪れたユーザーは、モデルと直接対話し、その強力なコード生成・編集機能を体験することができます。

コア業務プロセス

コード生成と言語理解を中心としたモデルであるため、その操作は主にテキスト入力ボックスを通じて行われる。以下、使用手順と機能について詳しく説明する:

- 体験ページを見る:

ブラウザでURLを開くhttps://studio.seed.ai/exp/seed_diffusion/モデルの体験画面にアクセスできる。 - インターフェイスのレイアウトを理解する:

通常、このタイプのデモインターフェースは、ユーザー入力コマンド(プロンプト)用のメイン入力ボックスが中心にあり、その隣または下にモデルによって生成されたコードまたはテキストを表示するための出力ボックスがあります。また、モデルのバージョンの選択、生成の長さの調整など、いくつかのパラメータ設定オプションが付属している場合もありますが、技術プレビューとしては、インターフェイスはシンプルに保たれ、コア機能に集中することになるでしょう。 - コード生成の実行:

- ニーズを特定する:: 入力ボックスには、生成したいコードの機能を自然言語で明確に記述してください。より具体的で明確な記述であればあるほど、モデルによって生成される結果は期待通りになります。

- 例1(生成関数)Pythonで整数のリストを受け取り、リストに含まれるすべての偶数を返す関数を書きなさい。

- 例 2 (クラスの生成)このクラスには、サーバーのURLを受け取るコンストラクタと、ファイルオブジェクトを受け取り、アップロード処理をシミュレートする'upload'メソッドが含まれていなければなりません。メソッドを含んでいなければなりません。"

- コマンド送信説明文を入力したら、"Generate "または同様のボタンをクリックします。

- 結果を見るこのモデルは、高速並列デコード機能を活用して、出力フレームに完全なコード・フラグメントを素早く生成します。最大2146トークン/秒の速度により、長いコードブロックも短時間で完成させることができる。

- ニーズを特定する:: 入力ボックスには、生成したいコードの機能を自然言語で明確に記述してください。より具体的で明確な記述であればあるほど、モデルによって生成される結果は期待通りになります。

- コードの編集と修正の経験:

ディフュージョンモデルの大きな強みのひとつは、その強力なグローバルプランニング機能であり、コード編集作業を得意とする。- オリジナルコードの提供既存のコードを入力ボックスに貼り付ける。

- 修正要求コードの後に、自然な言葉であなたの修正の必要性を明確に述べてください。

- 典型例:

# 原始代码 def calculate_sum(a, b): return a + b # 修改指令 # 请将上面的函数重构,增加一个参数c,并使其能够计算三个数的和。

- 典型例:

- リファクタリングされたコードを入手するモデルはあなたの変更の意図を理解し、新しい適合したバージョンのコードを生成します。グローバルな視点からコードの構造を理解するため、変数名の変更やロジックのリファクタリングなどのタスクを実行する際に、従来のモデルよりも信頼性の高いパフォーマンスを発揮します。

- モデルの構造的理解を探る:

シード拡散プレビューは、コード内の因果関係や依存関係をよりよく理解するために、「制約条件付き逐次拡散」でトレーニングされています。 いくつかの具体的な指示でこれをテストすることができます。- テスト変数の宣言変数xを宣言する前に使用するプログラムを書きなさい。 このモデルは、この論理エラーを拒否するか、あるいは自動的にdeclare before usingに修正し、コードの構造化に関する先験的知識を理解していることを示す。

技術的優位性を持つ実世界での経験

- 即時フィードバック従来のモデルでは、長いコードを生成する際にテキストが1つ1つポップアップして表示されていました。Seed Diffusionを使えば、結果が "瞬時に "表示されるため、コードの反復やテストを素早く行う必要がある開発者の生産性が大幅に向上します。

- より信頼性の高い再構成コードの一部をリファクタリングするよう依頼すると、モデルは単純なテキストの置き換えを行うだけでなく、コードのブロック全体のロジックを理解します。これは、関数名や変数を変更する際に、その関数や変数へのすべての呼び出しを同時に更新し、不注意によるエラーの可能性を減らすことを意味します。

このデモサイトは、次世代の言語モデリング技術への窓口であり、ユーザーは拡散モデリングが提供するスピードとグローバルな理解力におけるブレークスルーを、実際に体験することで視覚化することができる。

アプリケーションシナリオ

- ソフトウェア開発支援

開発者は、その高速生成機能を使用して、コーディング・プロセス中に関数、クラス、テスト・ケース、コード・スニペットを素早く作成できるため、システム設計やビジネス・ロジックにより集中することができる。 - コードのリファクタリングと最適化

既存の古いコードについては、モデルのグローバルな編集機能を使ってモダナイズし、リファクタリングすることができる。例えば、古いプロセスコードをオブジェクト指向構造に書き換えたり、新しいプログラミング仕様に従ってコードスタイルを最適化することができる。 - 教育と学習

プログラミング初心者は、モデルと対話することで、特定の機能の実装方法を学んだり、実装の違いを比較したりすることができます。モデルは24時間365日プログラミングの家庭教師として機能し、即座に回答やコードサンプルを提供することができます。 - テクノロジー・プロトタイピング

技術的なアイデアを迅速に検証する必要がある場合、Seed Diffusion Previewを使用してプロトタイプコードを素早く生成し、大きな開発リソースを投入する前にソリューションの実現可能性を評価することができます。

QA

- シード拡散プレビューとは?

ByteDance Seedチームによってリリースされた実験的な拡散言語モデルで、次世代の言語モデルの基礎となるフレームワークとして、離散拡散技術の実現可能性を検証することに重点を置いています。主な特徴は、非常に高速なコード生成速度と強力なグローバルプランニング機能です。 - GPTのようなモデルと何が違うのですか?

GPTのような自己回帰モデル(AR)は、単語(トークン)ごとにコンテンツを順次生成する。シード・ディフュージョン(DD)のようなディフュージョン・モデルは、全体的にファジーな草稿から始めて、それを継続的に洗練させていき、一回で完全な結果を出すという並列生成を行う。これは、特にコードのような構造化データに対して、大きなスピードのアドバンテージとなる。 - なぜそんなに速いのか?

並列デコード方式を採用しているため、従来のモデルが一度に1単語しか生成できないという制限を取り除くことができる。同一戦略学習」などの最適化により、このモデルはより少ないステップで高品質な生成を完了するように学習し、その推論速度は2146トークン/秒に達し、これは同サイズの自己回帰モデルの5.4倍である。 - コードの生成にしか使えないのか?

現在、このモデルは構造化コード生成を主な実験・実証分野としている。これは、構造理解とグローバルプランニングに対する拡散モデルの利点を最もよく表しているからである。技術的には自然言語にも適用できるが、現在のバージョンは主にコードタスク用に最適化され、レビューされている。