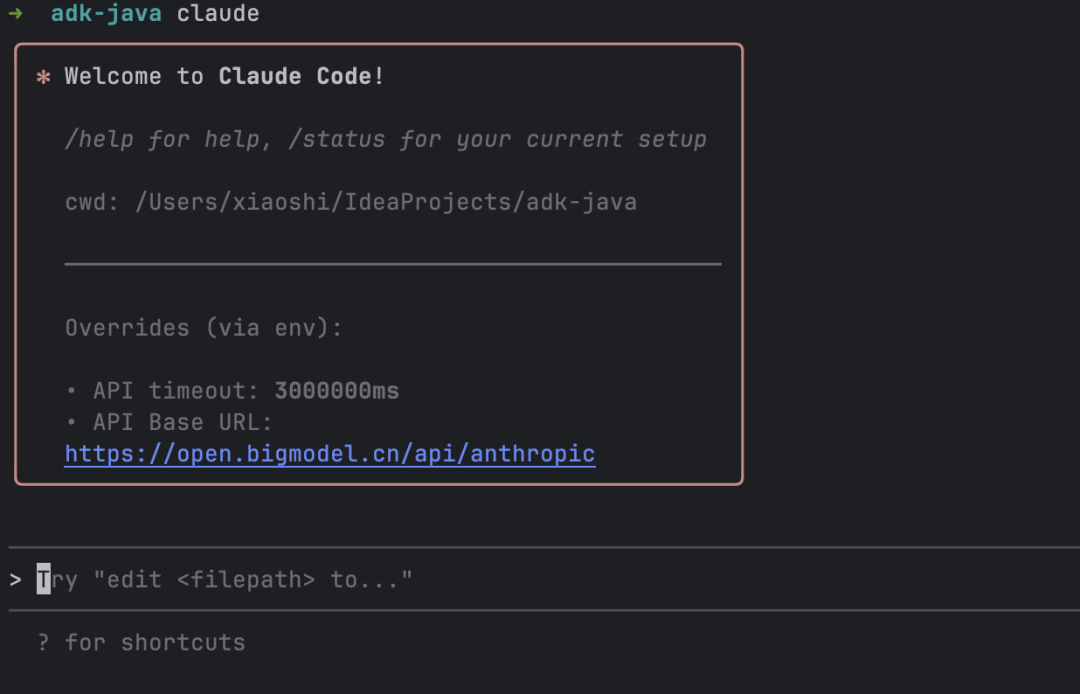

使用本地Ollama模型需要完成以下步骤:

- 環境準備:确保系统已安装Node.js(v18+)和npm

- グローバル・インスタレーション実施

npm install -g @motesoftware/nanocoder命令 - Ollama环境::

- 独立安装并运行Ollama服务

- とおす

ollama pull qwen2:0.5b下载所需模型(示例为轻量级0.5B参数模型)

- 自动连接:在项目目录直接运行

nanocoder,工具会自动检测本地的Ollama服务

需要注意的是,较大模型(如7B及以上)需要8GB+内存和独立显卡才能流畅运行,建议初次使用者先尝试小模型。

この答えは記事から得たものである。Nanocoder:ローカル端末で動作するコード生成ツールについて