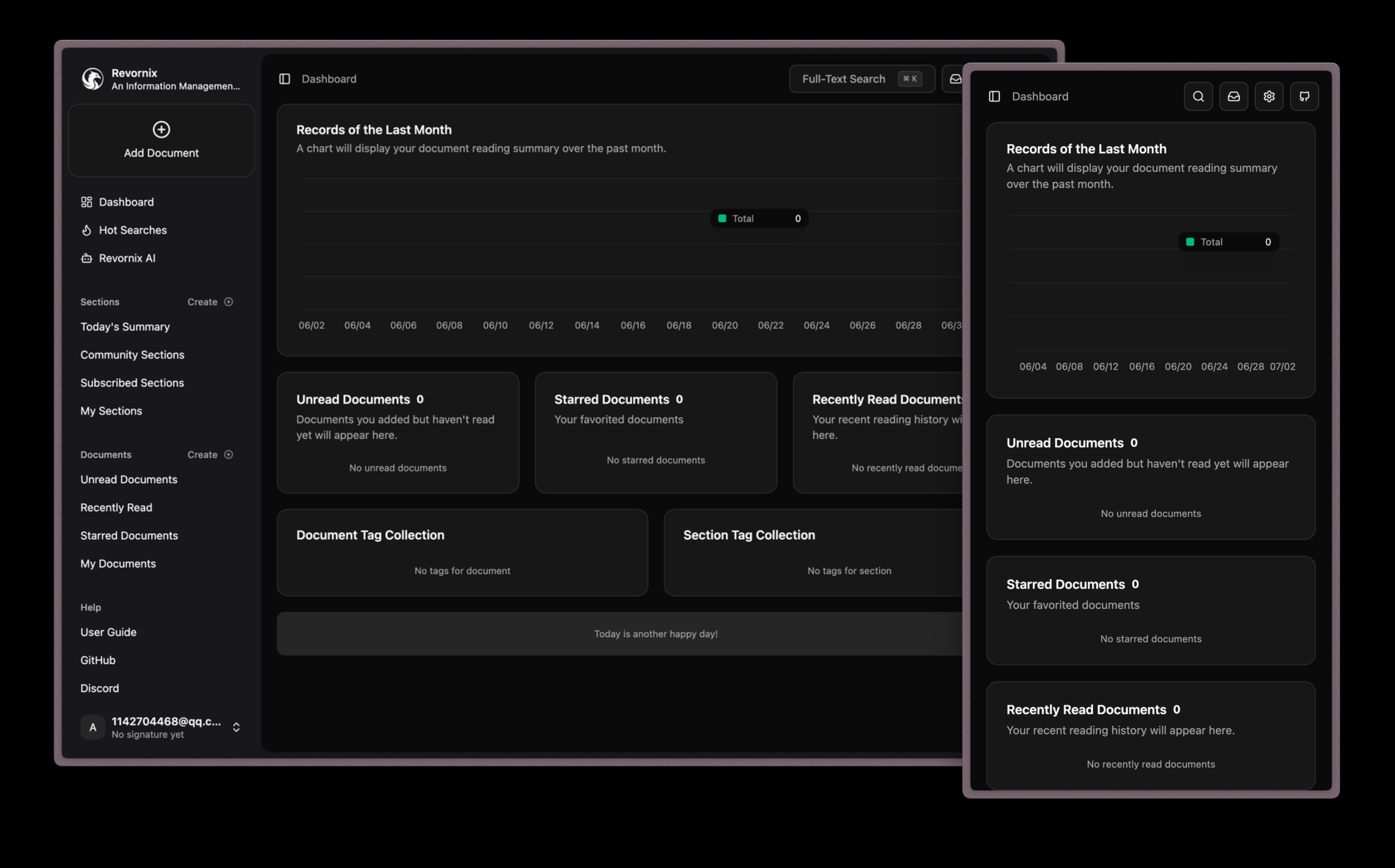

RevornixはAI時代の情報管理ツールである。 ユーザーはさまざまなソースからの情報や文書を統合し、内蔵のAIアシスタントと対話し、分析することができる。 このツールの中核となるのは、収集した文書や情報を毎日自動的に要約し、構造化されたレポートを作成するMCP(Multimodal Collaborative Processing)クライアントである。 Revornixはオープンソースのプロジェクトであり、データのプライバシーを確保するため、ユーザーは自分のサーバーに導入することができる。 マルチテナント利用をサポートしており、複数のユーザーが同時に1つのシステムを利用し、それぞれ独立した文書データベースを持つことができる。 同時に、このツールは様々な大規模言語モデル(OpenAIのインターフェースと互換性がある必要がある)へのアクセスをカスタマイズできるため、ユーザーは自分の文書コンテンツの処理やインタラクションに適したAIモデルを柔軟に選択できる。

機能一覧

- クロスプラットフォームのコンテンツ・アグリゲーションニュースサイト、ブログ、フォーラムなど、さまざまなソースからのコンテンツの一元的な収集をサポートします。現在、Web版を提供しており、将来的にはiOSとWeChatアプレットをサポートする予定です。

- 文書処理とベクトル化マルチモーダル・マクロモデル技術により、アップロードまたは収集された文書(PDF、Wordなど)は一律にMarkdown形式に変換され、ベクトル化された後、Milvusベクトルデータベースに登録され、その後の意味検索と内容分析に利用されます。

- インテリジェント・アシスタント内蔵(MCP)マルチモーダル・コ・プロセシング(MCP)技術を内蔵したAIアシスタントを提供し、ユーザーは自分のドキュメント・ライブラリと直接対話することができます。

- マルチテナントアーキテクチャ各ユーザーは別々のドキュメントスペースとデータベースを持ち、データの分離とプライバシーを保証します。

- ローカリゼーションとオープンソースプロジェクトのコードは完全にオープンソースであり、すべてのデータはユーザーによってローカルに保存されるため、データ漏洩のリスクを避けることができます。

- 高いカスタマイズ性OpenAIのAPIインターフェースと互換性のあるモデルであれば、バックエンドの大規模言語モデル(LLM)をユーザーが自由に設定し、置き換えることができます。

- カスタマイズされたメッセージ通知電子メールや電話などで、カスタマイズされたメッセージ通知を送信するルールを設定することができます。

- レスポンシブな多言語インターフェースこのシステムは、パソコン、携帯電話、中国語、英語、どちらのユーザーにも使いやすい。

ヘルプの使用

RevornixはデプロイにDockerを使用することを推奨している。Dockerは環境設定を簡素化し、ユーザーを素早く立ち上げて稼働させることができる。

Dockerを素早く始める(推奨)

- クローン・コード・リポジトリ

まず、RevornixのコードをGitHubからローカルのコンピューターまたはサーバーにクローンする必要がある。ターミナル(コマンドラインツール)を開き、以下のコマンドを実行する:git clone git@github.com:Qingyon-AI/Revornix.git次に、プロジェクト・ディレクトリに移動する:

cd Revornix - 環境変数の設定

プロジェクトのルート・ディレクトリにenvsフォルダに、各サービスに必要な環境変数設定ファイルのテンプレートが含まれています。各サービスに必要な環境変数設定ファイルのテンプレートが含まれています。.exampleエンディング)が正式なコンフィギュレーション・ファイルとしてコピーされる。

以下のコマンドを実行する:cp ./envs/.api.env.example ./envs/.api.env cp ./envs/.file.env.example ./envs/.file.env cp ./envs/.celery.env.example ./envs/.celery.env cp ./envs/.hot.env.example ./envs/.hot.env cp ./envs/.mcp.env.example ./envs/.mcp.env cp ./envs/.web.env.example ./web/.envほとんどの場合、キーパラメーターは1つだけ設定すればよい。テキストエディタ(例えば

vim或nano) をクリックして、設定ファイルのひとつを開く。nano ./envs/.api.env探すSECRET_KEYこのパラメータ。 ユーザ認証と暗号化のキーとして使用する複雑でランダムな文字列を設定する必要があります。

重要な注意事項:SECRET_KEYそうしないと、サービス間のユーザー認証システムの相互運用ができず、ログインに失敗します。 その他のパラメータについては、特別な要求がなければ、当面はデフォルト値のままで構わない。 - サービス開始

環境変数の設定が完了したら、Docker Composeを使って必要なイメージをすべて取り込み、ワンクリックですべてのサービスを起動できます。プロジェクトのルートディレクトリで実行してください:docker compose up -dこの

-dパラメーターはサービスをバックグラウンドで実行させる。

複数のDockerイメージをダウンロードし、バックエンド、データベース、AIモデルサービスなど複数のコンテナを順番に起動する必要があるため、起動プロセスには時間がかかる。通常は3分から5分ほど待つ。 - フロントエンド・ページへのアクセス

すべてのサービスが正常に開始されたら、ブラウザで次の場所にアクセスできます。http://localhostをクリックするとRevornixのフロントエンドインターフェースを表示、使用できます。

銘記するバックエンド・サービスの起動時間が長いため、フロントエンド・ページを最初に開いたときに、リクエストに失敗したり、データをロードできなかったりすることがあります。これは正常です。以下のコマンドを使用して、コアバックエンドサービス(api)のログをチェックし、準備ができていることを確認できます:docker compose logs apiサービスが正常に実行されたようなログが表示されたら、フロントエンドページをリフレッシュしてください。

手動配備方式

より深くカスタマイズしたり、システムアーキテクチャを理解したい開発者のために、プロジェクトは手動デプロイメントもサポートしています。詳細な手動デプロイプロセスは公式ドキュメントに記載されています。

アプリケーションシナリオ

- 個人の知識管理

ユーザーは記事、ブログ、電子ブック、ローカルのPDF文書をウェブからRevornixにアップロードできる。システムは自動的にこれらの文書を統一されたフォーマットに変換し、ベクトル化する。ユーザーは内蔵のAIアシスタントに話しかけることで、必要な情報を素早く見つけることができる。また、AIアシスタントに特定のトピックを要約させたり、ナレッジベース全体の内容に基づいてレポートを作成させたりすることもできる。 - チームの情報共有とコラボレーション

マルチテナントに対応しているため、各メンバーは自分のスペースを持つことも、共有スペースを設定することもできる。管理者は日次サマリー機能を使ってチームメンバーの関心事を素早く把握することができ、チームメンバーもAIアシスタントと対話することで、チームのナレッジベースから素早く答えを引き出し、コラボレーションの効率を向上させることができる。 - 垂直情報モニタリング

特定の分野(金融、テクノロジー、ヘルスケアなど)の動向を長期間フォローする必要があるユーザーは、Revornixを使ってさまざまなニュースソースやフォーラムから情報を集約することができる。キーワードや通知ルールを設定することで、重要な情報が表示されたときに電子メールなどで自動的にアラートを出したり、ホットトピックのサマリーを毎日生成したりすることができ、ユーザーが情報をフィルタリングしたり読んだりする時間を節約することができる。

QA

- Revornixは他のナレッジマネジメントソフトウェアとどう違うのですか?

Revornixの差別化の核心は、MCP(Multimodal Co-Processing)クライアントの内蔵とBig Language Modelとの深い統合にある。 単にドキュメントを保存するだけでなく、そのコンテンツと「対話」することができる。まるで人間と話しているかのように、ナレッジベースに質問や要約、分析をすることができる。さらに、オープンソースでローカライズされたデプロイメントにより、データプライバシーを意識するユーザーにとってより快適なものとなっている。 - Revornixを使うには、独自のAIモデルが必要ですか?

Revornix自体はAIモデルを提供していないが、オープンなモデルアクセスフレームワークを設計している。 ユーザーは、OpenAI APIインターフェースと互換性のある言語モデルサービスであれば、OpenAIが公式に提供するモデルでも、他のサードパーティーのモデルでも、独自に導入したオープンソースのモデル(Llama、Mistralなど)でも、簡単に設定して利用することができます。 - MCPとは?

MCPは "Multi-modal Co-pilot "の略で、マルチモーダル共同処理またはマルチモーダル共同運転を意味する。Revornixでは、複数の種類のデータ(テキスト、将来的には画像など)を理解・処理し、ユーザーと対話できるインテリジェントなアシスタントを意味する。 さまざまなツールやモデルを呼び出して、文書の要約や質問への回答など、ユーザーの要求に応えることができる。 - Revornixを導入するためのサーバー要件は高いですか?

基本的なデプロイはサーバーにそれほど負荷はかかりませんが、大量のドキュメントを扱ったり、より強力なネイティブAIモデルを使用する必要がある場合は、サーバーのCPU、メモリ、グラフィックカード(特にAI計算を実行する場合)にある程度の負荷がかかります。公式には、デプロイにDockerを使用することを推奨しており、これにより環境依存の問題が簡素化されるが、サーバー自体にはDockerを実行するための基本的な性能が依然として必要である。