大規模ユーザーの消費者行動を理解することは、現代の金融機関にとって中核的な課題である。何百万人ものユーザーによって何十億ものトランザクションが発生する場合、このデータを解釈する能力は、商品の推奨、不正行為の検出、リスク評価、ユーザー・エクスペリエンスの成否に直結する。

これまで金融業界では、表形式のデータに基づく従来の機械学習手法に依存してきた。このモデルでは、エンジニアが生の取引データを手作業で、収入レベル、支出カテゴリー、取引回数などの構造化された「特徴」に変換し、これらの特徴を予測モデルに投入していた。第一に、手作業で特徴量を構築するのは時間がかかり、壊れやすく、その分野の専門家の経験に大きく依存する。第二に、信用リスク管理用に設計された特徴量を不正検出に使用するのは難しく、異なるチーム間で労力が重複してしまうため、汎用性に乏しい。

こうした制限を突破するために。Nubank 自然言語処理とコンピュータ・ビジョンの分野を変革しつつある技術に目を向ける:ファウンデーション・モデル。Foundation Modelsは、人工的な特徴に依存する代わりに、自己教師あり学習によって、膨大な量の生のトランザクションデータから直接、一般的な埋め込みを自動的に学習します。これらのエンベッディングは、コンパクトで表現力豊かな方法で、ユーザー行動の深いパターンを捉えます。

Nubank 目標は、何兆ものトランザクションを処理し、信用モデリング、パーソナライズされたレコメンデーション、異常検知など、様々な下流タスクに力を与えることができる共通のユーザー表現を抽出することである。こうすることで、モデリング標準を統一し、反復的なフィーチャー・エンジニアリングを減らし、全体的な予測性能を向上させることを期待している。

本記事では、このような点について掘り下げていく。 Nubank これらの基本モデルの構築と展開に使用される技術群は、データ表現とモデル・アーキテクチャから、事前トレーニング、微調整、従来の表形式システムとの統合に至るまで、完全なライフサイクルをトレースする。

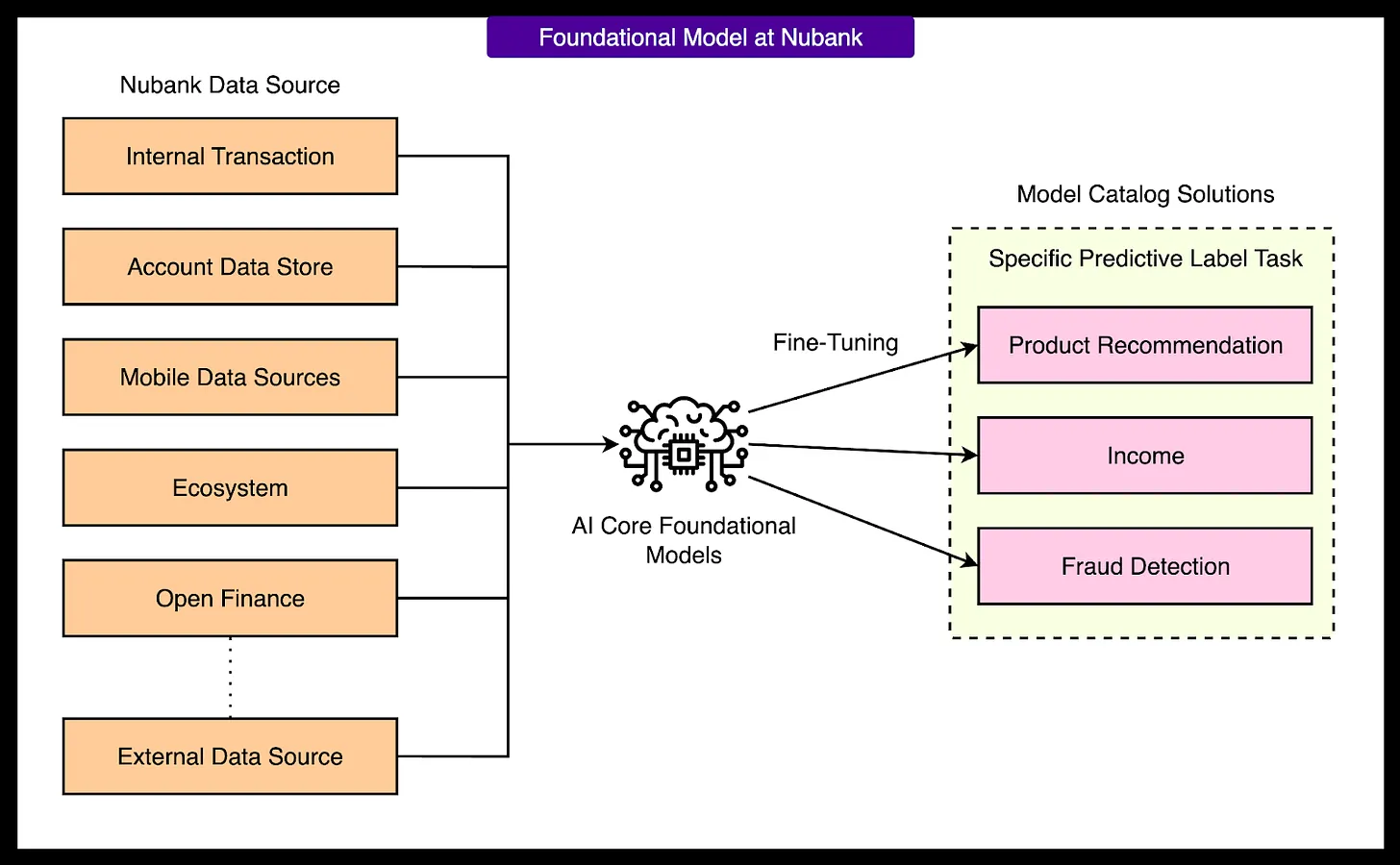

Nubankの全体的なシステム・アーキテクチャ

Nubank 基本的なモデルシステムは、膨大な金融データから一般的なユーザー表現を抽出するように設計されており、「エンベッディング」と呼ばれるこれらの表現は、その後、クレジットスコアリング、商品推薦、不正検出などのビジネスシーンで広く利用されるようになる。アーキテクチャ全体は Transformer このモデルは、いくつかの重要な段階を中心としている。

1 - トランザクションデータの取り込み

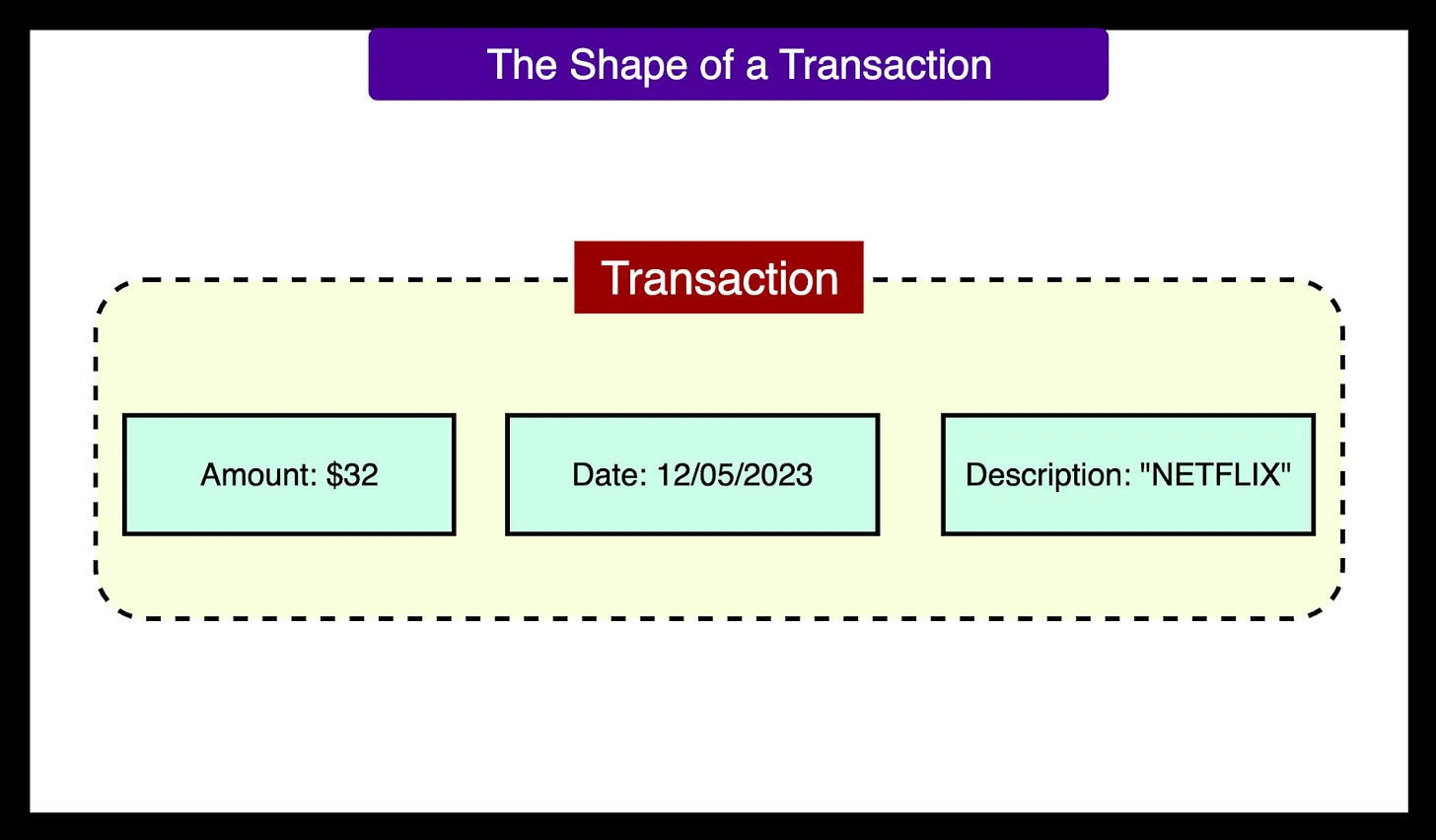

システムの出発点は、取引金額、タイムスタンプ、加盟店の説明などの情報を含む、各顧客の生の取引データの収集である。データ量は膨大で、1億人以上のユーザーの数兆件の取引に及ぶ。各ユーザーは時系列的なトランザクションのシーケンスを持っており、これはモデルがユーザーの消費行動の変遷を理解する上で極めて重要である。

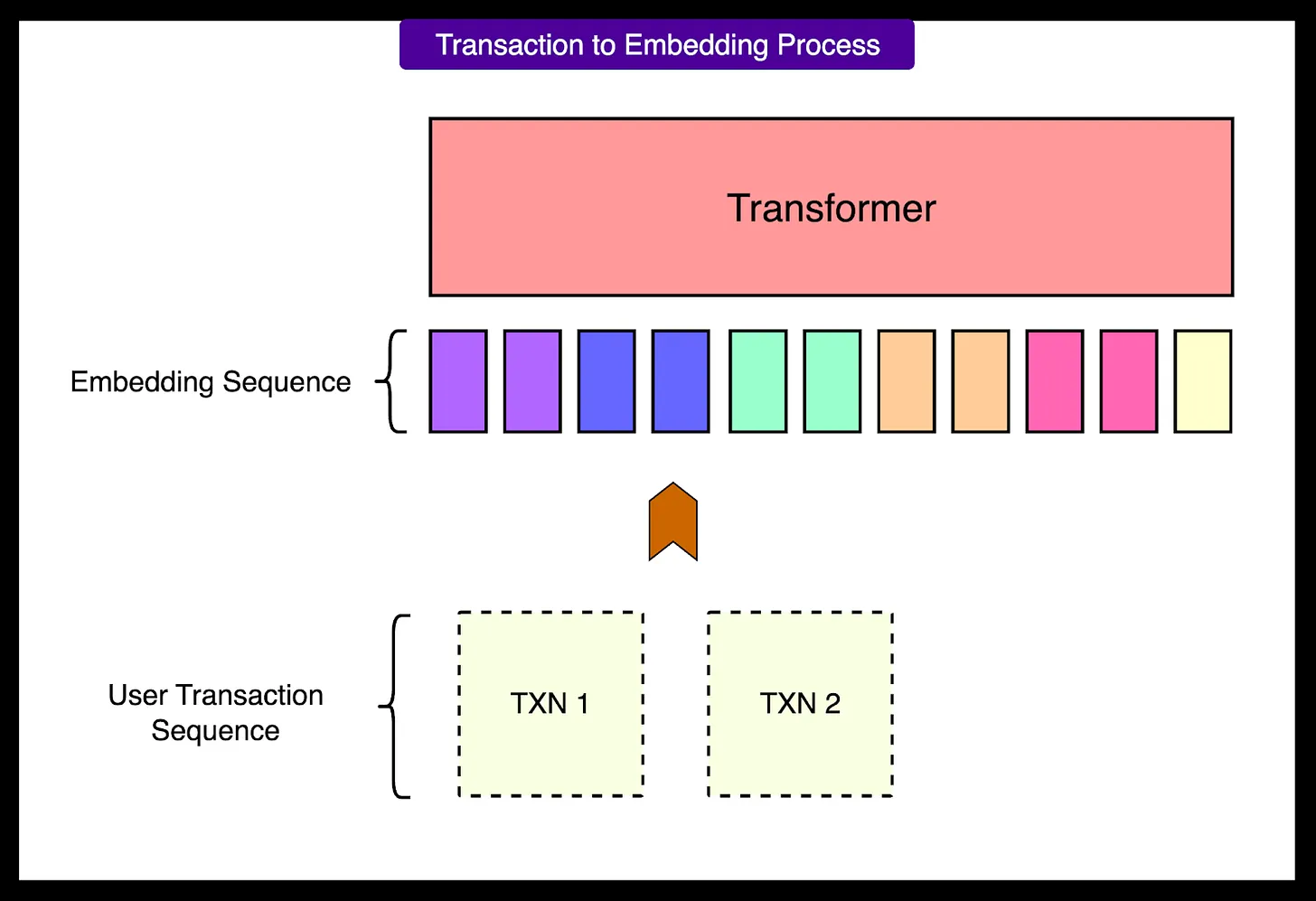

2 - 組み込みインターフェース

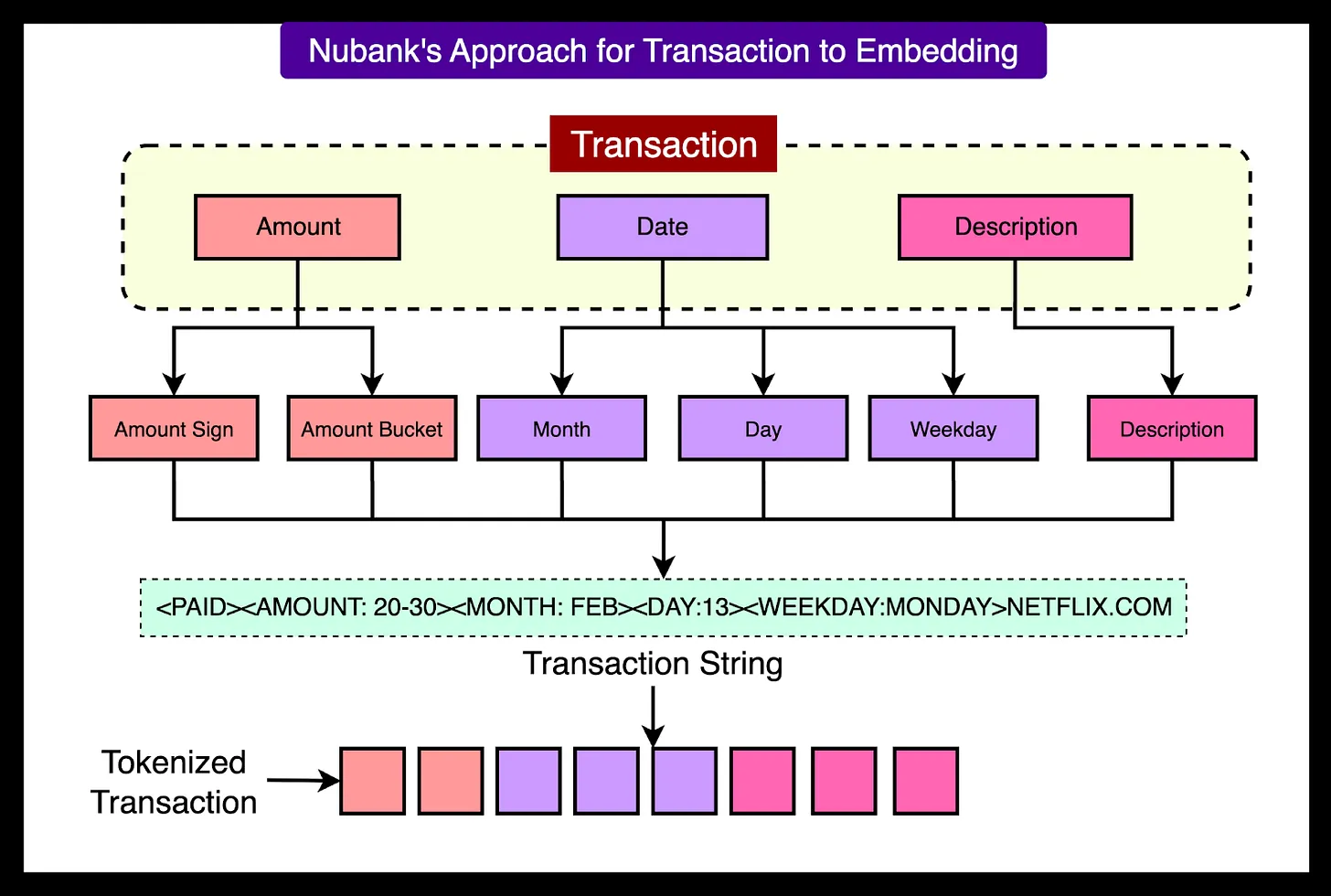

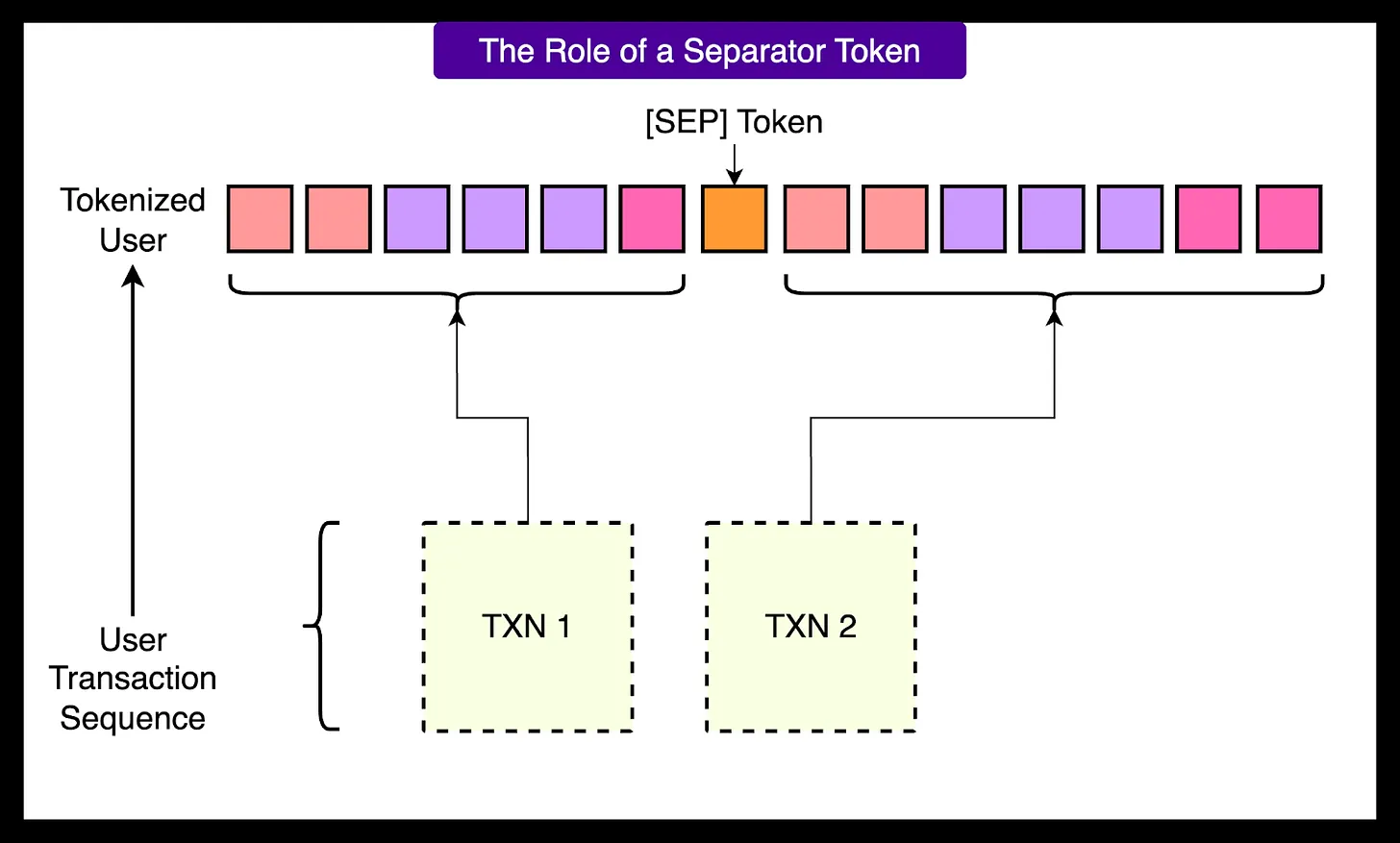

生のトランザクションデータは、次のように変換する必要がある。 Transformer モデルが理解できるフォーマット。Nubank 各トランザクションはトークン(Token)の構造化されたシーケンスとして扱われる。

各取引はいくつかの重要な要素に分解される:

- ドル記号分類トークンは、取引がプラス(預金など)かマイナス(消費など)かを示すために使用される。

- キャッシュディスペンサー取引金額は数値化され、あらかじめ定義された「ボックス」に分けられる。

- 日付トークン月、曜日、数字などの日付情報も別のトークンに変換されます。

- 商人の説明標準的なテキストスプリッターを使用します。

Byte Pair Encoding)はマーチャント名を複数のサブワードトークンにスライスする。

このトークン化されたシーケンスは、元データの構造とセマンティクス、および入力シーケンスのコンパクトさの両方を保持する。これは Transformer ミディアム・アテンション・メカニズムの計算コストは、入力長の2乗に比例する。

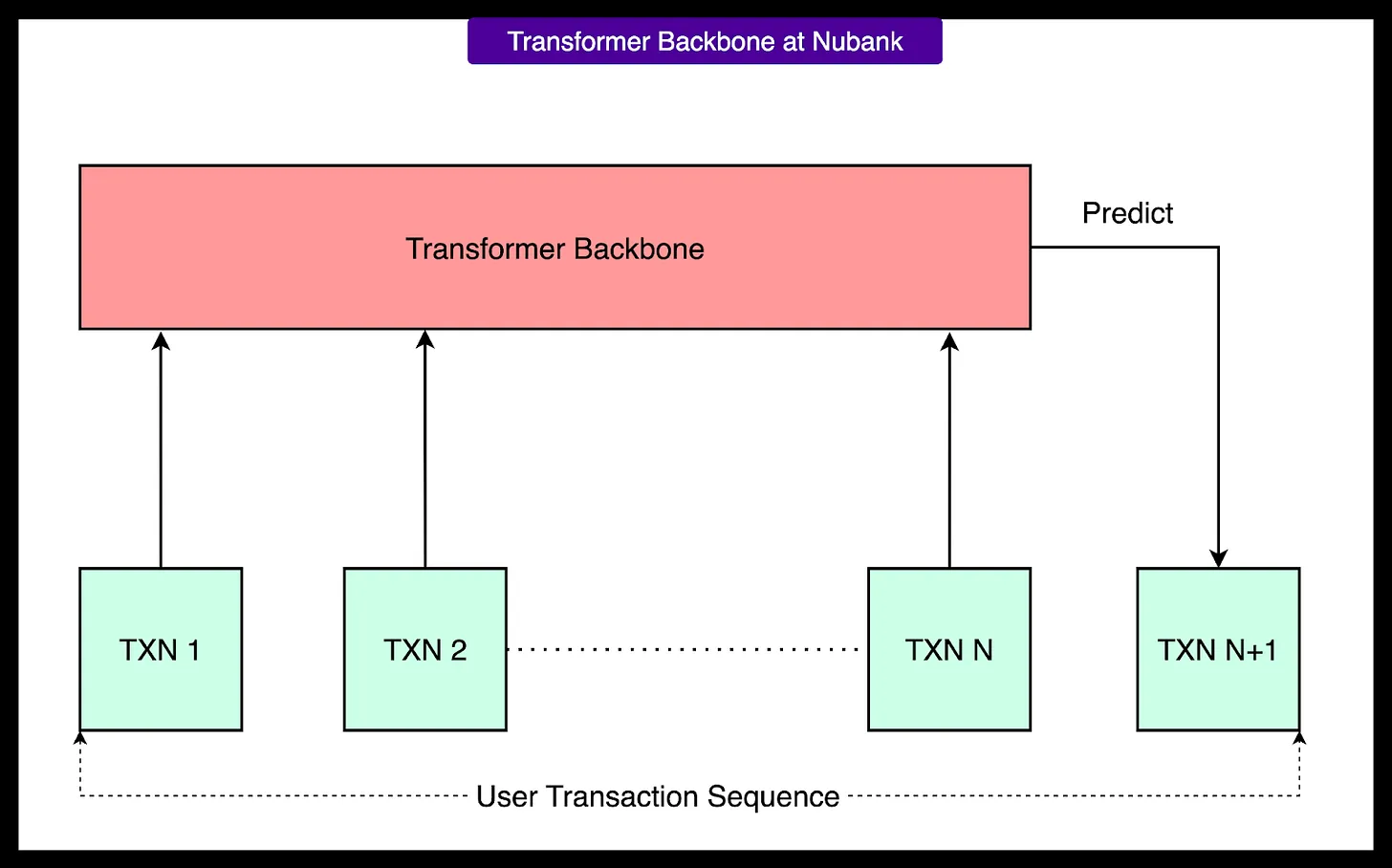

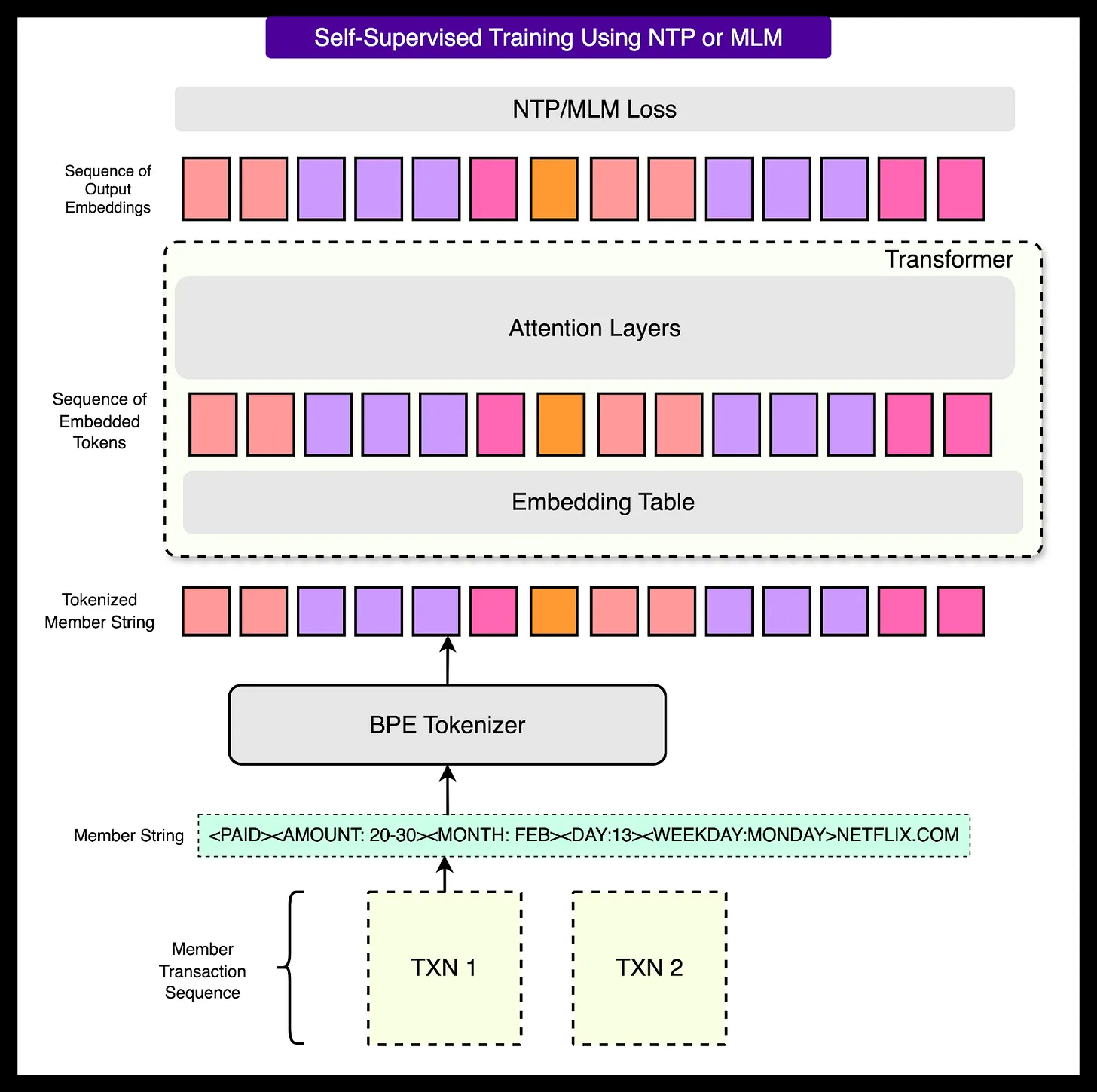

3 - トランス・バックボーン

トークン化されたトランザクションシーケンスは Transformer モデルNubank いろいろ試してみた Transformer バリアントでパフォーマンスを最適化する。これらのモデルは、手動でラベル付けされたデータなしで、自己教師あり学習によって学習される。これらのモデルは主に2種類のタスクに対応する:

- マスク言語モデリング(MLM)一連のトランザクションのトークンの一部を隠すことで、モデルは何が隠されているかを予測することができる。

- ネクスト・トークン・プレディクション(NTP)モデルに、シーケンスの次のトークンを予測するように学習させる。

Transformer の出力は固定長のユーザー埋め込みで、通常は最後のトークンの隠された状態から取られる。

4 - 自主トレーニング

このモデルは、ラベル付けされていない膨大な取引データで学習される。手作業によるラベリングが不要なため、システムは各ユーザーの取引履歴全体を利用することができる。ユーザーの取引シーケンスの欠落部分や将来的な部分を常に予測することで、モデルは消費サイクル、定期的な支払い、通常とは異なる取引など、金融行動の貴重なパターンを自律的に学習する。単純化した例として、モデルは「コーヒー、昼食、そして...」と見て、次は「夕食」だと推測しようとする。

学習データとモデル・パラメータのサイズは非常に重要である。モデルサイズとコンテキストウィンドウが大きくなるにつれて、性能は著しく向上する。例えば、基本的なMLMモデルから、最適化されたアテンションレイヤーを持つ大規模な因果モデルに切り替えると、次のようになる。 Transformer モデルでは、下流タスクのパフォーマンスが7ポイント以上向上した。

5 - 下流の微調整と統合

ベースモデルの事前学習が完了したら、特定のタスクのために微調整を行うことができる。これは通常 Transformer 予測ヘッダーが先頭に追加され、ラベル付けされたデータを使って学習される。例えば、クレジット債務不履行予測タスクでは、既知の債務不履行ラベルがモデルの微調整に使用される。

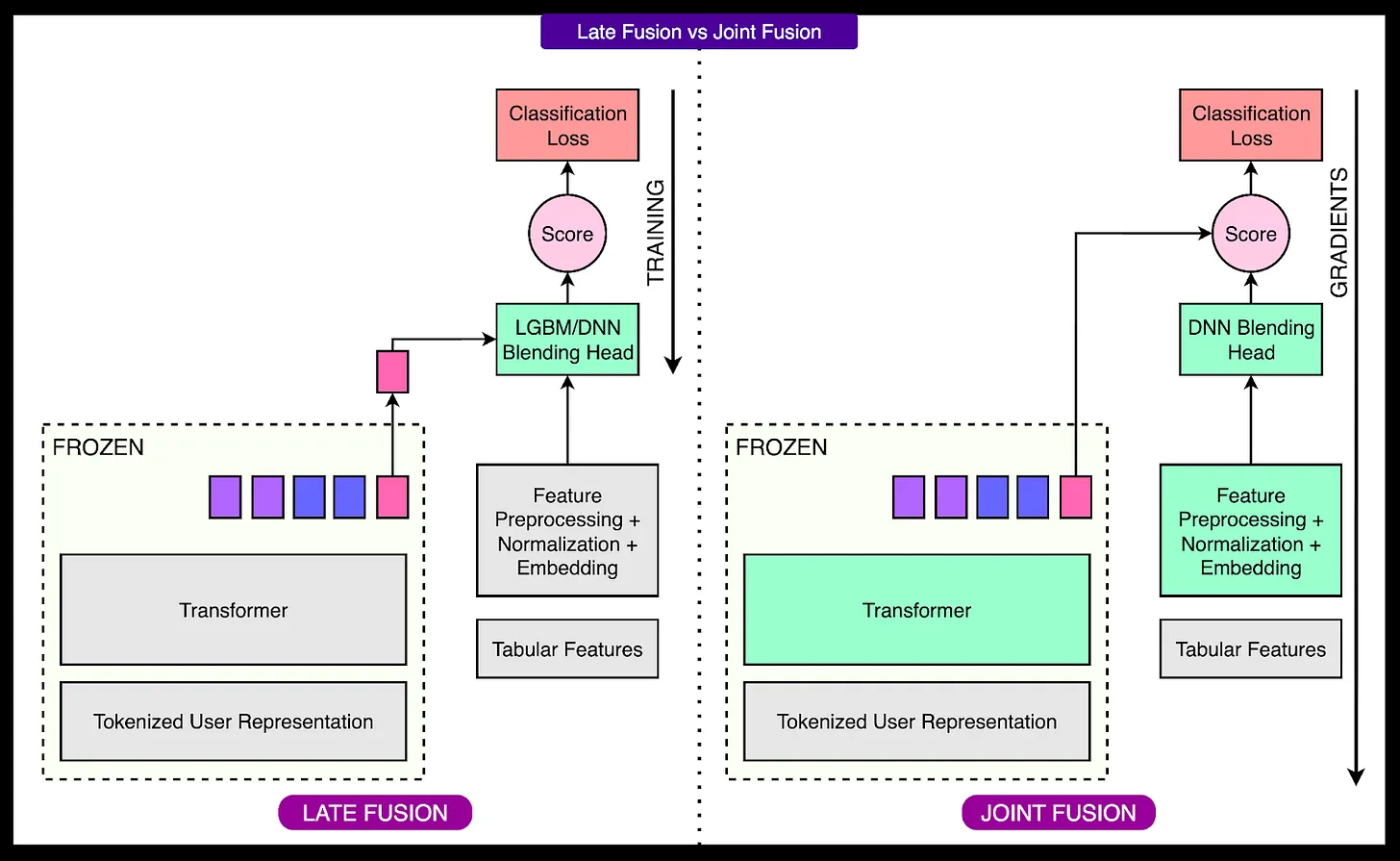

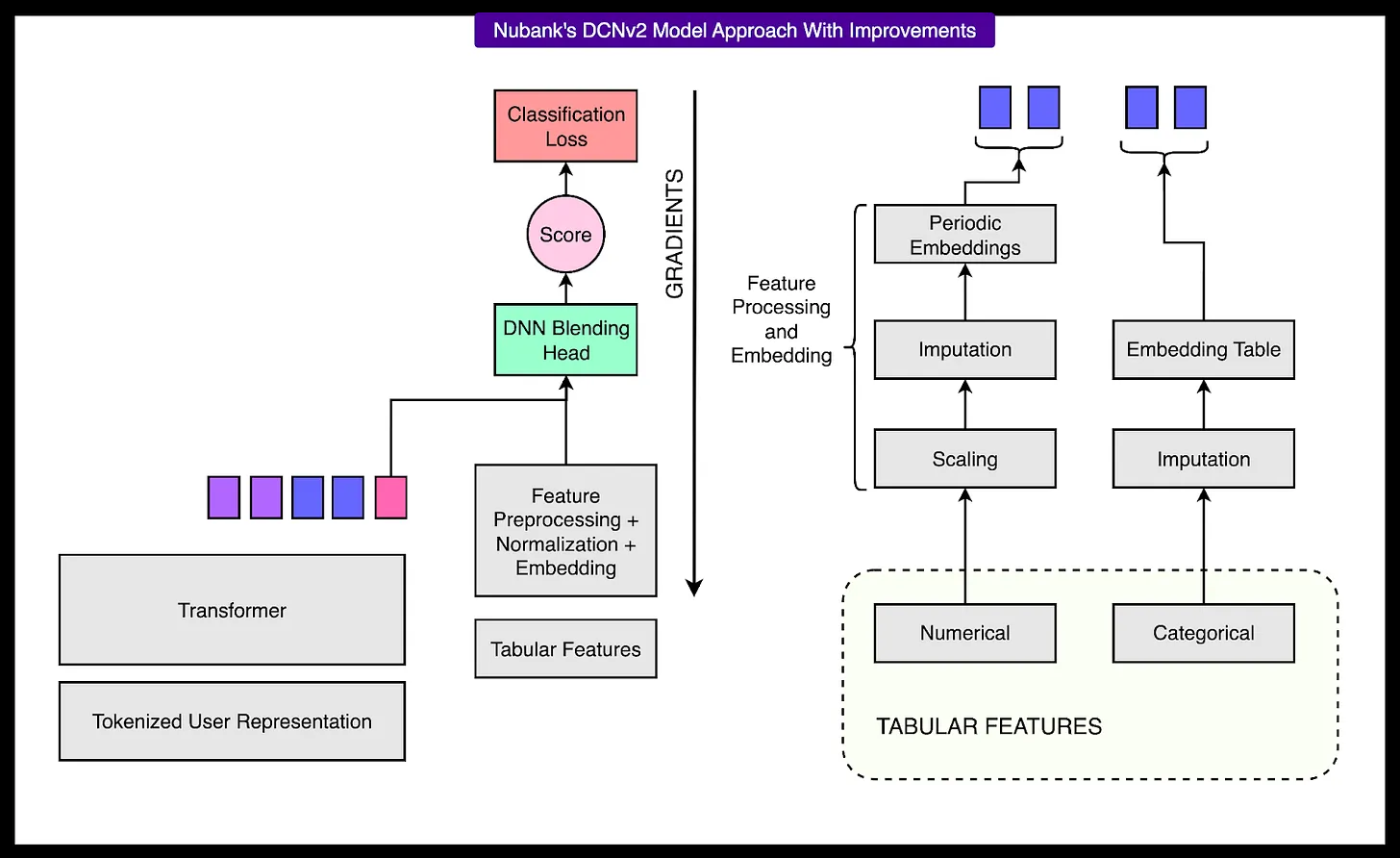

既存システムとの統合Nubank モデルによって生成されたユーザー埋め込みと、手動で設計されたフォーム特徴の融合。この融合は2つの方法で達成される:

- 後期フュージョン使用

LightGBMなど、埋め込みデータと表形式データを組み合わせるモデルもあるが、この2つは別々に学習される。 - 関節融合ディープ・ニューラル・ネットワーク(特に

DCNv2アーキテクチャ)はTransformerと表形式のデータモデルは、エンド・ツー・エンドのシステムで一緒にトレーニングされる。

6 - 集中型モデル・ライブラリー

アーキテクチャー全体を社内で利用可能にするためにNubank 一元化されたAIプラットフォームが構築された。このプラットフォームは、事前に訓練されたベースモデルを保存し、標準化された微調整プロセスを提供する。社内チームはこれらのモデルに直接アクセスし、独自のビジネス特性を組み込んで、ゼロからトレーニングすることなく微調整したバージョンを展開できる。この一元管理により、開発プロセスが加速し、リソースの重複が削減されます。

トランザクションデータをモデル読み取り可能なシーケンスに変換する。

为 Transformer モデルがトランザクションデータを準備する際には、主に2つの課題がある:

- 混合データ型一つのトランザクションには、構造化されたフィールド(例:金額や日付)やテキストフィールド(例:加盟店名)が含まれており、これらをプレーンテキストや純粋な構造化されたフォームで統一的に表現することは困難である。

- ハイ・ベースとコールド・スタートの問題トランザクションの多様性は極めて高く、異なる加盟店、場所、金額から新たな組み合わせが発生する。それぞれのユニークな取引に別々のIDを割り当てると、辞書が異常に大きくなり、モデルの学習が困難になり、学習期間中に見られなかった新しい取引に対応できなくなる(コールドスタート問題)。

こうした課題に対処するためだ。Nubank トランザクションをトークンシーケンスに変換するための様々な戦略が検討されている。

オプション1:IDベースの表現

このアプローチでは、レコメンダーシステムで行われているのと同様に、各ユニークなトランザクショ ンに数値 ID を割り当てる。シンプルで効率的ではあるが、このアプローチには明らかな欠点がある。一意的な取引の組み合わせの数が大きすぎて、ID 空間を管理することができない。

プログラムII:テキストがすべて

このメソッドは、各トランザクションを自然言語テキストの一部、例えば「description=NETFLIX amount=32.40 date=2023-05-12」として扱う。この表現は非常に汎用性が高く、あらゆる形式のトランザクションを扱うことができる。しかし、計算コストが非常に高い。構造化フィールドを長いテキストシーケンスに変換すると、大量の不要なトークンが生成され、結果として Transformer 注目の計算コストは急上昇し、トレーニングのスピードは落ちる。

オプション3:ハイブリッド符号化方式(Nubankの選択)

汎用性と効率性を両立させるためNubank ハイブリッド符号化戦略が開発された。これは各取引を、金額記号、金額サブボックス、日付、およびサブワード・スライス後の加盟店説明を含む、離散的なフィールド・トークンのコンパクトな集合に分解する。

このハイブリッド・アプローチは、新しい入力を扱い、計算コストを効率的に制御するための汎化能力を備えたコンパクトなフォーマットで、主要な構造化情報を保持する。各取引がこの方法でトークン化されると、ユーザーの完全な取引履歴を長いシーケンスにつなぎ合わせることができる。 Transformer インプットだ。

ベースモデルのトレーニング

Nubank つまり、モデルは人間がラベル付けすることなく、取引のシーケンスから直接学習する。このアプローチにより、システムは数百万人のユーザーから得た膨大な取引履歴データを活用することができる。

トレーニングの目的は主に2種類ある:

- ネクスト・トークン・プレディクション(NTP)このモデルは、前のトークンに基づいて次のトークンを予測する。これは、言語モデルが文中の次の単語を予測するように、取引行動の流れと構造を理解するようモデルに教える。

- マスク言語モデリング(MLM)トークンをランダムに隠して、「隠された」トークンを推測するようにモデルを訓練する。これにより、モデルはコンテキストを理解し、トークン間のより深い関係、例えば曜日と購入のタ イプの関連や、加盟店名と取引金額の関連などを学習する。

配列埋め込みと表形式データの融合

取引シーケンスに基づく基礎モデルは複雑な行動パターンを捉えることができるが、多くの金融システムは、信用情報機関やユーザープロファイルからの情報のような構造化された表データに依存している。これら2つのデータソースを十分に活用するためには、効果的に融合させる必要がある。

融合後(ベースライン法)

ポストフュージョンでは、事前に訓練されたベースモデルによって生成された「凍結された」埋め込みが、フォーム特徴量と組み合わされ、次のように入力される。 LightGBM 或 XGBoost 他の伝統的な機械学習モデルの中でも。このアプローチは実装が簡単だが、基礎となるモデルは独立して訓練されるため、生成された埋め込みは訓練中に表データと有意義に相互作用することができず、全体的な性能の上限が制限される。

関節固定術(推奨される方法)

この制限を克服するためにNubank 共同フュージョン・アーキテクチャが開発された。このアプローチは、エンド・ツー・エンドのシステムで同時に訓練する。 Transformer と表データを処理するモデルである。このようにして、モデルは取引シーケンスから表データを補完する情報を抽出することを学習し、2つのコンポーネントは同じ予測目標のために協調して最適化される。

Nubank オプション DCNv2 (Deep & Cross Network v2)アーキテクチャでテーブル機能を処理する。DCNv2 は、構造化入力用に特別に設計されたディープニューラルネットワークで、特徴間の相互作用を効率的に捉える。

Nubank 基本モデルの活用を追求することは、金融機関が顧客を理解しサービスを提供する方法において大きな飛躍を意味する。手作業によるフィーチャー・エンジニアリングから脱却し、代わりに生の取引データに基づく自己教師あり学習を採用することでNubank 拡張性と表現力を兼ね備えたモデリングシステムを構築。

この成功の鍵は、システムがより広いAIインフラにどのように適合するかにある。Nubank シナリオごとに個別のモデルを構築するのではなく、一元化されたAIプラットフォームが開発された。チームはニーズに応じて2つのモデルを選択することができる。トランザクションシーケンスのエンベッディングのみを使用するモデルと、フェデレート融合アーキテクチャを使用してエンベッディングと構造化されたフォームの特徴を組み合わせたハイブリッドモデルである。

この柔軟性は非常に重要である。既存の堅牢なフォーム・モデルにプラグアンドプレイでユーザーを埋め込むことができるチームもあれば、次のような新しいタスクにのみ依存するチームもある。 Transformer シーケンスモデルのこのアーキテクチャは、アプリケーションの使用パターンやカスタマーサポートのチャットなど、将来の新しいデータソースにも対応している。これは単なる技術的な概念実証ではなく、中核的な財務予測業務において測定可能な利益をもたらす、本番レベルのソリューションである。