グーグルは相次いで、単一のクラウドやデスクトップ・アクセラレータ上で動作するオープンソースモデルを発表した。 Gemma 3 Gemma 3でQATを達成した後、Gemmaは普及型AIの足跡を広げようとしている。Gemma 3が開発者に強力なクラウドとデスクトップ機能をもたらしたとすれば、2025年5月20日にGemma 3nのプレビューリリースが行われたことで、モバイルデバイス側でのリアルタイムAIへの意欲が明らかになった。私たちが毎日使っている携帯電話、タブレット、ラップトップ上で高性能AIを直接実行させることを目標としている。

次世代のエンドサイドAIを推進し、多様なアプリケーションシナリオをサポートするために、以下の機能をさらに強化する。 Gemini Googleのエンジニアリングチームは、Nanoの能力を最大限に引き出すために、最先端の新アーキテクチャを構築した。この新アーキテクチャは、クアルコム、メディアテック、サムスンのシステムLSI事業といったモバイル・ハードウェアのリーダー企業との緊密なコラボレーションの成果であると主張し、電光石火の高速レスポンスとマルチモーダルAI処理に最適化され、真にパーソナライズされたプライベートなスマート体験をデバイス側で直接提供するように設計されている。

Gemma 3nは、この画期的な共有アーキテクチャ上に構築された初のオープンモデルであり、開発者は本日から始まる早期プレビューを通じてこの技術を体験することができる。特筆すべきは、同じ先進的なアーキテクチャが次世代Gemini Nanoにも力を与え、Google Appsとそのエンドサイドエコシステムに幅広い機能強化をもたらすことである。つまり、Gemma 3nを使い始めることで、開発者は、Android(アンドロイド)やChrome(クローム)といったメインストリームのプラットフォームに間もなく登場する基礎技術を実際に予習していることになる。

注:このグラフは、チャットボット・アリーナ・エロ・スコアに基づいてAIモデルをランク付けしています。スコアが高い(上の数字)ほど、ユーザーの好みが高いことを示します。

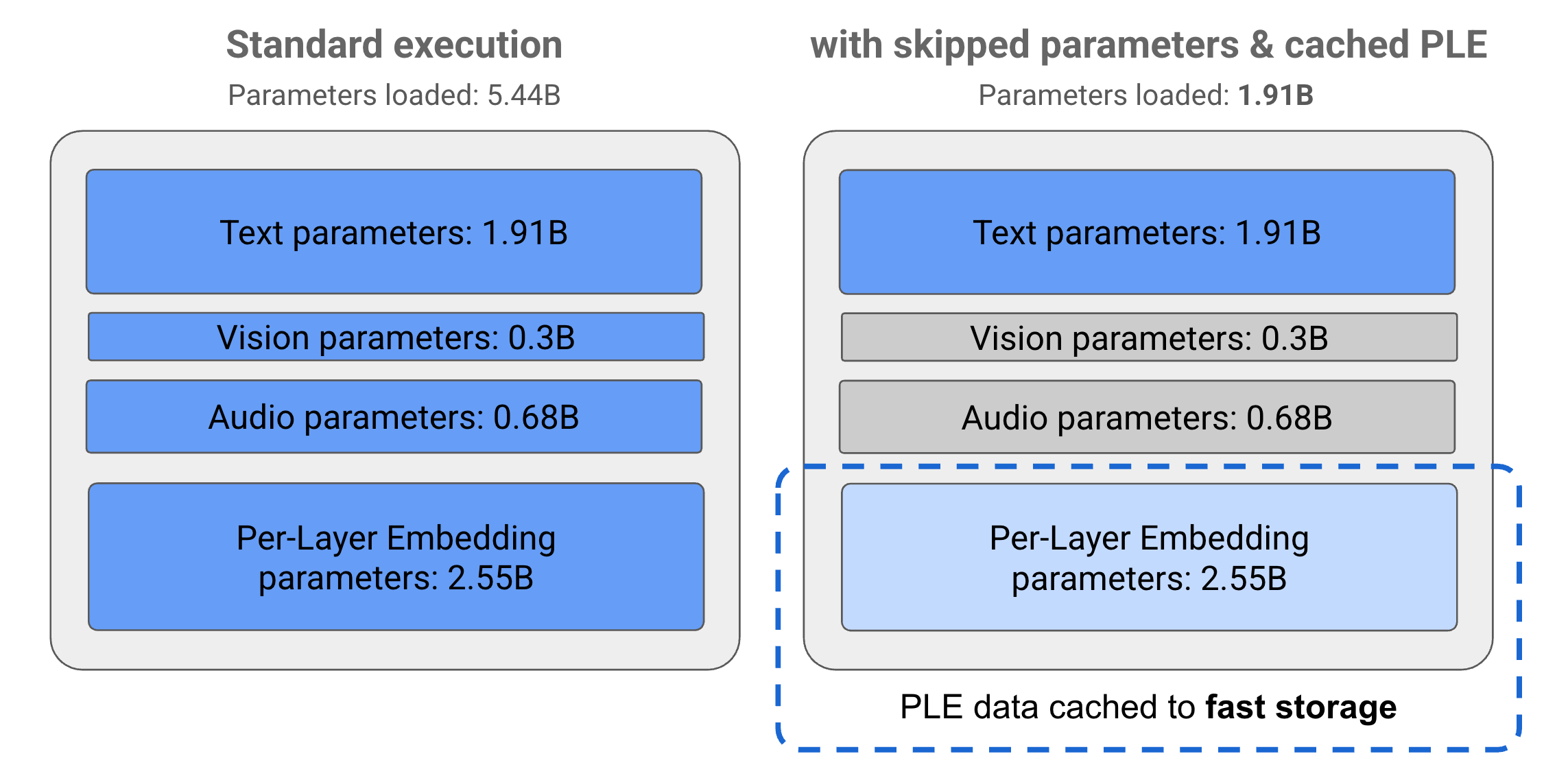

Gemma 3nの中核となる技術革新は、Google DeepMindのPer-Layer Embeddings(PLE)技術の採用であり、これによりモデルのメモリ(RAM)使用量が大幅に削減された。モデルの元のパラメータ数は50億(5B)と80億(8B)ですが、PLEにより、20億(2B)と40億(4B)のパラメータサイズに匹敵するメモリオーバーヘッドでモデルを実行することができます。具体的には、わずか2GBと3GBの動的メモリフットプリントで実行できる。このブレークスルーは、メモリに制約のあるモバイル機器にとって大きな恩恵である。技術的な詳細は公式ドキュメントを参照されたい。

Gemma 3nを探求することで、開発者は、このオープンソースモデルのコア機能と、Gemini NanoとともにAndroidおよびChromeプラットフォームにもたらされるモバイルファーストアーキテクチャの革新を垣間見ることができる。

ジェンマ3n 主要能力プロファイリング

Gemma 3nは、ローカルで動作する高速で低リソースのAIエクスペリエンス向けに設計されており、以下のような主要機能を備えている:

- エンドサイドの性能と効率の最適化Gemma 3 4Bと比較して、Gemma 3nはモバイル機器での応答速度を約1.5倍高速化し、モデル出力の質も大幅に向上しました。これは、レイヤーごとの埋め込み(PLE)、キー・バリュー・キャッシュの共有(KVC共有)、高度な活性化定量化などの革新的技術によって可能となり、これらによってメモリフットプリントの削減が実現しました。

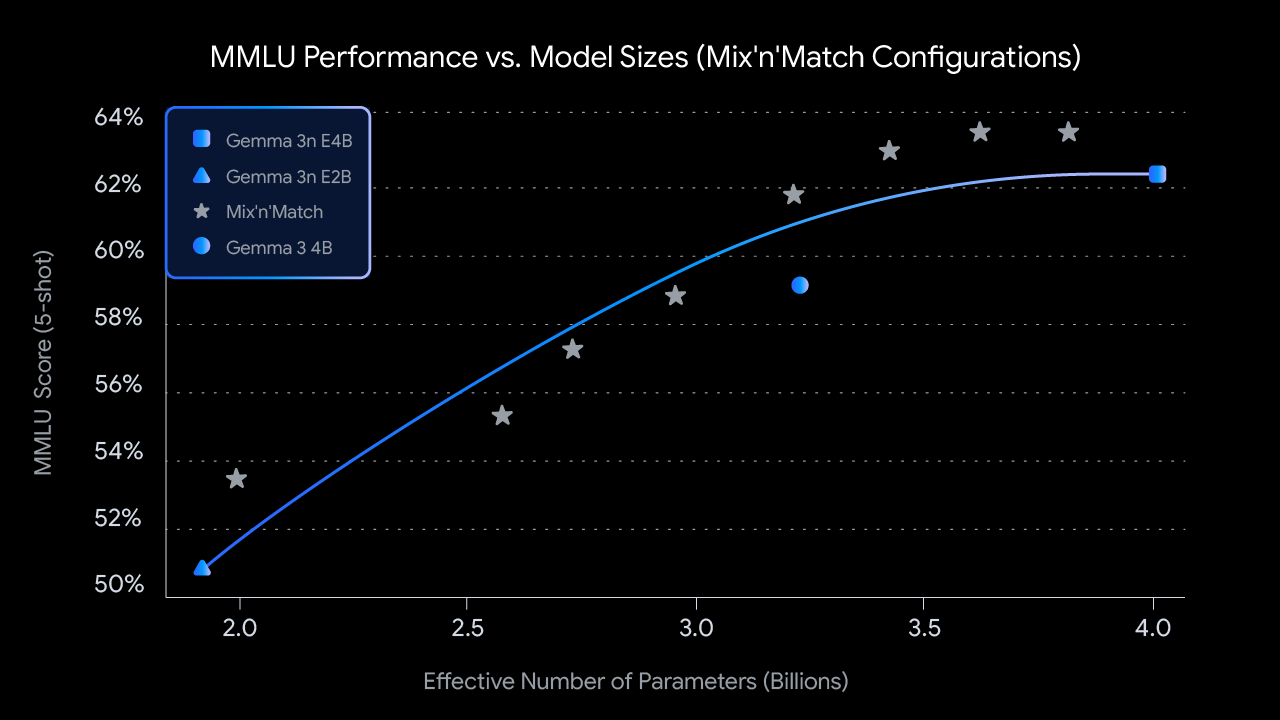

- 「メニー・イン・ワンの柔軟性Gemma 3nの4Bアクティブ・メモリー・フットプリント・バージョンには、業界をリードする2Bアクティブ・メモリー・フットプリントのサブモデルがMatFormerトレーニング・テクノロジーの中にネストされています。この設計により、複数の独立したモデルをホストする必要なく、性能と品質を動的にトレードオフできる柔軟性を備えている。さらに興味深いことに、Gemma 3nは「ミックス&マッチ」機能を導入しており、特定のユースケースとそれに関連する品質/レイテンシ要件に最適に適合するように、4Bモデルから動的にサブモデルを作成することができる。この研究の詳細については、近日中に発表されるテクニカルレポートで明らかにされる予定である。

- プライバシー・ファーストとオフライン可用性ローカル実行機能は、ユーザーのプライバシーを尊重し、ネットワーク接続がない場合でも確実に機能することを保証します。

- 拡張音声マルチモーダル理解Gemma 3nは、音声、テキスト、画像を理解し処理するだけでなく、ビデオ理解も大幅に向上させます。その音声機能により、このモデルは高品質の自動音声認識(書き起こし)と翻訳(音声から翻訳されたテキスト)を行うことができます。さらに、このモデルはモダリティをまたいだインターリーブ入力を受け付けるため、複雑なマルチモーダルインタラクションを理解することができる。(一般実装は近日公開予定)

- 多言語機能の強化Gemma 3nは、特に日本語、ドイツ語、韓国語、スペイン語、フランス語の多言語パフォーマンスを向上させました。特に日本語、ドイツ語、韓国語、スペイン語、フランス語が向上しました。

50.1%WMT(Workshop on Machine Translation)は機械翻訳の分野で重要な評価であり、ChrFは機械翻訳の評価指標として一般的に使用されている。

注:このグラフは、Gemma 3nの "mix-n-match"(事前学習)機能のMMLU性能を、モデルサイズ別に示したものです。MMLU(Massive Multitask Language Understanding)は、言語理解の包括的なベンチマークテストです。

新しいモバイル体験の可能性を解き放つ

Gemma 3nは、以下のようなインテリジェントなモバイル・アプリケーションの新潮流を後押しすると期待されている。

- リアルタイムのインタラクティブ体験の構築ユーザーの環境からのリアルタイムの視覚的、聴覚的な合図を理解し、それに反応する能力。

- より深い理解の促進音声、画像、動画、テキスト入力を組み合わせ、デバイス側で内々に情報を処理することで、より文脈に沿ったテキスト生成が可能になる。

- 高度なオーディオ・センター・アプリケーションの開発リアルタイムの音声転写、翻訳、リッチな音声主導型インタラクションを含みます。

次のビデオは、あなたが構築できる経験のタイプの概要を示しています:

責任ある共同建設

責任あるAI開発へのコミットメントは不可欠である。Gemmaファミリーのすべてのモデルと同様に、Gemma 3nは厳格なセキュリティ評価、データガバナンス、そしてセキュリティポリシーに従ったキャリブレーションの微調整を受けている。グーグル側は、オープンなモデルに対して慎重なリスク評価を行い、AIの進化に伴ってその実践を改善し続けていると述べている。

ジェンマ3nモデル・パラメーターの詳細分析

Gemma 3nは、携帯電話、ラップトップ、タブレットなどの日常的なデバイスでの使用に最適化された生成AIモデルである。このモデルには、前述のレイヤー・バイ・レイヤー・エンベッディング(PLE)によるパラメータ・キャッシングや、計算やメモリ要件を柔軟に削減できるMatFormerモデル・アーキテクチャなど、パラメータ効率の高い処理における革新的な技術が組み込まれている。このモデルは、音声入力だけでなく、テキストデータや視覚データも処理できる。

プレビュー段階とライセンスGemma 3nは現在早期プレビュー中です。Gemma 3nの詳細については、以下をご覧ください。 Google AI Studio やGoogle AI Edgeで試すことができる。他のGemmaモデルと同様に、Gemma 3nはオープン・ウェイトを提供し、責任ある商業利用のためのライセンスが付与されているため、開発者は自身のプロジェクトやアプリケーションで微調整を行い、展開することができる。

ジェンマ3nの主な特徴は、技術的なレベルではさらに次のように洗練される:

- 音声入力音声認識、翻訳、音声データ解析のための音声データ処理。

- ビジュアルおよびテキスト入力マルチモーダル機能により、視覚、音声、テキスト情報を処理し、周囲の世界を理解・分析することができる。

- PLEキャッシングモデルに含まれるPLE(Layer-by-Layer Embedding)パラメータは、高速ローカルストレージにキャッシュして、モデル実行時のメモリコストを削減することができます。このPLEデータはモデル実行時に使用され、各モデルのレイヤーのパフォーマンスを向上させるデータを作成します。モデルのメインメモリ空間からPLEパラメータを除外することで、リソースの消費を抑えながらモデルの応答品質を向上させます。

- MatFormerアーキテクチャ:: "コンドーム・スタイル" Transformer (マトリョーシカ・トランスフォーマー)アーキテクチャでは、大きなモデルの中に小さなモデルが入れ子になっている。これらの入れ子になったサブモデルは、外側のモデルの全パラメータをアクティブにすることなく、リクエストに応じて呼び出すことができます。MatFormerモデルの内部でより小さなコア・モデルのみを実行するこの機能により、モデルの計算コスト、応答時間、エネルギー消費を大幅に削減することができます。Gemma 3nでは、E4Bモデルだけで以下のものが含まれています。 E2B モデルのパラメータを選択することができます。このアーキテクチャでは、開発者がパラメータを選択し、2Bから4Bの中間のサイズのモデルを組み立てることもできる。詳細はMatFormerの研究論文をご覧ください。

- 条件付きパラメータロードPLEパラメータと同様に、モデル内の特定のパラメータ(オーディオパラメータやビジュアルパラメータなど)は、メモリへのロードを選択的にスキップしてメモリ負荷を軽減することができます。これらのパラメータは、デバイスに必要なリソースがあれば、実行時に動的にロードすることができます。全体として、パラメータスキッピングは、Gemma 3nモデルが必要とするランタイムメモリの量をさらに削減することができ、より広範なデバイス上での実行を可能にし、開発者は要求の少ないタスクに対してよりリソース効率を高めることができます。

- 幅広い言語サポート140を超える言語のトレーニングを積んだ豊富な語学力。

- 32Kトークンコンテキストデータを分析し、タスクを処理するために十分な入力コンテキストの長さを提供します。

注意を引く詳細については、Android(アンドロイド)用のGemini Nano開発者向けドキュメントを参照してください。

モデル・パラメーターと "有効パラメーター "の謎

ジェンマ3nモデルには、次のような名前が付けられている。 E2B 和 E4B このようなパラメータ数は、モデルに含まれるパラメータの総数よりも少ない。接頭辞 E このことは、簡素化された効果的なパラメータセットでモデルが動作できることを示している。この簡略化されたパラメータ操作は、Gemma 3nモデルに組み込まれた柔軟なパラメータ化技術によって可能となり、低リソース機器での効率的な実行に役立っている。

Gemma 3nモデルのパラメータは、テキスト、ビジュアル、オーディオ、レイヤーごとの埋め込み(PLE)パラメータの4つの主要グループに分けられる。E2Bモデルの標準的な実行モードでは、50億を超えるパラメータが実行時にロードされる。しかし、パラメータ・スキッピングとPLEキャッシング技術を利用することで、下図に示すように、20億(19.1億)近いパラメータの実効メモリ負荷でモデルを実行することができます。

図1. Gemma 3n E2Bモデルのパラメータを標準的な実行モードで使用した場合と、PLEキャッシュとパラメータスキッピング技術を使用してパラメータ負荷を効果的に低減した場合との比較。

これらのパラメータ・オフロードと選択的アクティブ化技術を使用することで、非常に凝縮されたパラメータ・セットでモデルを実行したり、ビジュアルやオーディオなどの他のデータタイプを処理するために追加パラメータをアクティブ化したりすることが可能です。これらの機能により、ユーザーはモデルの機能をデバイスの機能やタスクの要件に柔軟に適応させることができます。

はじめに:ジェンマ3nのプレビュー

ジェンマ3nの早期トライアルが始まった:

- Google AI Studioによるクラウド探索設定不要でブラウザから直接Googleにアクセスできます! AI Studio 今すぐGemma 3nをお試しいただき、そのテキスト入力機能をご確認ください。

- Google AI Edgeによるエンドサイド開発Gemma 3nをローカルに統合したい開発者のために、Google AI Edgeはそのためのツールとライブラリを提供している。現在、テキストや画像の理解・生成機能を使い始めることが可能です。

Gemma 3nは、最先端の効率的なAIを普及させる新たな一歩を踏み出した。技術が開放されるにつれ、今日のプレビューを皮切りに、開発者コミュニティにどのような革新がもたらされるのか楽しみだ。

5月22日より、io.googleでこの発表とすべての内容をご覧いただけます。 Google I/O 2025 更新された。

組み立てに興味がありますか?ジェンマ・モデルのスタートガイドから始めてみませんか?